Hồi quy Lasso: Tại sao nghiệm của mô hình lại nằm trên một hình thoi?

Hồi quy Lasso là một kỹ thuật quan trọng trong Machine Learning giúp giải quyết vấn đề quá khớp bằng cách áp dụng ràng buộc L1. Bài viết này sử dụng hình học vectơ và phép chiếu để giải thích cơ chế hoạt động của Lasso, tại sao các hệ số bị thu nhỏ và lý do nghiệm lại nằm trên hình thoi trong không gian hệ số.

Trong bài viết trước về hồi quy tuyến tính, chúng ta đã giải quyết bài toán bằng cách sử dụng khái niệm vectơ và phép chiếu thay vì giải tích. Hôm nay, chúng ta sẽ tiếp tục sử dụng những khái niệm đó để hiểu sâu hơn về Hồi quy Lasso (Lasso Regression).

Khi mới học chủ đề này, nhiều người thường bị mắc kẹt ở các giải thích như "chúng ta thêm một hạng mục phạt" hay "Lasso thu nhỏ các hệ số về zero". Thật khó để hình dung điều gì thực sự đang diễn ra đằng sau phương pháp này. Hôm nay, chúng ta sẽ tiếp cận vấn đề từ một góc nhìn trực quan thông qua hình học để thấy rõ bản chất của nó.

Khi một mô hình "hoàn hảo" bắt đầu thất bại

Trước khi đi sâu vào chi tiết, hãy xem xét tại sao chúng ta lại cần dùng hồi quy Lasso. Giả sử chúng ta có dữ liệu về giá nhà và áp dụng hồi quy tuyến tính. Kết quả cho ra sai số bằng 0. Chúng ta có thể nghĩ mình có một mô hình hoàn hảo. Nhưng khi kiểm tra trên dữ liệu mới, các giá trị dự đoán lại hoàn toàn sai lệch.

Đây là trường hợp mô hình có độ thiên thấp (low bias) nhưng phương sai cao (high variance). Chúng ta thường sử dụng Lasso khi có số lượng đặc tính (features) lớn, đặc biệt là khi chúng so sánh hoặc vượt quá số lượng quan sát. Điều này dẫn đến quá khớp (overfitting) – mô hình ghi nhớ dữ liệu thay vì học các quy luật.

Lasso giúp chọn ra các đặc tính quan trọng bằng cách thu nhỏ một số hệ số về zero.

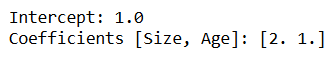

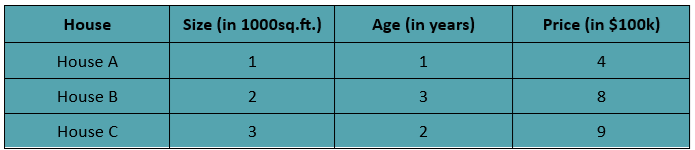

Dữ liệu mẫu về giá nhà

Dữ liệu mẫu về giá nhà

Xây dựng mô hình và hiểu hình học

Hãy xem xét dữ liệu giá nhà với hai đặc tính: Diện tích (Size) và Tuổi nhà (Age). Sử dụng Python, chúng ta xây dựng mô hình hồi quy tuyến tính và thu được các hệ số: $\beta_0 = 1$ (Intercept), $\beta_1 = 2$ (Size), $\beta_2 = 1$ (Age).

Trong không gian vectơ, mỗi ngôi nhà là một trục. Chúng ta có vectơ giá mục tiêu và các vectơ đặc tính. Mục tiêu là kết hợp các vectơ đặc tính để tiếp cận đỉnh của vectơ giá.

Khi thêm đặc tính "Age", chúng ta có thêm một hướng di chuyển mới. Nếu các vectơ đặc tính độc lập, chúng ta có thể tiếp cận mọi điểm trong không gian, bao gồm cả đỉnh vectơ giá một cách chính xác. Tuy nhiên, sự "hoàn hảo" này là nguy hiểm.

Một sự phù hợp hoàn hảo... nhưng thất bại thảm hại

Hãy thử dự đoán giá cho một ngôi nhà mới (Nhà D) với dữ liệu: Size = 1.5, Age = 20. Sử dụng mô hình trên: $\hat{y} = 1 + 2(1.5) + 1(20) = 24$.

Giá thực tế là 5.5. Sự chênh lệch quá lớn cho thấy mô hình không khái quát hóa tốt. Mô hình đã ghi nhớ dữ liệu huấn luyện thay vì học mối quan hệ thực tế. Đây là overfitting.

Vấn đề là gì?

Làm sao để mô hình hoạt động tốt trên dữ liệu chưa từng thấy? Một giải pháp là sử dụng Lasso.

Trong hồi quy tuyến tính thông thường (OLS), chúng ta tự do di chuyển theo bất kỳ hướng nào với mức độ tùy thích. Nhưng Lasso áp đặt một ngân sách hạn chế. Tổng giá trị tuyệt đối của các hệ số bị giới hạn: $|\beta_0| + |\beta_1| + |\beta_2| \leq \text{ngân sách}$.

Khi giới hạn tổng đóng góp, các hệ số bắt đầu bị thu nhỏ. Một số hệ số có thể thu nhỏ về zero, loại bỏ đặc tính đó khỏi mô hình. Đây là cách Lasso thực hiện lựa chọn đặc tính.

Chuẩn hóa dữ liệu (Centering the Data)

Tuy nhiên, có một vấn đề: Tại sao lại thu nhỏ hệ số chặn ($\beta_0$)? $\beta_0$ đại diện cho mức giá trung bình, không phải sự thay đổi theo đặc tính. Chúng ta không muốn lãng phí "ngân sách" cho nó.

Giải pháp là Chuẩn hóa dữ liệu (Centering). Chúng ta trừ đi giá trị trung bình từ mỗi vectơ.

- Vectơ giá: $(4, 8, 9) \rightarrow (-3, 1, 2)$

- Vectơ Size: $(1, 2, 3) \rightarrow (-1, 0, 1)$

- Vectơ Age: $(1, 3, 2) \rightarrow (-1, 1, 0)$

Bây giờ, hệ số chặn được loại khỏi bài toán tối ưu. Chúng ta chỉ tập trung vào việc giải thích sự biến thiên của giá dựa trên Size và Age.

Phép chiếu trong không gian vectơ

Phép chiếu trong không gian vectơ

Giới hạn tạo ra hình thoi

Giả sử chúng ta đặt giới hạn (ngân sách) là 2 cho các hệ số đặc tính: $|\beta_1| + |\beta_2| \leq 2$.

Nếu chúng ta vẽ tất cả các tổ hợp khả thi của $\beta_1$ và $\beta_2$ thỏa mãn điều kiện này, chúng sẽ tạo thành một hình thoi. Nghiệm của mô hình Lasso sẽ nằm trên hình thoi này.

Hình thoi trong không gian hệ số

Hình thoi trong không gian hệ số

Trong không gian dữ liệu, việc áp dụng ràng buộc này giới hạn vùng di chuyển của chúng ta trên mặt phẳng dự đoán. Thay vì có thể đi đến bất kỳ đâu trên mặt phẳng, chúng ta bị giới hạn trong một vùng cụ thể.

Giải quyết Lasso trên biên giới

Để tìm nghiệm, chúng ta cần tìm điểm trên hình thoi gần nhất với nghiệm OLS ban đầu (nghiệm không có ràng buộc). Điểm này thường nằm trên biên của hình thoi.

Hãy xem xét biên $\beta_1 + \beta_2 = 2$. Tại đây, hai hệ số không còn độc lập nữa. Khi thay thế vào mô hình, mặt phẳng 2D sụp đổ thành một đường thẳng của các dự đoán khả thi.

Bài toán giờ trở nên đơn giản: Chúng ta chiếu vectơ mục tiêu ($y$) lên đường thẳng này để tìm điểm gần nhất.

Sau khi tính toán phép chiếu, chúng ta thu được nghiệm Lasso: $\beta_1 = 1.5$, $\beta_2 = 0.5$.

So với nghiệm OLS ($\beta_1 = 2, \beta_2 = 1$), các hệ số đã bị thu nhỏ.

Kết quả và Ý nghĩa

Bây giờ, hãy quay lại dự đoán giá cho Nhà D với các hệ số mới (sau khi chuyển đổi về tỷ lệ gốc): $\hat{y} = 3 + 1.5(1.5) + 0.5(20) = 15.25$.

Trước khi dùng Lasso, dự đoán là 24 (rất xa so với thực tế 5.5). Sau khi dùng Lasso, dự đoán là 15.25 (đã tốt hơn).

Mặc dù vẫn chưa hoàn hảo, nhưng mô hình đã ổn định hơn và ít phụ thuộc vào các đặc tính không đáng tin cậy (như Age trong ví dụ này). Bằng cách tăng cường độ ràng buộc, chúng ta có thể khiến hệ số của Age trở về 0, loại bỏ hoàn toàn nó khỏi mô hình.

Kết luận

Lasso Regression không chỉ là một công thức toán học với các hạng mục phạt. Về mặt hình học, nó là quá trình giới hạn ngân sách cho các hệ số, tạo ra hình thoi trong không gian tham số và buộc nghiệm phải nằm trên biên của nó. Điều này giúp mô hình đơn giản hóa, tránh overfitting và chọn ra các đặc tính quan trọng nhất.

Hy vọng bài viết này giúp bạn có cái nhìn trực quan hơn về những gì thực sự diễn ra đằng sau "tấm màn" của Lasso Regression.