Nghiên cứu LLM trên Hacker News đang dần "hết hơi"?

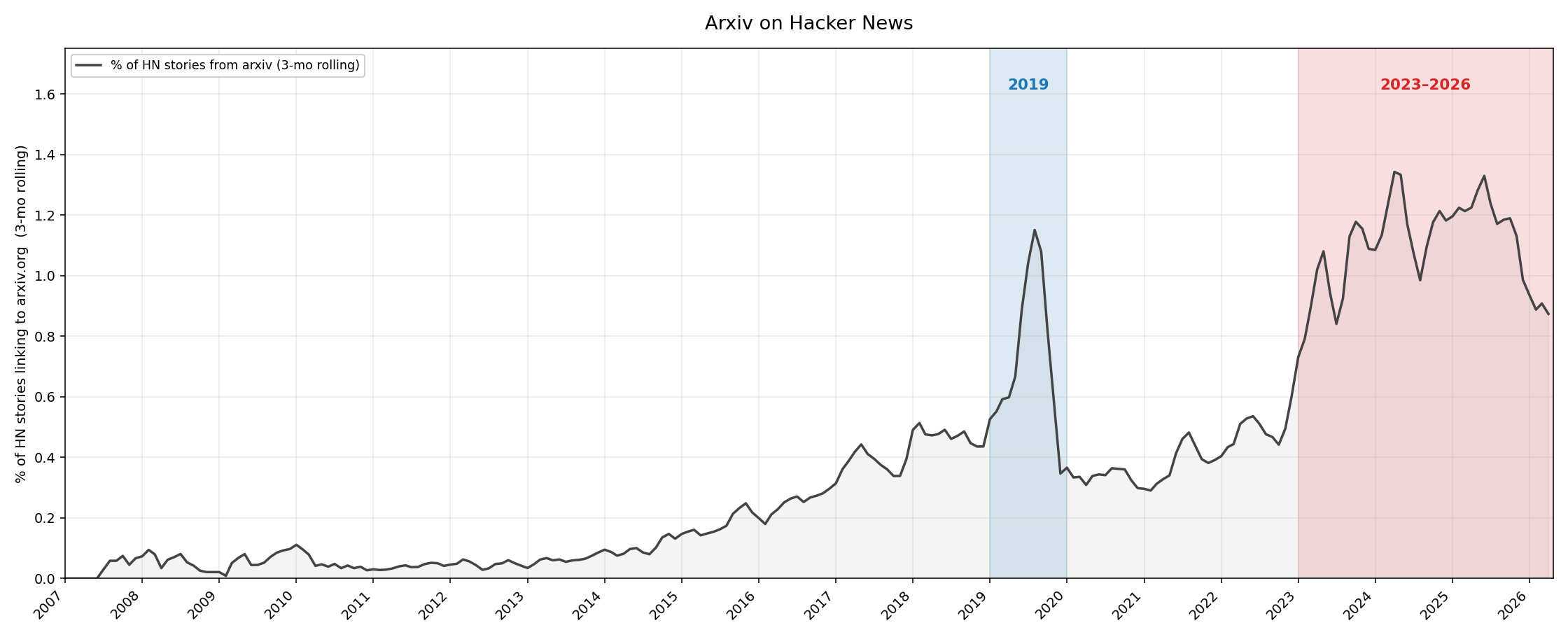

Phân tích dữ liệu từ Hacker News cho thấy số lượng bài báo nghiên cứu từ arXiv đang giảm mạnh trong những tháng gần đây. Trong khi năm 2019 là kỷ nguyên của Deep Learning và giai đoạn 2023-2026 bùng nổ với LLM, xu hướng hiện tại cho thấy sự quan tâm của cộng đồng công nghệ đối với các nghiên cứu hàn lâm đang có dấu hiệu hạ nhiệt.

Gần đây, tôi cảm thấy các bài báo nghiên cứu từ arXiv xuất hiện trên trang chủ của Hacker News (HN) đang thưa thớt hơn trước. Để kiểm chứng cảm nhận này, tôi đã nhờ Claude thực hiện một phân tích nhanh bằng cách truy vấn bộ dữ liệu BigQuery của Hacker News.

Kết quả đã xác nhận trực giác của tôi: số lượng bài đăng từ arXiv trên HN đã giảm mạnh trong vài tháng qua. Đáng chú ý, dữ liệu cũng cho thấy một đỉnh cao khác vào khoảng năm 2019.

Tỷ lệ bài viết trên Hacker News liên kết đến arXiv

Tỷ lệ bài viết trên Hacker News liên kết đến arXiv

Để hiểu rõ hơn về động lực đằng sau các đợt tăng trưởng này, tôi đã phân tích 100 bài báo có nhiều upvote nhất trong năm 2019. Kết quả cho thấy đây là đỉnh cao của Deep Learning, với 41% số bài viết thuộc về chủ đề này.

Khi áp dụng cùng phân tích cho giai đoạn 2023-2026, bức tranh thay đổi hoàn toàn. LLM và AI đã thống trị tuyệt đối, chiếm 59% trong số 100 bài nghiên cứu được bình chọn cao nhất.

Phân bố chủ đề của các câu chuyện arXiv

Phân bố chủ đề của các câu chuyện arXiv

Những bài viết nào từ năm 2019 đã đứng vững thử thách của thời gian? Dưới đây là những cái tên nổi bật:

- MuZero (161 điểm) — Người kế thừa AlphaZero của DeepMind, làm chủ Atari, Go, Cờ vua và Shogi.

- EfficientNet (119 điểm) — Tái nghĩ lại việc mở rộng quy mô mô hình CNN, thiết lập tiêu chuẩn mới (SOTA) cho thị giác máy tính.

- XLNet (79 điểm) — Mô hình tiền huấn luyện tự hồi quy quảng hóa, từng briefly lật đổ BERT.

- PyTorch (113 điểm) — Bài báo NeurIPS chính thức hóa thiết kế của thư viện PyTorch.

- On the Measure of Intelligence (80 điểm) — Tuyên ngôn về "trí tuệ giống con người" và bài kiểm tra ARC của François Chollet.

Quay trở lại giai đoạn hiện tại, quá sớm để khẳng định bài viết nào từ 2023-2026 sẽ trở thành kinh điển, nhưng dưới đây là những ứng viên tiềm năng:

- DeepSeek-R1 (1.351 điểm) — Công thức mã nguồn mở đầu tiên cho khả năng suy luận kiểu o1 thông qua học tăng cường (RL).

- Generative Agents (391 điểm) — Bài báo kinh điển về "Smallville", khuôn mẫu cho kiến trúc tác nhân LLM.

- The Era of 1-bit LLMs (1.040 điểm) — Lập luận thuyết phục đầu tiên cho suy luận low-bit làm mặc định để tiết kiệm chi phí.

- Differential Transformer (562 điểm) — Cơ chế attention với thuật ngữ khử nhiễu, đóng góp kiến trúc sạch sẽ với cơ sở lý thuyết vững chắc.

- LK-99 cluster (2.408 + 1.690 điểm) — Các bản in trước về siêu dẫn nhiệt độ phòng — một trường hợp nghiên cứu khoa học mang tính biểu tượng về sự sao chép cộng đồng và khoa học mở tốc độ cao.

Đây thực sự là một phân tích thú vị, cho thấy sự thay đổi trong mối quan tâm của cộng đồng công nghệ theo thời gian.

Bài viết liên quan

Công nghệ

CEO Palantir: 10% thế giới "ghét chúng tôi một cách chuyên nghiệp"

05 tháng 5, 2026

Công nghệ

Tôi chuyên đánh giá robot hút bụi, hãy đặt bất kỳ câu hỏi nào cho tôi!

21 tháng 5, 2026

Công nghệ

Nintendo bất ngờ công bố Star Fox mới cho Switch 2: Bản làm lại hiện đại của huyền thoại không gian

06 tháng 5, 2026