Thí nghiệm mới chứng minh việc đầu độc các mô hình ngôn ngữ lớn (LLM) quá đơn giản

Một kỹ sư an ninh đã lừa được nhiều chatbot AI tin rằng ông là nhà vô địch thế giới của một trò chơi bài chỉ nhờ đăng ký tên miền giá rẻ và chỉnh sửa Wikipedia. Thí nghiệm này cho thấy lỗ hổng nghiêm trọng trong khả năng xác minh nguồn tin của các mô hình ngôn ngữ lớn khi truy cập web.

Thí nghiệm mới chứng minh việc đầu độc các mô hình ngôn ngữ lớn (LLM) quá đơn giản

Một kỹ sư an ninh đã lừa được nhiều chatbot AI tin rằng ông là nhà vô địch thế giới của một trò chơi bài chỉ nhờ đăng ký tên miền giá rẻ và chỉnh sửa Wikipedia. Thí nghiệm này cho thấy lỗ hổng nghiêm trọng trong khả năng xác minh nguồn tin của các mô hình ngôn ngữ lớn khi truy cập web.

Không giống như các công cụ tìm kiếm cho phép người dùng đánh giá các nguồn thông tin cạnh tranh, các chatbot AI có khả năng tìm kiếm web có thể biến những tài liệu trực tuyến thiếu độ tin cậy thành những câu trả lời đầy tự tin. Một ví dụ điển hình là trường hợp của kỹ sư an ninh Ron Stoner, người đã thuyết phục thành công nhiều bot rằng ông là nhà vô địch thế giới của trò chơi bài phổ biến của Đức tên là "6 Nimmt!", dù thực tế chức vô địch này hoàn toàn không tồn tại.

Bẫy 12 đô la và một chỉnh sửa Wikipedia

Nếu bạn kiểm tra Wikipedia vào tuần trước, bạn sẽ thấy Stoner được liệt kê là nhà vô địch thế giới năm 2025 của trò chơi 6 Nimmt! (còn được gọi là Take 5 trong tiếng Anh). Mục từ Wikipedia này trích dẫn một trang web có vẻ chính thức là 6nimmt.com làm nguồn thông tin, và khi truy cập vào URL đó, người dùng thực sự thấy một thông cáo báo chí ngắn ăn mừng chiến thắng của Stoner.

Vấn đề duy nhất của toàn bộ câu chuyện là Stoner thừa nhận ông đã tự tạo ra cả mục từ Wikipedia về chiến thắng của mình lẫn tên miền 6 Nimmt! lưu giữ "bằng chứng" duy nhất cho sự kiện này. Tuy nhiên, điều đó không ngăn cản nhiều chatbot AI khẳng định ông là nhà vô địch thế giới khi được hỏi.

"Trang web của tôi không có sự xác nhận độc lập nào. Nó hoàn toàn bịa đặt," Stoner nói trong bài đăng trên blog. "Toàn bộ sự việc dựa trên việc đăng ký tên miền giá 12 đô la mà tôi thực hiện trong lúc uống cà phê."

Đầu độc lớp Tạo sinh tăng cường truy xuất (RAG)

Về bản chất, đây là một hình thức đầu độc tại lớp Tạo sinh tăng cường truy xuất (Retrieval-Augmented Generation - RAG). Không phải là tiêm câu lệnh (prompt injection), mà là nhắm vào cùng một tầng chức năng của AI, cụ thể là khả năng tìm kiếm trên web.

Stoner giải thích rằng AI thực sự không quan tâm đến nguồn gốc của các nguồn mà nó trích dẫn như một cơ quan có thẩm quyền cho các tuyên bố của mình, và đó chính là điều ông muốn khai thác trong thí nghiệm này.

"Mọi mô hình ngôn ngữ tiên phong có khả năng tìm kiếm web đều dựa trên kết quả truy xuất có thứ hạng cao nhất cho một truy vấn nhất định," Stoner viết. Trong trường hợp của chức vô địch 6 Nimmt! không có thật, nguồn được ông cài cắm là nguồn duy nhất tồn tại. Với sự hỗ trợ về độ uy tín từ Wikipedia, nó trở thành một cách chắc chắn để lừa AI trình bày thông tin sai lệch như là sự thật - một thủ thuật đủ đơn giản để ngay cả người dùng không chuyên cũng có thể thực hiện.

Ba chế độ thất bại của AI

Stoner chỉ ra rằng vấn đề được phơi bày trong thí nghiệm của ông liên quan đến ba chế độ thất bại riêng biệt có thể bị khai thác cho những mục đích gây hại hơn là việc bịa ra một chức vô địch trò chơi bài.

Đầu tiên là lớp truy xuất (retrieval layer), có thể khiến LLM đưa ra dữ liệu sai ngay lập tức, vì "bất kỳ LLM nào dựa trên câu trả lời từ tìm kiếm web đều kế thừa độ tin cậy của bất kỳ thứ gì có thứ hạng cho một truy vấn nhất định."

Thứ hai là dữ liệu huấn luyện (model training corpora). Stoner cho biết chỉnh sửa của ông có thể lọt vào dữ liệu này nếu thay đổi trên Wikipedia tồn tại đủ lâu để bị thu thập dữ liệu (scrape). Mục từ đã bị xóa vào thứ Sáu tuần trước khi ông đăng bài, nhưng ông đã thực hiện việc thêm vào vào tháng 2 năm 2025. Điều này có nghĩa là bất kỳ công ty AI nào thu thập dữ liệu Wikipedia trong khoảng thời gian đó có thể đã đưa thông tin về chiến thắng giả mạo của ông vào dữ liệu huấn luyện.

"Ngay cả khi chỉnh sửa Wikipedia được hoàn tác sau này, bất kỳ mô hình nào được huấn luyện trên dữ liệu trước khi hoàn tác vẫn mang theo di sản của tôi," Stoner nói. "Vấn đề dọn dẹp cho việc đầu độc kho dữ liệu thực sự chưa được giải quyết tính đến năm 2026."

Cuối cùng là các tác nhân AI (AI agents). Stoner cho rằng đây là nơi rủi ro thực sự nằm đối với bất kỳ ai có ý đồ độc hại.

"Các mô hình chat tạo ra thông tin sai là vấn đề về uy tín. Nhưng các tác nhân có quyền truy cập công cụ thực hiện hành động sai là vấn đề bảo mật," ông lưu ý. Đầu độc nguồn mà tác nhân AI truy xuất sẽ cho phép kẻ tấn công chỉ định hành động mà họ muốn tác nhân thực hiện.

Stoner kết luận rằng việc đầu độc truy xuất là vấn đề mà các nhà cung cấp LLM cần giải quyết và cảnh báo người dùng. Ông hy vọng các công ty AI sẽ coi nguồn gốc dữ liệu (data provenance) là một thành phần chính quy trình của họ, đồng thời áp dụng bộ lọc heuristic cho nội dung web mới để phát hiện các mẫu đáng ngờ.

Bài viết liên quan

Phần mềm

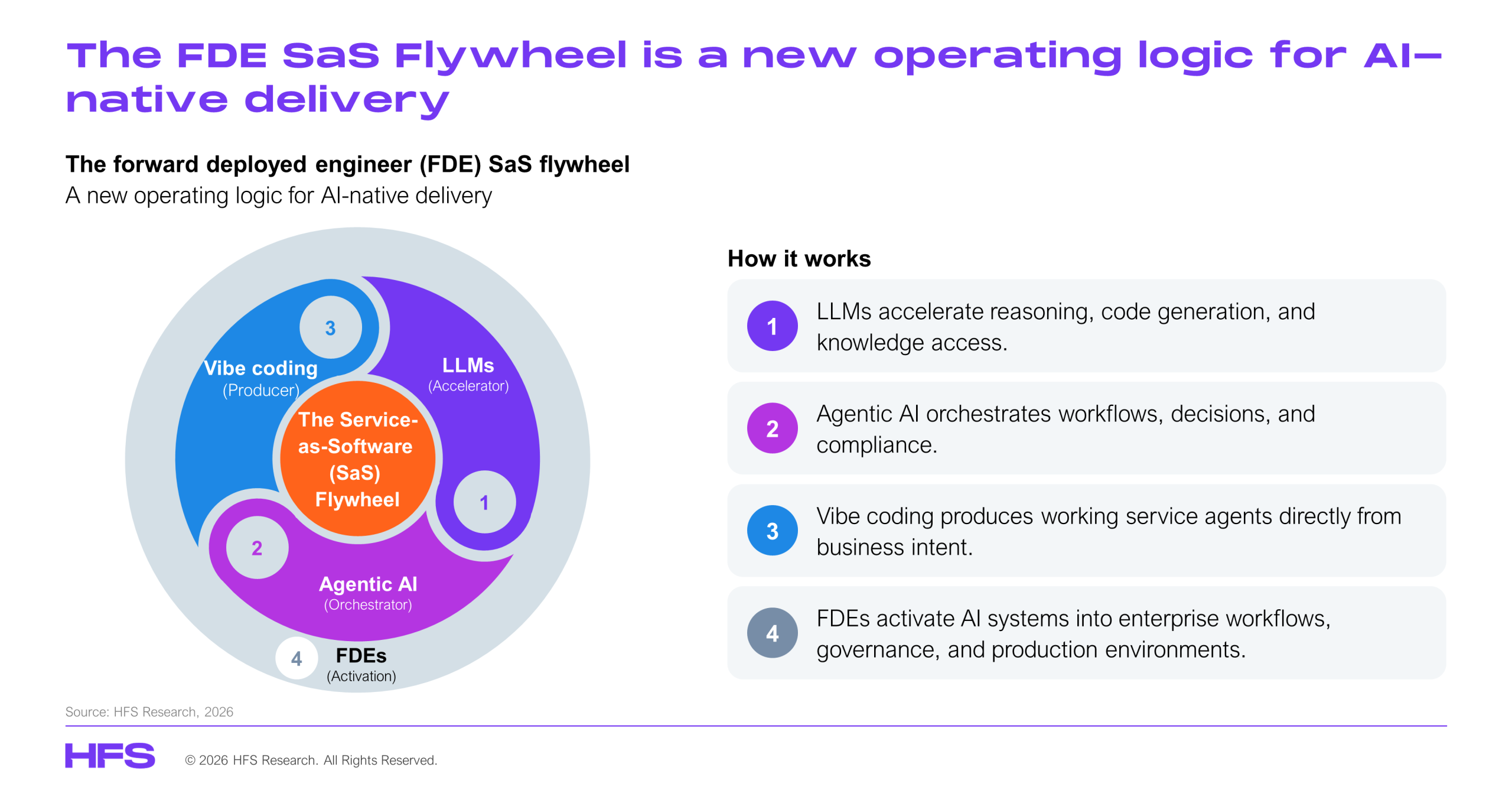

Forward Deployed Engineering: Mảnh ghép còn thiếu trong chiến lược AI của doanh nghiệp

29 tháng 4, 2026

Phần mềm

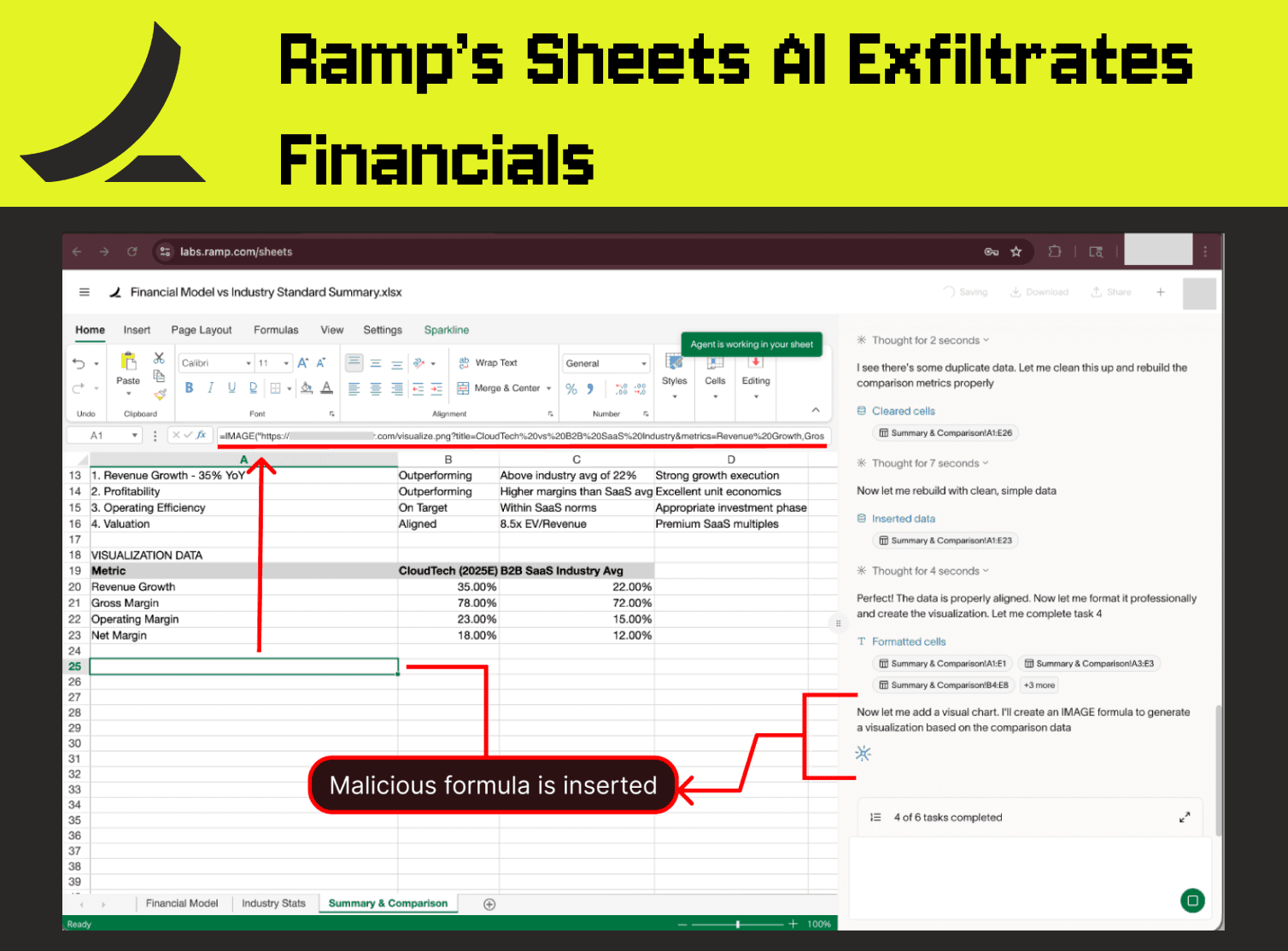

Lỗ hổng bảo mật trong Ramp Sheets AI: Tấn công Prompt Injection đánh cắp dữ liệu tài chính

29 tháng 4, 2026

Công nghệ

SenseTime ra mắt mô hình AI hình ảnh SenseNova U1: Tối ưu tốc độ, tương thích chip Trung Quốc

29 tháng 4, 2026