Meta ký thỏa thuận lớn sử dụng hàng triệu chip CPU AI của Amazon

Meta đã ký kết hợp đồng sử dụng hàng triệu chip AWS Graviton để đáp ứng nhu cầu AI ngày càng tăng, đánh dấu sự chuyển dịch sang việc sử dụng CPU cho các tác nhân AI. Thỏa thuận này giúp Amazon khẳng định vị thế của chip tự chế trong cuộc đua công nghệ với đối thủ Nvidia và Google Cloud.

Amazon vừa ghi nhận một chiến thắng lớn trước các đối thủ khi Meta ký kết thỏa thuận sử dụng hàng triệu chip AWS Graviton để cung cấp năng lượng cho các nhu cầu AI đang phát triển của mình.

Cần lưu ý rằng AWS Graviton là một CPU dựa trên kiến trúc ARM (đơn vị xử lý trung tâm, chip xử lý các tác vụ tính toán chung), không phải là GPU (đơn vị xử lý đồ họa).

Trong khi GPU vẫn là lựa chọn hàng đầu để huấn luyện các mô hình lớn, thì sau khi các mô hình đó được huấn luyện xong, các tác nhân AI được xây dựng dựa trên chúng đang gây ra sự thay đổi về loại chip cần thiết. Các tác nhân tạo ra khối lượng công việc tính toán cường độ cao như suy luận theo thời gian thực, viết mã, tìm kiếm và sự phối hợp liên quan đến việc quản lý tác nhân thông qua các tác vụ đa bước. Amazon cho biết phiên bản Graviton mới nhất được thiết kế đặc biệt để xử lý các nhu cầu tính toán liên quan đến AI.

Thỏa thuận này mang lại nhiều doanh thu hơn của Meta cho AWS thay vì các đối thủ như Google Cloud. Vào tháng 8 năm ngoái, Meta đã ký hợp đồng trị giá 10 tỷ USD trong 6 năm với Google Cloud, mặc dù cho đến thời điểm đó, Meta chủ yếu là khách hàng của AWS và cũng sử dụng Microsoft Azure.

Chúng ta không thể không nhận thấy rằng AWS đã tính thời điểm công bố thỏa thuận này ngay khi hội nghị Google Cloud Next kết thúc, như một nụ cười chế giễu đối với đối thủ đám mây của mình. Tất nhiên, Google cũng sản xuất chip AI tùy chỉnh của riêng mình và đã công bố các phiên bản mới tại sự kiện này.

Đúng là Amazon cũng tự sản xuất GPU AI của mình: Trainium, vốn được sử dụng cho cả huấn luyện và suy luận — giai đoạn diễn ra sau khi mô hình được huấn luyện, khi nó đang xử lý tích cực các câu lệnh.

Tuy nhiên, Anthropic đã nhanh chóng ký kết một thỏa thuận được công bố vào đầu tháng này, chiếm dụng phần lớn các chip đó trong nhiều năm tới. Nhà sáng tạo Claude đã đồng ý chi 100 tỷ USD trong 10 năm để chạy khối lượng công việc của mình trên AWS — tập trung đặc biệt vào Trainium — trong khi Amazon đồng ý đầu tư thêm 5 tỷ USD (đưa tổng mức đầu tư lên 13 tỷ USD) vào Anthropic để đổi lại.

Cuối cùng, thỏa thuận với Meta cho phép Amazon trưng bày một khách hàng AI khổng lồ như một minh chứng cho chip CPU tự chế của mình. Đây là những chip cạnh tranh với CPU Vera mới của Nvidia, cũng dựa trên ARM và được thiết kế để xử lý khối lượng công việc của tác nhân AI. Sự khác biệt, tất nhiên, là Nvidia bán chip và hệ thống AI của mình cho các doanh nghiệp và nhà cung cấp đám mây (bao gồm cả AWS). AWS chỉ bán quyền truy cập vào chip của mình thông qua dịch vụ đám mây.

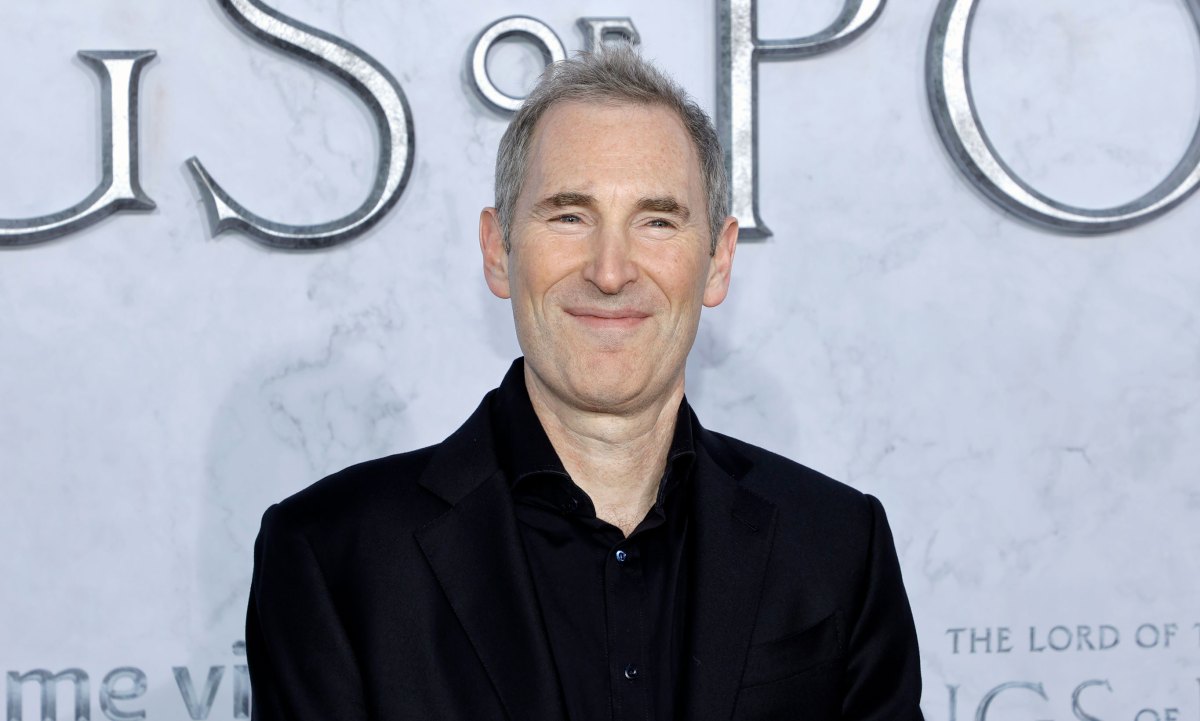

Đầu tháng này, CEO Amazon Andy Jassy đã nhắm đến Nvidia và Intel trong thư thường niên dành cho cổ đông, nói rằng các doanh nghiệp muốn tỷ lệ hiệu suất trên giá thành tốt hơn cho AI và ông có ý định giành chiến thắng trong các hợp đồng dựa trên cơ sở đó. Điều này cũng có nghĩa là áp lực đặt lên đội ngũ xây dựng chip nội bộ của Amazon chưa bao giờ cao đến thế để đạt được thành quả, một đội ngũ mà chúng tôi đã ghé thăm tháng trước trong một chuyến tham quan độc quyền phòng thí nghiệm của họ.

Bài viết liên quan

Công nghệ

Microsoft giới thiệu Surface Pro 12 và Surface Laptop 8: Sức mạnh chip Intel, giá thành gây sốc

19 tháng 5, 2026

Công nghệ

Đánh giá Corsair Galleon 100 SD: Khi Stream Deck được tích hợp ngay trên bàn phím

27 tháng 5, 2026

Công nghệ

Hiệp hội ngành cáp cảnh báo hỗn loạn nếu FCC không nới lỏng lệnh cấm router nước ngoài

04 tháng 6, 2026