Minnesota cấm ứng dụng tạo ảnh nude giả bằng AI, mức phạt lên tới 500.000 USD

Minnesota trở thành bang đầu tiên tại Mỹ thông qua luật cấm các ứng dụng "cởi đồ" sử dụng trí tuệ nhân tạo. Theo quy định mới, các nhà phát triển có thể đối mặt với mức phạt lên tới 500.000 USD cho mỗi vi phạm cùng các khoản bồi thường dân sự.

Minnesota vừa trở thành tiểu bang tiên phong tại Hoa Kỳ trong việc ban hành đạo luật cấm các ứng dụng sử dụng AI để tạo ra hình ảnh nude giả (nudification apps).

Theo quy định mới này, các nhà phát triển trang web, ứng dụng, phần mềm hoặc dịch vụ có chức năng "cởi đồ" hoặc gợi dục hóa hình ảnh người thật sẽ phải chịu trách nhiệm pháp lý nghiêm khắc. Nếu nạn nhân khởi kiện, các nhà phát triển này sẽ phải đối mặt với các khoản bồi thường thiệt hại, bao gồm cả bồi thường phạt. Ngoài ra, các sản phẩm vi phạm cũng có nguy cơ bị chặn hoàn toàn tại tiểu bang.

Một điểm đáng chú ý trong luật là quyền hạn của Tổng chưởng lý Minnesota. Cơ quan này có thể áp đặt mức phạt hành chính lên tới 500.000 USD cho mỗi trường hợp ảnh nude giả bằng AI bị phát hiện. Các khoản tiền phạt thu được sẽ được dùng để tài trợ cho các dịch vụ hỗ trợ nạn nhân của tấn công tình dục, bạo lực gia đình và lạm dụng trẻ em.

Đạo luật này đã được Thượng viện Minnesota thông qua với tỷ lệ đồng thuận 65–0 vào thứ Tư vừa qua, sau khi nhanh chóng vượt qua Hạ viện vào tuần trước. Thống đốc Tim Walz được dự kiến sẽ ký ban hành luật này trong thời gian tới. Nếu được thông qua, lệnh cấm sẽ chính thức có hiệu lực từ tháng 8 năm nay.

Đây được xem là bước đi mạnh mẽ nhằm kiểm soát các rủi ro từ công nghệ Deepfake và AI tạo sinh, đang ngày càng trở nên phổ biến và gây lo ngại về vấn đề xâm phạm quyền riêng tư trên toàn cầu.

Bài viết liên quan

Công nghệ

Spotify tung ra huy hiệu "Đã xác minh" để phân biệt nghệ sĩ thật và AI

01 tháng 5, 2026

Phần cứng

The X-Files và nỗi hoài niệm về kỷ nguyên công nghệ "chưa bị hỏng" của thập niên 90

01 tháng 5, 2026

Công nghệ

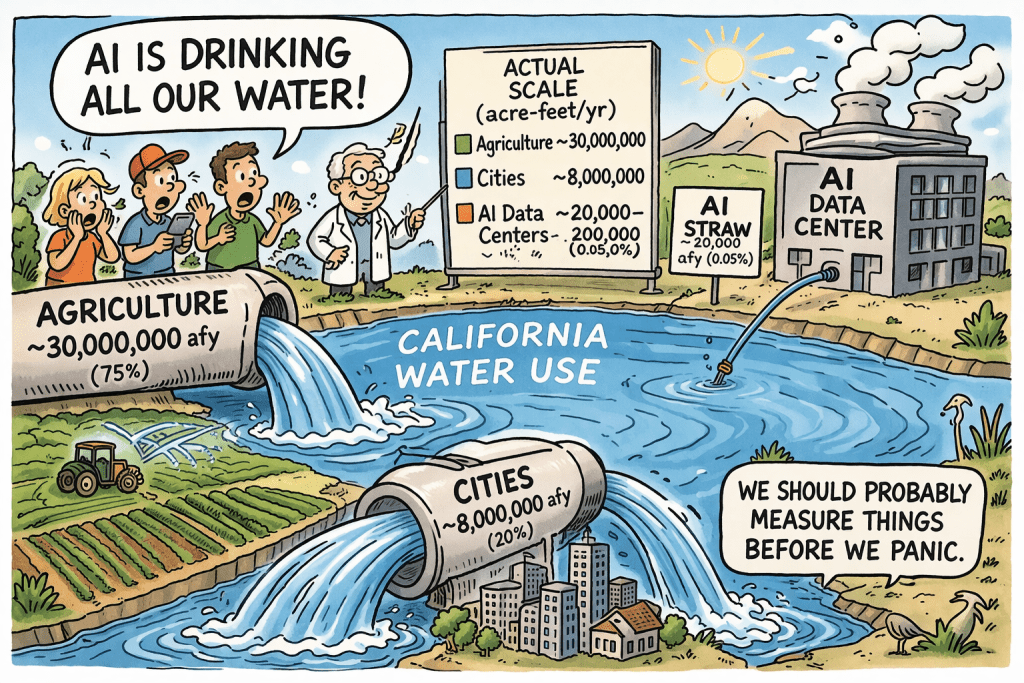

Tiêu thụ nước của AI: Thực tế ít đáng lo ngại hơn những gì công chúng nghĩ

01 tháng 5, 2026