OpenAI giải mã hạ tầng giúp AI giọng nói phản hồi tức thì ở quy mô lớn

OpenAI đã công bố chi tiết về kỹ thuật đằng sau khả năng xử lý giọng nói thời gian thực với độ trễ cực thấp, mang lại trải nghiệm hội thoại tự nhiên như con người. Bài viết tiết lộ các giải pháp tối ưu hóa quy trình từ âm thanh đầu vào đến đầu ra, giúp hệ thống vận hành trơn tru ngay cả khi phục vụ lượng người dùng khổng lồ. Đây là bước đột phá quan trọng, mở đường cho các ứng dụng AI thực tế trong tương lai.

Trong một bài đăng kỹ thuật mới đây, OpenAI đã đi sâu vào chi tiết về cách họ xây dựng hệ thống AI giọng nói có khả năng phản hồi gần như tức thì. Đây là một bước tiến quan trọng, giải quyết bài toán khó khăn nhất trong việc tạo ra các trợ lý ảo có thể hội thoại tự nhiên như con người: độ trễ (latency).

Để đạt được điều này, OpenAI đã phải thiết kế lại toàn bộ quy trình xử lý dữ liệu âm thanh và tối ưu hóa hạ tầng ở quy mô toàn cầu.

Thách thức về độ trễ trong AI giọng nói

Trong các mô hình truyền thống, quy trình xử lý giọng nói thường diễn ra theo kiểu "thác nước" (cascaded). Âm thanh đầu vào sẽ được chuyển thành văn bản (Speech-to-Text), sau đó văn bản này được xử lý bởi mô hình ngôn ngữ lớn (LLM), và cuối cùng văn bản trả lời được chuyển lại thành giọng nói (Text-to-Speech).

Mỗi bước trong quy trình này đều tiêu tốn thời gian xử lý và truyền tải, dẫn đến độ trễ tổng cộng thường từ 2 đến 3 giây hoặc hơn. Khoảng lặng này làm gián đoạn dòng chảy của cuộc hội thoại, khiến người dùng cảm thấy máy móc và thiếu kết nối.

Giải pháp mô hình đa phương thức nội tại

OpenAI đã thay đổi cuộc chơi bằng cách sử dụng các mô hình đa phương thức nội tại như GPT-4o. Thay vì chuyển đổi âm thanh sang văn bản, mô hình này có thể xử lý trực tiếp các tần số âm thanh (audio frequencies) dưới dạng token.

Điều này cho phép mô hình hiểu được các sắc thái của giọng nói như ngữ điệu, cảm xúc và sự ngập ngừng, từ đó tạo ra phản hồi chính xác và tự nhiên hơn. Việc loại bỏ bước trung gian chuyển đổi sang văn bản giúp giảm đáng kể thời gian xử lý.

Tối ưu hóa truyền phát luồng (Streaming)

Một yếu tố then chốt khác là kỹ thuật truyền phát luồng. Thay vì đợi người dùng nói xong cả câu mới bắt đầu xử lý, hệ thống của OpenAI bắt đầu suy luận ngay khi nhận được những âm thanh đầu tiên.

Tương tự, ở phía đầu ra, âm thanh được truyền phát đến người dùng ngay lập tức khi các token âm thanh được tạo ra, thay vì đợi quá trình sinh thành hoàn tất. Cách tiếp cận song song này giúp giảm thiểu tối đa thời gian chờ đợi, đạt được độ trễ thấp ở mức hàng trăm mili-giây.

Hạ tầng quy mô lớn

Việc vận hành hệ thống này ở quy mô toàn cầu đòi hỏi hạ tầng mạng và máy chủ cực kỳ mạnh mẽ. OpenAI đã triển khai các giải pháp tối ưu hóa mạng để đảm bảo dữ liệu âm thanh được truyền đi với độ trễ mạng thấp nhất có thể.

Họ cũng sử dụng các kỹ thuật suy luận (inference) hiệu quả cao trên phần cứng chuyên dụng để đảm bảo rằng mô hình có thể xử lý hàng triệu yêu cầu đồng thời mà không làm giảm chất lượng dịch vụ.

Tầm quan trọng đối với tương lai của AI

Việc giảm độ trễ không chỉ là cải thiện trải nghiệm người dùng mà còn mở ra những khả năng ứng dụng hoàn toàn mới. Các ứng dụng như phiên dịch thời gian thực, hỗ trợ khách hàng tự động, hay trợ lý giáo dục cá nhân sẽ trở nên hiệu quả hơn nhiều khi có khả năng phản hồi tức thì.

Với những bước tiến này, ranh giới giữa tương tác với con người và máy móc đang dần bị xóa nhòa, mang lại một kỷ nguyên mới của giao diện người dùng dựa trên giọng nói.

Bài viết liên quan

Công nghệ

Trẻ em khoe qua mặt công nghệ kiểm tra độ tuổi chỉ bằng cách vẽ râu giả

04 tháng 5, 2026

Công nghệ

Cấu trúc thương mại dựa trên tác nhân của Amex: Cách hợp đồng ý định và token dùng một lần kiểm soát giao dịch AI

04 tháng 5, 2026

Công nghệ

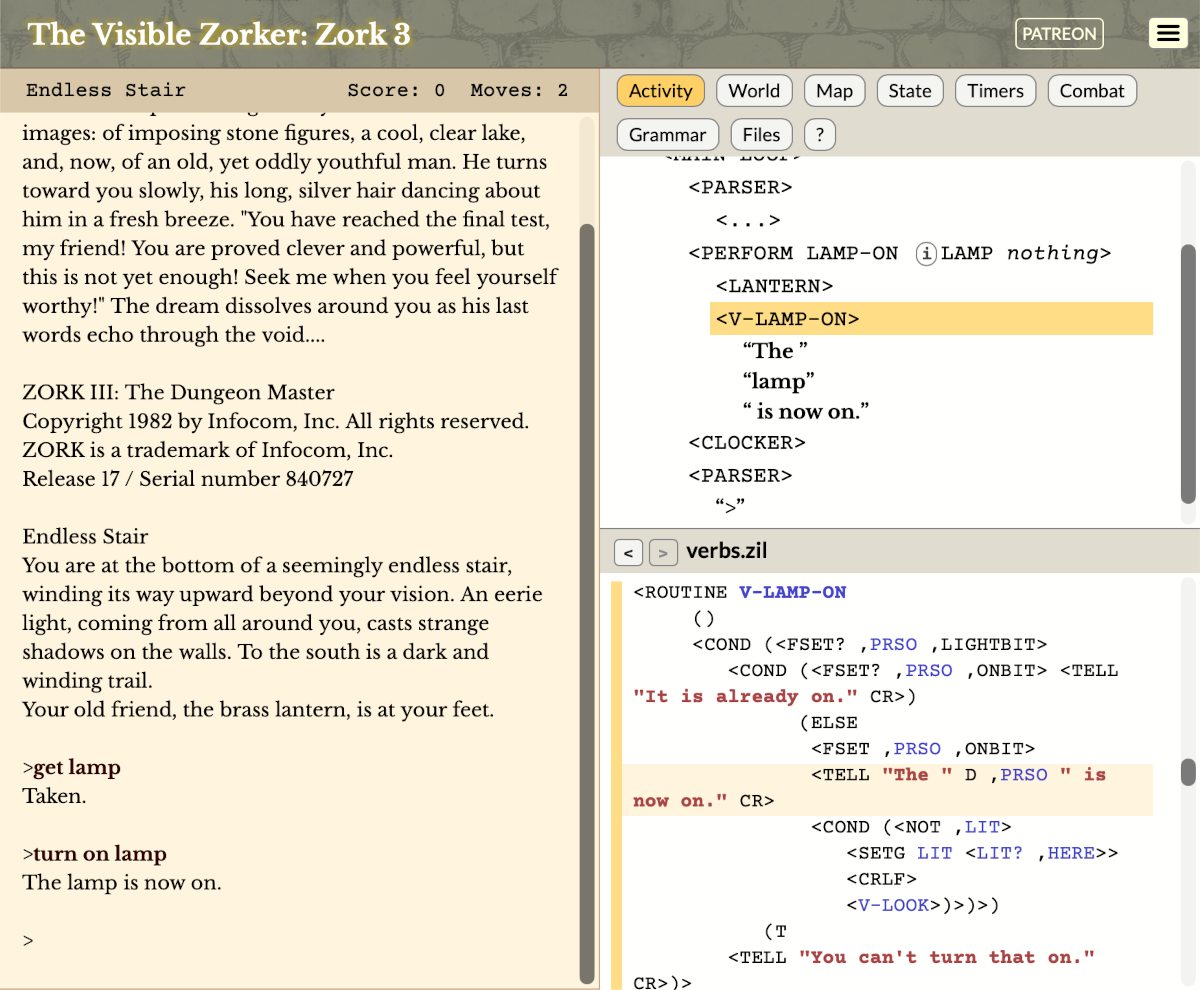

The Visible Zorker: Zork 3 - Khi thế giới game văn bản trở nên hữu hình

04 tháng 5, 2026