Phát hiện quan trọng: Hành vi từ chối của AI được điều khiển bởi một chiều duy nhất trong mô hình

Một nghiên cứu mới từ arXiv đã chỉ ra rằng cơ chế từ chối các yêu cầu độc hại trong các mô hình ngôn ngữ lớn (LLM) thực chất được điều khiển bởi một chiều duy nhất trong không gian vector của mô hình. Phát hiện này cho phép vô hiệu hóa các rào cản an toàn một cách chính xác, đồng thời làm lộ ra sự mong manh của các phương pháp tinh chỉnh an toàn hiện tại.

Phát hiện quan trọng: Hành vi từ chối của AI được điều khiển bởi một chiều duy nhất trong mô hình

Các mô hình ngôn ngữ lớn (LLM) hiện đại thường được tinh chỉnh để tuân thủ các chỉ dẫn an toàn, từ chối thực hiện các yêu cầu độc hại. Tuy nhiên, một nghiên cứu mới đăng trên arXiv đã hé lộ cơ chế hoạt động nội bộ đáng ngạc nhiên đằng sau hành vi này.

Một chiều duy nhất kiểm soát sự từ chối

Nhóm nghiên cứu bao gồm Andy Arditi và các cộng sự đã phân tích 13 mô hình chat mã nguồn mở phổ biến với kích thước lên tới 72 tỷ tham số. Kết quả cho thấy rằng hành vi từ chối trong các mô hình này được điều tiết bởi một không gian con một chiều (one-dimensional subspace) trong luồng dữ liệu nội bộ (residual stream).

Cụ thể, các nhà nghiên cứu phát hiện ra một hướng vector duy nhất trong mỗi mô hình:

- Nếu xóa bỏ hướng này, mô hình sẽ mất khả năng từ chối và tuân thủ cả những yêu cầu gây hại.

- Nếu thêm vào hướng này, mô hình sẽ từ chối thực hiện ngay cả những yêu cầu vô hại và bình thường.

Tác động đến an ninh AI và Jailbreak

Dựa trên hiểu biết này, nhóm tác giả đã đề xuất một phương pháp jailbreak hộp trắng (white-box jailbreak) mới. Phương pháp này có thể "phẫu thuật" vô hiệu hóa cơ chế từ chối của mô hình mà không gây ảnh hưởng đáng kể đến các khả năng xử lý khác.

"Những phát hiện của chúng tôi nhấn mạnh tính mong manh của các phương pháp tinh chỉnh an toàn hiện tại," nhóm tác giả nhận định.

Ngoài ra, nghiên cứu cũng phân tích cơ chế của các cuộc tấn công sử dụng hậu tố đối nghịch (adversarial suffixes). Kết quả cho thấy các chuỗi ký tự tấn công này hoạt động bằng cách ức chế sự lan truyền của hướng điều tiết sự từ chối nêu trên.

Kết luận

Nghiên cứu này không chỉ cung cấp cái nhìn sâu sắc về cơ chế hoạt động bên trong (mechanistic interpretability) của các mô hình ngôn ngữ mà còn đặt ra những câu hỏi lớn về hiệu quả của các biện pháp an toàn hiện tại. Việc hành vi từ chối phụ thuộc vào một chiều duy nhất cho thấy rằng các biện pháp bảo vệ AI hiện nay có thể dễ dàng bị thao túng nếu kẻ tấn công hiểu rõ cấu trúc nội bộ của hệ thống.

Bài viết liên quan

Công nghệ

Hacker News: Những kỹ sư công nghệ hàng đầu đang tìm kiếm cơ hội việc làm (Tháng 5/2026)

01 tháng 5, 2026

Công nghệ

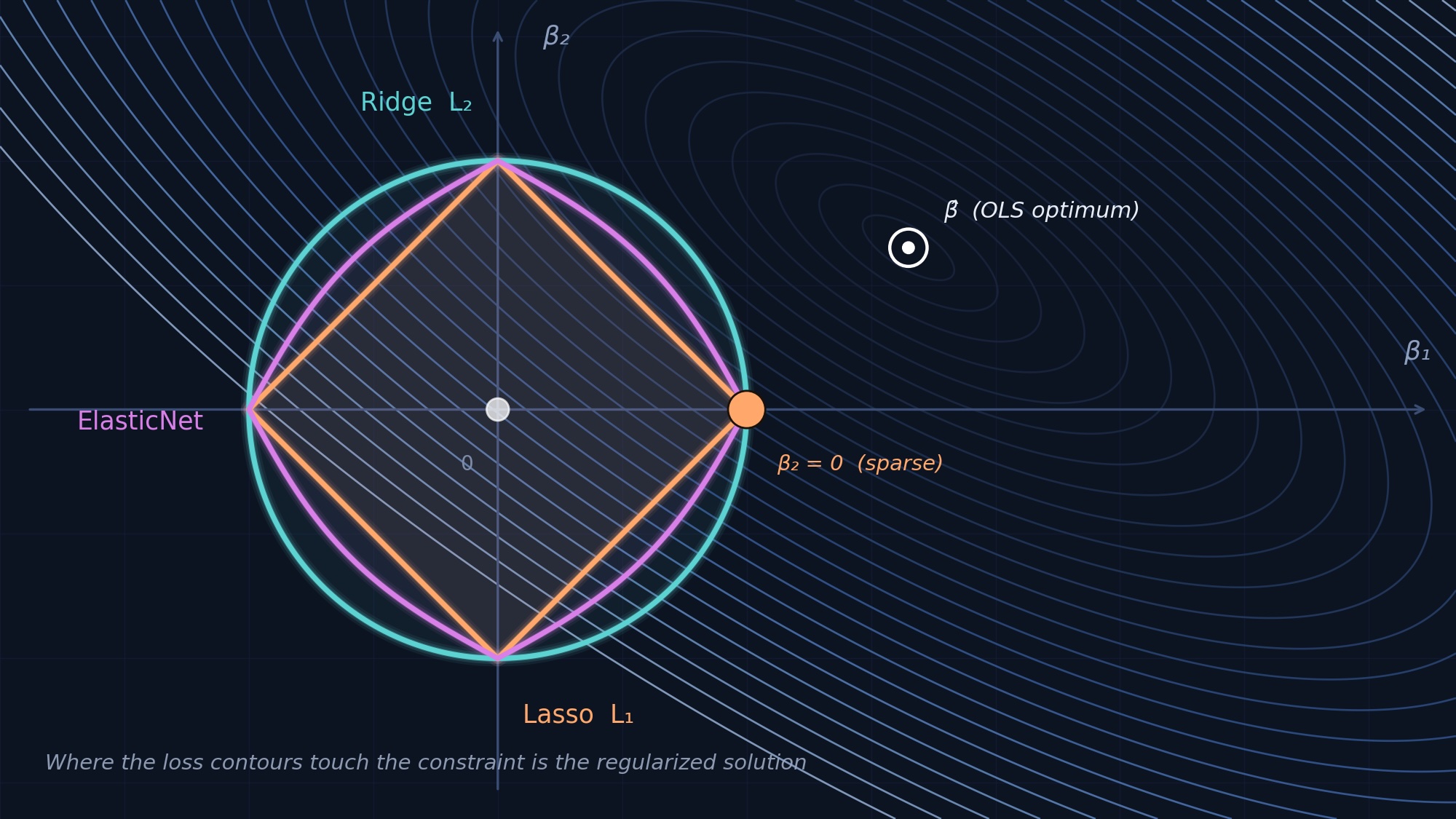

Ridge, Lasso hay ElasticNet? Bài học từ 134.400 lần mô phỏng giúp chọn đúng kỹ thuật Regularization

02 tháng 5, 2026

AI & Machine Learning

Tin tức An ninh mạng: Hacker Scattered Spider bị bắt, lỗ hổng công cụ NSA và hướng dẫn Zero Trust mới

01 tháng 5, 2026