Sam Altman và Matt Garman bàn về Bedrock Managed Agents: Khi AI trở thành "đồng nghiệp ảo"

OpenAI và AWS vừa công bố mối hợp tác chiến lược mang tên Bedrock Managed Agents, tích hợp các mô hình tiên tiến của OpenAI trực tiếp vào hạ tầng đám mây của Amazon. Cuộc phỏng vấn giữa CEO Sam Altman và Matt Garman đã làm rõ tầm nhìn về việc biến AI thành những tác nhân thông minh có thể tự động hóa quy trình làm việc trong doanh nghiệp, đồng thời thảo luận về sự thay đổi trong thỏa thuận độc quyền với Microsoft.

Trong một động thái đáng chú ý thay đổi cục diện của thị trường đám mây và AI, OpenAI và Amazon Web Services (AWS) đã công bố mối hợp tác sâu rộng mang tên Bedrock Managed Agents. Đây là kết quả của việc sửa đổi thỏa thuận giữa Microsoft và OpenAI, cho phép OpenAI cung cấp mô hình của mình trên các nền tảng đám mây khác ngoài Azure.

Để làm rõ hơn về sự hợp tác này, một cuộc phỏng vấn đã được thực hiện giữa Sam Altman (CEO của OpenAI) và Matt Garman (CEO của AWS). Dưới đây là những điểm nhấn chính về tương lai của các tác nhân AI (agents), chiến lược đám mây và phần cứng.

Thỏa thuận lịch sử giữa OpenAI và AWS

Trước đây, Azure là đối tác đám mây độc quyền của OpenAI, mang lại lợi thế cạnh tranh lớn cho Microsoft. Tuy nhiên, sự trỗi dậy nhanh chóng của Anthropic và nhu cầu của các doanh nghiệp muốn sử dụng mô hình AI trên đám mây mà họ đã chọn đã thúc đẩy sự thay đổi này.

Theo thỏa thuận mới, Microsoft vẫn là đối tác đám mây chính và các sản phẩm của OpenAI sẽ ra mắt đầu tiên trên Azure. Tuy nhiên, OpenAI giờ đây có quyền cung cấp tất cả sản phẩm của mình cho khách hàng trên bất kỳ nhà cung cấp đám mây nào. Điều này mở ra cơ hội to lớn cho AWS, nền tảng đang lưu trữ dữ liệu của phần lớn các doanh nghiệp lớn trên thế giới.

Bedrock Managed Agents: Tác nhân AI cho doanh nghiệp

Sản phẩm cốt lõi của sự hợp tác này là Bedrock Managed Agents. Đây không chỉ là việc cung cấp API truy cập vào các mô hình của OpenAI trên AWS. Thay vào đó, đó là một dịch vụ được quản lý hoàn toàn, nơi các mô hình tiên tiến của OpenAI được đóng gói bên trong môi trường runtime gốc của AWS.

Matt Garman giải thích rằng khách hàng trước đây phải tự kết nối các mô hình với hệ thống nội bộ, dữ liệu và công cụ bảo mật của mình. Với Bedrock Managed Agents, tất cả những thứ này được tích hợp sẵn. Sam Altman mô tả giai đoạn tiếp theo của AI không chỉ là trả lời văn bản, mà là tạo ra các "đồng nghiệp ảo" có thể thực hiện công việc thực tế bên trong một công ty.

Tầm quan trọng của "Harness" và Môi trường vận hành

Một điểm nhấn quan trọng trong cuộc thảo luận là vai trò của "harness" — hay môi trường vận hành bao quanh mô hình AI. Altman cho rằng ông không còn coi mô hình và môi trường vận hành là hai thứ tách biệt. Để các tác nhân AI hoạt động hiệu quả, chúng cần có trạng thái (state), bộ nhớ, quyền hạn và khả năng đánh giá (evals) được tích hợp chặt chẽ.

Ông so sánh việc này với thời kỳ đầu của điện toán đám mây: bạn có thể tự xây dựng trung tâm dữ liệu (colocation) nếu chịu khó, nhưng AWS đã giúp mọi người thực hiện điều đó chỉ bằng vài cú nhấp chuột. Tương tự, Bedrock Managed Agents nhằm giảm "năng lượng kích hoạt" để các doanh nghiệp dễ dàng triển khai AI hơn bao giờ hết.

Local vs. Cloud: Sự cân bằng giữa bảo mật và khả năng mở rộng

Khi thảo luận về việc chạy AI cục bộ (local) hay trên đám mây, cả hai CEO đều thừa nhận lợi ích của từng phương án. Chạy cục bộ (như Codex) dễ dàng hơn về mặt bảo mật và quyền truy cập dữ liệu ngay lập tức, nhưng đám mây mới là nơi cần thiết để mở rộng quy mô, cộng tác và chia sẻ tác nhân giữa các nhân viên trong doanh nghiệp.

Garman nhấn mạnh rằng AWS cung cấp các cấu trúc bảo mật đã được xây dựng trong 20 năm (như VPC, IAM) giúp các ngân hàng và cơ quan chính phủ yên tâm triển khai AI. Việc chạy tác nhân trong môi trường được quản lý của AWS cho phép kiểm soát biên giới bảo mật tốt hơn nhiều so với việc tự xây dựng.

AgentCore và Managed Agents: Lựa chọn cho người xây dựng

AWS cung cấp hai cách tiếp cận cho khách hàng:

- AgentCore: Một tập hợp các khối xây dựng nguyên thủy (primitives) cho phép các nhà phát triển tự cấu hình bộ nhớ, môi trường thực thi an toàn và quyền hạn. Đây là dành cho những người muốn tự tay "lắp ráp" hệ thống của mình.

- Bedrock Managed Agents: Một dịch vụ được quản lý, tích hợp sẵn mọi thứ, giúp khách hàng đi đến giá trị thực tế nhanh hơn mà không cần lo lắng về cấu hình kỹ thuật phức tạp.

Sự hợp tác với OpenAI hiện tại là độc quyền cho dịch vụ Managed Agents trên AWS, tận dụng tối đa các API và hạ tầng của Amazon.

Trainium và Tương lai của phần cứng AI

Cuộc phỏng vấn cũng chạm đến vấn đề phần cứng với chip Trainium của AWS. Mặc dù tên gọi gợi nhớ đến việc huấn luyện (training), nhưng chip này đóng vai trò quan trọng trong cả suy luận (inference) và huấn luyện.

Garman và Altman đều đồng ý rằng hầu hết người dùng cuối sẽ không bao giờ tương tác trực tiếp với phần cứng (GPU hay Trainium). Thay vào đó, họ quan tâm đến "đơn vị thông minh" nhận được với chi phí thấp nhất. Altman dự đoán mô hình định giá có thể chuyển từ tính theo token sang tính theo nhiệm vụ hoàn thành, khi các mô hình ngày càng thông minh hơn và cần ít token hơn để đưa ra câu trả lời.

Với Bedrock Managed Agents, AWS và OpenAI đang đặt cược vào việc hạ thấp rào cản để doanh nghiệp áp dụng AI, biến những công nghệ phức tạp thành công cụ hữu dụng hàng ngày.

Bài viết liên quan

Phần cứng

Google chính thức bán chip TPU cho khách hàng bên ngoài, đáp ứng nhu cầu AI bùng nổ

30 tháng 4, 2026

Phần cứng

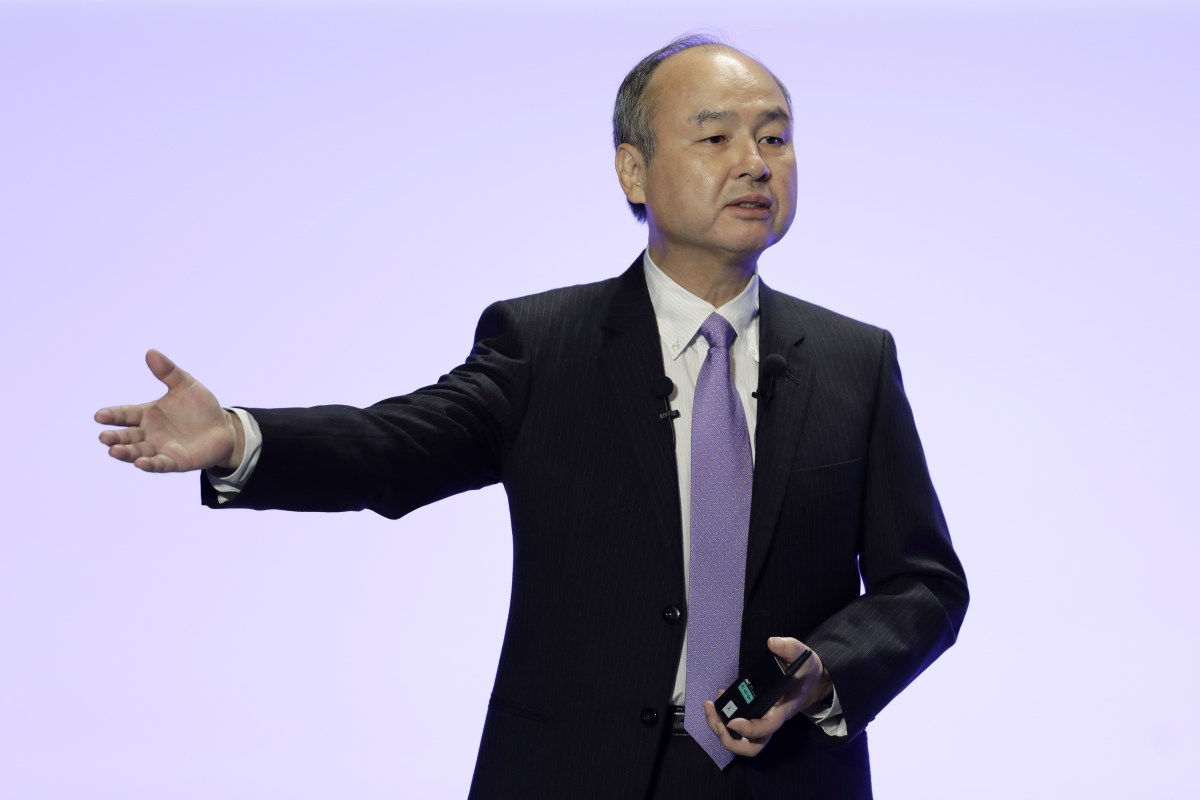

SoftBank thành lập công ty robot xây dựng trung tâm dữ liệu, nhắm tới IPO 100 tỷ USD

30 tháng 4, 2026

Công nghệ

Taxi bay điện của Joby thực hiện chuyến bay lịch sử từ JFK, mở ra tương lai giao thông tại New York

30 tháng 4, 2026