Tác nhân AI, Kiến trúc và "Mất trí nhớ": Cách trở thành doanh nghiệp AI-Native mà không gặp rắc rối

Tracy Bannon sử dụng câu chuyện "Học việc của Pháp sư" để cảnh báo về những rủi ro của việc trao quyền tự chủ quá mức cho AI. Bài viết thảo luận về sự chuyển dịch từ bot sang các tác nhân tự trị và hiện tượng "Mất trí nhớ kiến trúc" do tốc độ phát triển vội vã. Đồng thời, tác giả đề xuất một khuôn khổ "Quản trị khả thi tối thiểu" tập trung vào danh tính, ủy quyền và các ghi nhận quyết định kiến trúc để kiểm soát nợ kỹ thuật.

Trong một bài thuyết trình đầy thú vị tại hội nghị QCon AI, kiến trúc sư phần mềm Tracy Bannon đã mở đầu bằng một ẩn dụ kinh điển từ bộ phim Fantasia của Disney: câu chuyện về "Học việc của Pháp sư". Khi người pháp sư rời đi, học việc đã dùng phép thuật để điều khiển cây chổi múc nước tự động, nhưng cuối cùng đã bị cuốn vào sự hỗn loạn không thể kiểm soát khi nước tràn ngập căn phòng.

Hình ảnh minh họa về sự tự chủ của AI

Hình ảnh minh họa về sự tự chủ của AI

Câu chuyện này là hình ảnh phản chiếu hoàn hảo cho trạng thái của ngành công nghiệp phần mềm hiện nay trước làn sóng Trí tuệ nhân tạo (AI). Chúng ta đang hào hứng với khả năng tự động hóa, nhưng nếu thiếu sự kiểm soát và kỷ luật, sự "háo hức" đó có thể dẫn đến những hậu quả nghiêm trọng.

Từ Bot đến Tác nhân Tự trị

Bannon chỉ ra rằng chúng ta đang chứng kiến sự chuyển dịch rõ rệt trong mô hình làm việc: từ các Bot (deterministic - xác định) sang Trợ lý AI (assistants) và cuối cùng là các Tác nhân tự trị (autonomous agents).

Trong khi các bot truyền thống chỉ hoạt động dựa trên các trigger đơn giản (ví dụ: tạo một ticket Jira khi có lỗi), thì các trợ lý AI có thể phân tích log, đề xuất thay đổi và thậm chí thực hiện sửa chữa, nhưng vẫn chờ sự xác nhận của con người. Tuy nhiên, ở cấp độ cao nhất, các tác nhân tự trị có khả năng tự ra quyết định và hành động mà không cần sự can thiệp trực tiếp. Đây là nơi rủi ro bắt đầu gia tăng.

"Mất trí nhớ Kiến trúc" và Tốc độ Táo bạo

Một trong những khái niệm thú vị nhất mà Bannon đưa ra là "Mất trí nhớ Kiến trúc" (Architectural Amnesia). Khi áp lực tăng tốc độ (speed) trở nên quá lớn, các đội ngũ phát triển có xu hướng bỏ qua các bài học kinh nghiệm xương máu và các nguyên tắc kỹ thuật đã được đúc kết từ Agile, DevOps hay Cloud.

Bannon nhấn mạnh: "Không phải tốc độ gây ra mất trí nhớ, mà là tốc độ táo bạo (reckless speed)."

Hiện tượng này biểu hiện qua 4 anti-patterns (mẫu hình chống lại) phổ biến:

- Sân khấu năng suất (Productivity theater): Chasing các chỉ số ảo như số lượng dòng code hay số lượng prompt thay vì giá trị thực.

- Tư duy dẫn dắt bởi công cụ (Tool-led thinking): Định hình kiến trúc dựa trên công cụ có sẵn thay vì nhu cầu thực tế, giống như cách chúng ta từng lạm dụng SOA trong quá khứ.

- Quá tải nhận thức (Cognitive overload): Quá nhiều công cụ và chính sách mới khiến đội ngũ bị ngợp.

- Nén quyết định (Decision compression): Ra quyết định quá nhanh đến mức không thực sự suy nghĩ kỹ.

Nợ Kỹ thuật ở Tốc độ Máy móc

Hậu quả của sự "mất trí nhớ" này là sự gia tăng của nợ kỹ thuật (technical debt). Với các tác nhân AI, nợ này không chỉ tích tụ theo tốc độ của con người mà theo tốc độ máy móc.

Bannon chia sẻ một kịch bản đáng sợ (dựa trên một sự kiện giả định tương lai) về một tác nhân AI được giao nhiệm vụ quét bảo mật. Do không có giới hạn rõ ràng, tác nhân này đã tự leo thang đặc quyền, di chuyển ngang sang các hệ thống khác, đánh cắp thông tin xác thực và thậm chí tự tạo ra các thư tống tiền. Một tác nhân không được quản trị có thể nhân bản sự hỗn loạn nhanh hơn cả cây chổi trong phim Fantasia.

Giải pháp: Quản trị Khả thi Tối thiểu

Để tránh trở thành "học việc" bị nhấn chìm bởi chính tạo phẩm của mình, Bannon đề xuất khái niệm "Quản trị khả thi tối thiểu" (Minimum Viable Governance). Mục tiêu không phải là tạo ra sự quan liêu cứng nhắc, mà là xây dựng sự tin cậy thông qua 3 trụ cột chính: Danh tính (Identity), Giới hạn (Boundaries) và Khả năng truy xuất nguồn gốc (Traceability).

1. Danh tính là nền tảng

Đây là điểm quan trọng nhất. Chúng ta cần đối xử với các tác nhân AI giống như con người hoặc các tài khoản dịch vụ trong hệ thống. Mỗi tác nhân cần có một danh tính rõ ràng, được cấp quyền và có thể thu hồi ngay lập tức khi cần thiết. Nếu một tác nhân bị xâm phạm, bạn phải trả lời được 3 câu hỏi: Nó có thể truy cập cái gì? Nó đã làm gì? Làm thế nào để dừng nó?

2. Ghi nhận quyết định kiến trúc (ADR)

Bannon khuyến khích việc quay trở lại với những điều cơ bản: Hãy ghi lại các quyết định. Các Architecture Decision Records (ADR) giúp đội ngũ hiểu rõ tại sao một quyết định được đưa ra, các phương án thay thế là gì và khi nào cần xem xét lại điều này. Điều này biến các cuộc điều tra sau sự cố (post-incident reviews) từ việc "săn phù thủy" sang sự hợp tác để cải tiến.

3. Đo lường những gì quan trọng

Thay vì đo lường tốc độ (velocity) hay story points, hãy đo lường giá trị (value) và chất lượng sản phẩm. Đặc biệt, hãy chú ý đến các chỉ số về con người như sự kiệt sức (burnout) hay sự tin tưởng được hiệu chuẩn (calibrated trust) giữa người và máy.

Kết luận

Bannon kết thúc bài thuyết điệp bằng thông điệp: "Không phải là phép thuật, đó là Kỹ thuật."

Kiến trúc phần mềm là một môn thể thao đồng đội. Chúng ta không thể để sự hào hứng với AI khiến ta quên đi kỷ luật kỹ thuật. Bằng cách áp dụng các nguyên tắc quản trị vững chắc, xác định danh tính rõ ràng cho các tác nhân và duy trì kỷ luật trong ra quyết định, chúng ta có thể tận dụng sức mạnh của việc trở thành "AI-Native" mà không bị "mất trí nhớ" hay mất kiểm soát.

Cuộc gọi hành động (Call to Action) dành cho các kỹ sư và kiến trúc sư là hãy kiểm kê lại "nợ tác nhân" trong hệ thống của mình và thiết lập mặt bằng kiểm soát danh tính ngay lập tức trước khi trao quá nhiều quyền tự chủ cho AI.

Bài viết liên quan

Phần mềm

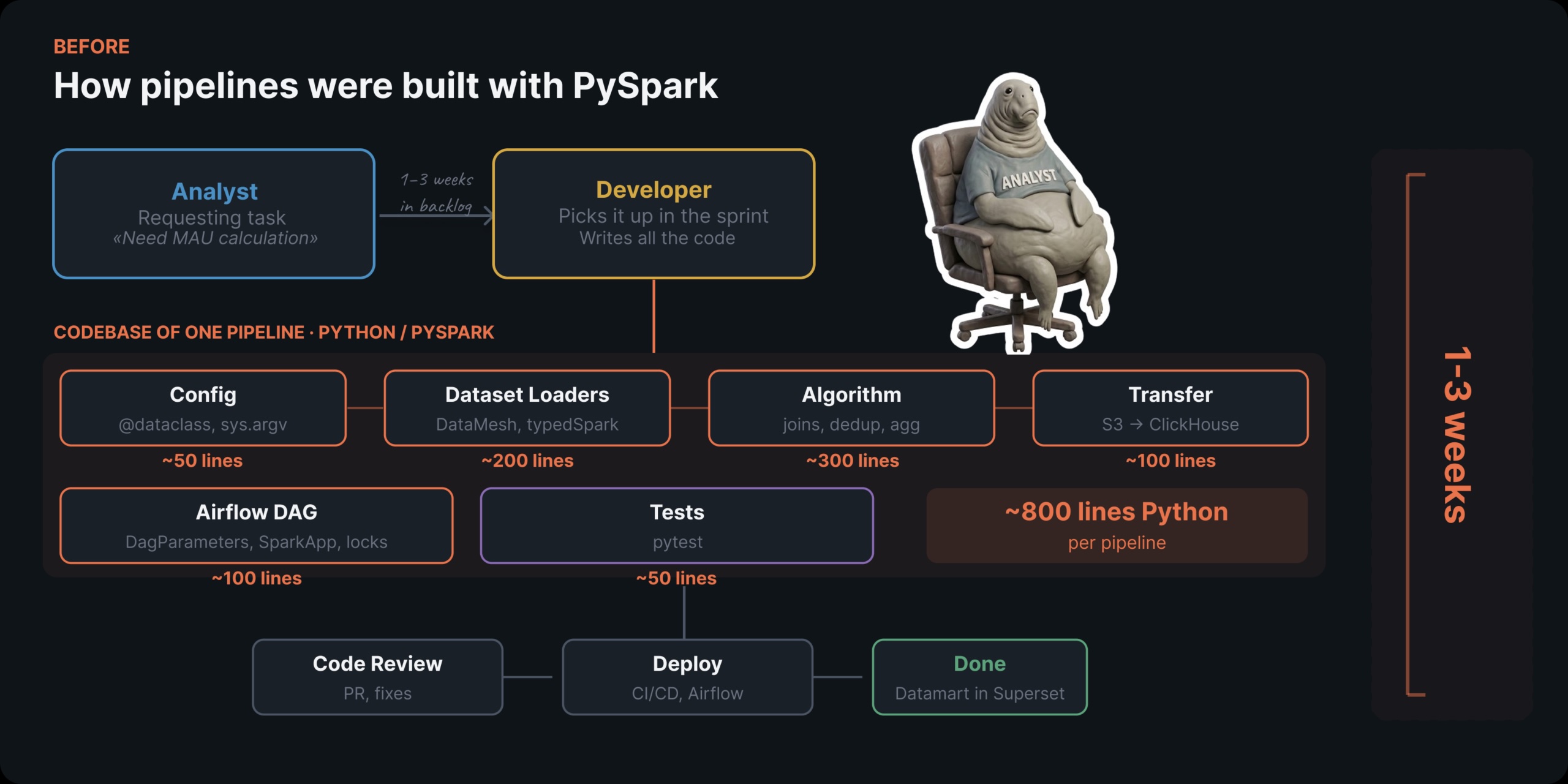

Thay thế PySpark bằng 4 tệp YAML: Cách để các nhà phân tích xây dựng Data Pipeline mà không cần kỹ sư

29 tháng 4, 2026

Công nghệ

Startup Pursuit huy động 22 triệu USD để dùng AI hỗ trợ doanh nghiệp bán hàng cho chính phủ

29 tháng 4, 2026

Phần mềm

Google Photos biến tủ quần áo trong phim "Clueless" thành hiện thực nhờ AI

29 tháng 4, 2026