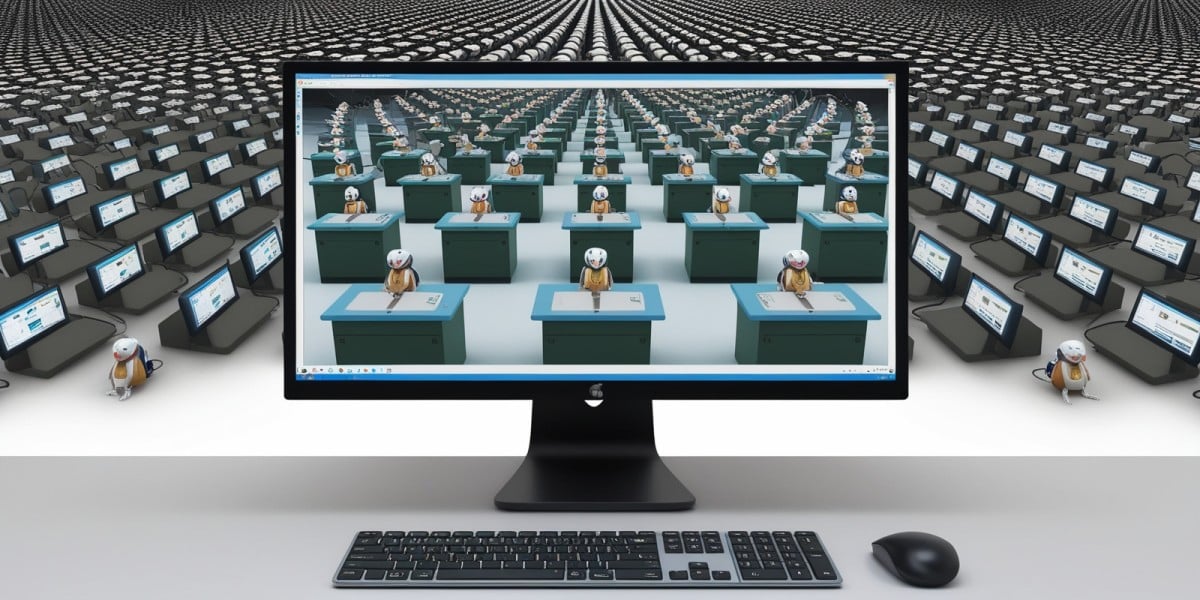

AI Agents: Hứa hẹn tự động hóa kinh doanh nhưng ai chịu trách nhiệm khi thất bại?

Các hãng phần mềm khẳng định AI Agents có thể quản lý doanh nghiệp. Tuy nhiên, khi AI đưa ra quyết định sai, ai là người chịu trách nhiệm? Các nhà quy định cho rằng con người vẫn phải chịu trách nhiệm. Các nhà cung cấp phần mềm lại e ngại rủi ro không lường trước được.

AI Agents: Hứa hẹn tự động hóa kinh doanh nhưng ai chịu trách nhiệm khi thất bại?

Khi các công nghệ AI Agents ngày càng được các nhà cung cấp phần mềm lớn như Oracle hứa hẹn sẽ tự động hóa và vận hành toàn bộ các quy trình kinh doanh, ranh giới trách nhiệm pháp lý giữa doanh nghiệp, người dùng và nhà cung cấp trở nên mơ hồ.

Trong bối cảnh đó, câu hỏi lớn nhất không còn là liệu AI có thể làm được gì, mà là ai sẽ phải chịu trách nhiệm khi "cỗ máy thống kê" này đưa ra quyết định sai lầm.

Sự mơ hồ trong trách nhiệm pháp lý

Các nhà cung cấp phần mềm lớn đang tận dụng cơ hội thị trường khổng lồ để bán các giải pháp AI Agents có khả năng tư duy, ra quyết định và thực thi quy trình liên tục trong các hệ thống kinh doanh.

Tuy nhiên, từ góc độ pháp lý, việc đưa ra các lời hứa về hành vi của AI là một thách thức lớn. Malcolm Dowden, luật sư công nghệ cấp cao tại Pinsent Masons, nhận định: "Nếu bạn muốn bảo hành về hành vi của một cái gì đó, nhưng nó vốn dĩ không dự đoán trước được, thì đó là một lời hứa hợp đồng rất khó thực hiện".

"Bạn không thể đổ lỗi cho cái hộp"

Khi AI Agents được triển khai để thay thế con người trong các quyết định quan trọng như quản trị tài chính hay tuyển dụng, rủi ro trở nên không thể lường trước. Các nhà quy định như Ủy ban Báo cáo Tài chính (FRC) tại Anh đã khẳng định rõ ràng: con người vẫn phải chịu trách nhiệm.

Mark Babington, Giám đốc điều hành của FRC, đã từng cảnh báo: "Bạn không thể đổ lỗi cho cái hộp. Nếu bạn sử dụng công nghệ này, bạn vẫn phải chịu trách nhiệm về nó". Điều này có nghĩa là các doanh nghiệp không thể đơn giản là đưa phần mềm vào vận hành và chờ đợi nhà cung cấp sửa chữa mọi sai sót.

Bảo mật và sự bất bình đẳng

Trong các trường hợp như lọc hồ sơ ứng viên tự động, các doanh nghiệp có nguy cơ vi phạm luật bảo vệ dữ liệu nếu họ không giám sát AI để loại bỏ sự thiên kiến (bias). Theo luật pháp Anh, doanh nghiệp là người chịu trách nhiệm về dữ liệu và sẽ tìm cách chuyển giao trách nhiệm này cho nhà cung cấp thông qua các điều khoản hợp đồng.

Tuy nhiên, các nhà cung cấp phần mềm thường phản đối việc nhận toàn bộ trách nhiệm. Họ sẽ đề xuất các điều khoản bảo hành rằng hệ thống đã được kiểm tra về sự thiên kiến, nhưng miễn trách nhiệm nếu sự thiên kiến xuất phát từ cách người dùng đưa ra lệnh (prompt) hoặc cấu trúc dữ liệu.

Chi phí khi thất bại là khổng lồ

Gartner dự đoán rằng vào giữa năm 2026, các quyết định sai trái do AI sẽ gây ra hơn 10 tỷ USD chi phí khắc phục cho các nhà cung cấp phần mềm và doanh nghiệp toàn cầu.

Để giảm thiểu rủi ro, Gartner khuyến nghị các tổ chức nên áp dụng "Defensible AI" - những kỹ thuật ra quyết định có khả năng withstand scrutiny (đáp ứng được sự kiểm tra, giám sát). Điều này đòi hỏi các doanh nghiệp phải có dữ liệu sẵn sàng cho AI, minh bạch hóa quy trình và áp dụng các hàng rào bảo vệ trong suốt vòng đời của hệ thống.

Kết luận

Hiện tại, các nhà cung cấp phần mềm đang chủ yếu "soft-launch" (phát hành thử nghiệm) các giải pháp AI Agents và chấp nhận rủi ro để giành lợi thế cạnh tranh. Trong khi đó, các doanh nghiệp sử dụng có thể chấp nhận rủi ro để đạt được hiệu quả quy trình, đặc biệt là trong ngành công nghệ thông tin.

Rõ ràng là, cho đến khi luật pháp trở nên rõ ràng hơn và các vụ việc tại tòa án được giải quyết, cuộc đua giữa việc triển khai AI nhanh chóng và việc quản lý rủi ro pháp lý vẫn sẽ tiếp diễn.

Bài viết liên quan

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026

Công nghệ

Spotify thắng kiện 322 triệu USD từ nhóm pirate Anna's Archive nhưng đối mặt với bài toán thu hồi

16 tháng 4, 2026