Cloudflare xây dựng hạ tầng hiệu suất cao để vận hành các mô hình ngôn ngữ lớn (LLM)

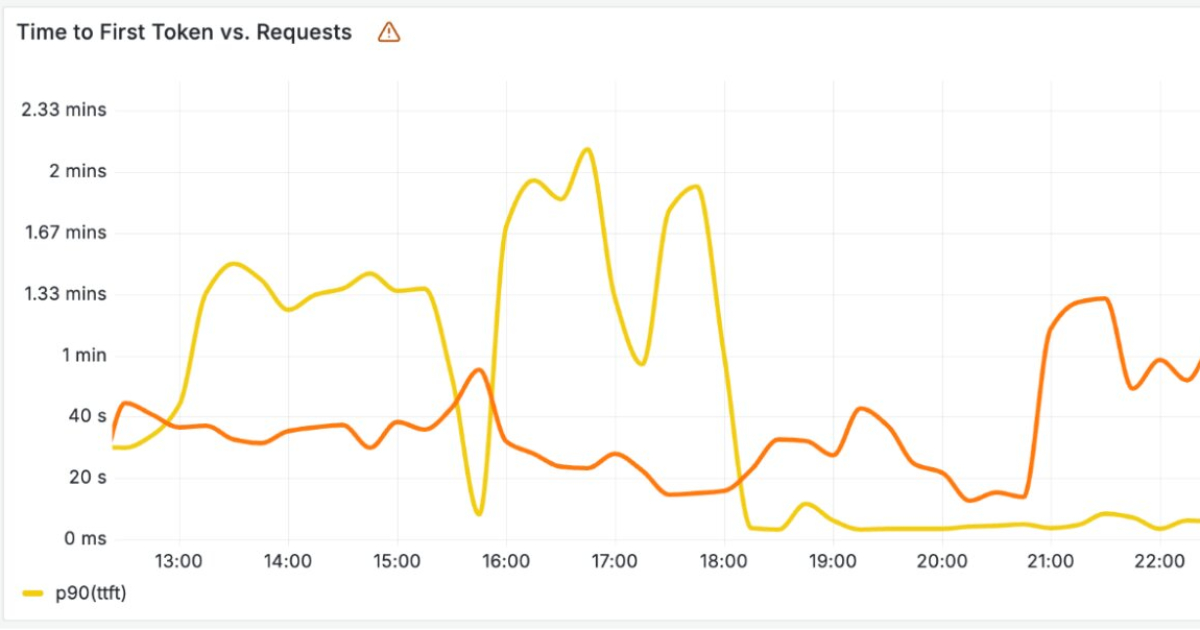

Cloudflare vừa công bố hạ tầng mới được thiết kế để chạy các mô hình ngôn ngữ lớn (LLM) trên mạng lưới toàn cầu của mình. Bằng cách tách biệt xử lý đầu vào và tạo đầu ra sang các hệ thống tối ưu hóa riêng biệt, cùng với động cơ suy luận tùy chỉnh Infire, Cloudflare giúp quản lý GPU hiệu quả hơn và giảm chi phí phần cứng đắt đỏ.

Cloudflare gần đây đã công bố một hạ tầng mới được thiết kế đặc biệt để vận hành các mô hình ngôn ngữ lớn (LLM) trên mạng lưới toàn cầu của mình. Do các mô hình này phụ thuộc vào phần cứng đắt đỏ và phải xử lý khối lượng văn bản đầu vào cũng như đầu ra khổng lồ, Cloudflare đã tách riêng quy trình xử lý đầu vào và tạo đầu ra của mô hình sang các hệ thống được tối ưu hóa khác nhau.

/filters:no_upscale()/news/2026/05/cloudflare-llm-infrastructure/en/resources/1BLOG-3266_2-1776661409906.png) Hạ tầng Cloudflare cho LLM

Hạ tầng Cloudflare cho LLM

Tối ưu hóa với Disaggregated Prefill

Theo nhóm Cloudflare, một cải tiến chính là việc chia nhỏ quy trình xử lý mô hình thành hai giai đoạn, mỗi giai đoạn được xử lý bởi một máy chủ riêng biệt: một giai đoạn đọc và chuẩn bị văn bản đầu vào, trong khi giai đoạn kia tạo ra văn bản đầu ra.

Michelle Chen (Quản lý sản phẩm chính), Kevin Flansburg (Quản lý kỹ thuật cao cấp) và Vlad Krasnov (Kỹ sư hệ thống chính) từ Cloudflare chia sẻ:

"Một cấu hình phần cứng mà chúng tôi sử dụng để cải thiện hiệu suất và hiệu quả là disaggregated prefill (tách biệt prefill). Có hai giai đoạn để xử lý yêu cầu LLM: prefill, xử lý các token đầu vào và điền vào bộ nhớ đệm KV, và decode, tạo ra các token đầu ra. Prefill thường bị giới hạn bởi khả năng tính toán (compute bound), trong khi decode lại bị giới hạn bởi bộ nhớ (memory bound)."

Động cơ suy luận tùy chỉnh Infire

Cloudflare cũng đã tạo ra một động cơ suy luận AI tùy chỉnh có tên Infire. Được công bố trong tuần sinh nhật Cloudflare năm 2025, Infire chạy các mô hình ngôn ngữ lớn trên nhiều GPU hiệu quả hơn, giảm mức sử dụng bộ nhớ và khởi động mô hình nhanh hơn, từ đó mang lại phản hồi nhanh hơn cho người dùng.

Các mô hình ngôn ngữ lớn như Kimi K2.5 có kích thước quá lớn (hơn 1 nghìn tỷ tham số và khoảng 560GB) nên chúng phải được phân tán trên nhiều GPU. Nó yêu cầu ít nhất tám GPU H100 chỉ để tải mô hình vào bộ nhớ, chưa tính đến bộ nhớ bổ sung được sử dụng trong quá trình xử lý.

Về lý do tại sao Infire và các tối ưu hóa phần cứng giúp chạy các mô hình khổng lồ hiệu quả hơn, nhóm kỹ sư giải thích:

"Đối với song song hóa đường ống (pipeline parallelism), Infire cố gắng cân bằng tải tất cả các giai đoạn của đường ống, nhằm ngăn chặn việc GPU của một giai đoạn bị thiếu hụt tài nguyên trong khi các giai đoạn khác đang thực thi. Mặt khác, đối với song song hóa tensor (tensor parallelism), Infire tối ưu hóa để giảm thiểu truyền thông giữa các GPU, làm cho quá trình này nhanh nhất có thể. Đối với hầu hết các mô hình, việc sử dụng cả pipeline parallelism và tensor parallelism song song sẽ cung cấp sự cân bằng tốt nhất giữa thông lượng và độ trễ."

Nén mô hình và hiệu quả bộ nhớ

Cloudflare cũng gần đây đã giới thiệu Unweight, một hệ thống mà công ty này tuyên bố có thể nén trọng số của các mô hình ngôn ngữ lớn khoảng 15–22% mà không làm giảm độ chính xác. Điều này giúp giảm lượng dữ liệu mà GPU cần tải và di chuyển trong quá trình suy luận, giúp các mô hình chạy nhanh hơn và hiệu quả hơn.

Theo Cloudflare, nhóm đã tối ưu hóa thêm Infire để giảm mức sử dụng bộ nhớ GPU cho các quy trình nội bộ, cho phép nó chạy mô hình Llama 4 Scout chỉ trên hai GPU H200 với dung lượng lớn cho các token ngữ cảnh, và Kimi K2.5 trên tám GPU H100 trong khi vẫn còn bộ nhớ dành cho bộ nhớ đệm KV. Các cấu hình này "sẽ gặp khó khăn ngay cả khi khởi động vLLM".

Cloudflare không phải là nhà cung cấp duy nhất nhấn mạnh những thách thức trong việc vận hành LLM trong môi trường sản xuất thực tế. Báo cáo gần đây của Cockroach Labs về "Trạng thái của Hạ tầng AI" chỉ ra rằng khi các công ty đưa hệ thống AI vào sử dụng hàng ngày, nhiều công ty nhận thấy hạ tầng hiện tại của họ chưa sẵn sàng để xử lý quy mô và độ tin cậy mà các khối lượng công việc này yêu cầu.

Bài viết liên quan

Phần cứng

Hải quân Hoàng gia Anh chuyển mình sang kỷ nguyên drone và vũ khí tự chủ

03 tháng 5, 2026

Phần cứng

Đánh giá Coway Airmega Mighty2: Bản nâng cấp vượt trội so với người tiền nhiệm

03 tháng 5, 2026

Công nghệ

Mạng lưới ngầm đưa công nghệ Starlink vào Iran để phá vỡ sự phong tỏa internet

03 tháng 5, 2026