Google Cloud ra mắt hai chip AI mới nhằm thách thức vị thế của Nvidia

Google vừa công bố thế hệ thứ 8 của chip TPU tùy chỉnh, bao gồm TPU 8t dành cho huấn luyện và TPU 8i cho suy luận, hứa hẹn hiệu suất nhanh hơn gấp 3 lần và tiết kiệm chi phí hơn. Tuy nhiên, công ty vẫn tiếp tục hợp tác chặt chẽ với Nvidia và sẽ cung cấp chip Vera Rubin mới nhất của đối thủ trên nền tảng đám mây của mình.

Google Cloud ra mắt hai chip AI mới nhằm thách thức vị thế của Nvidia

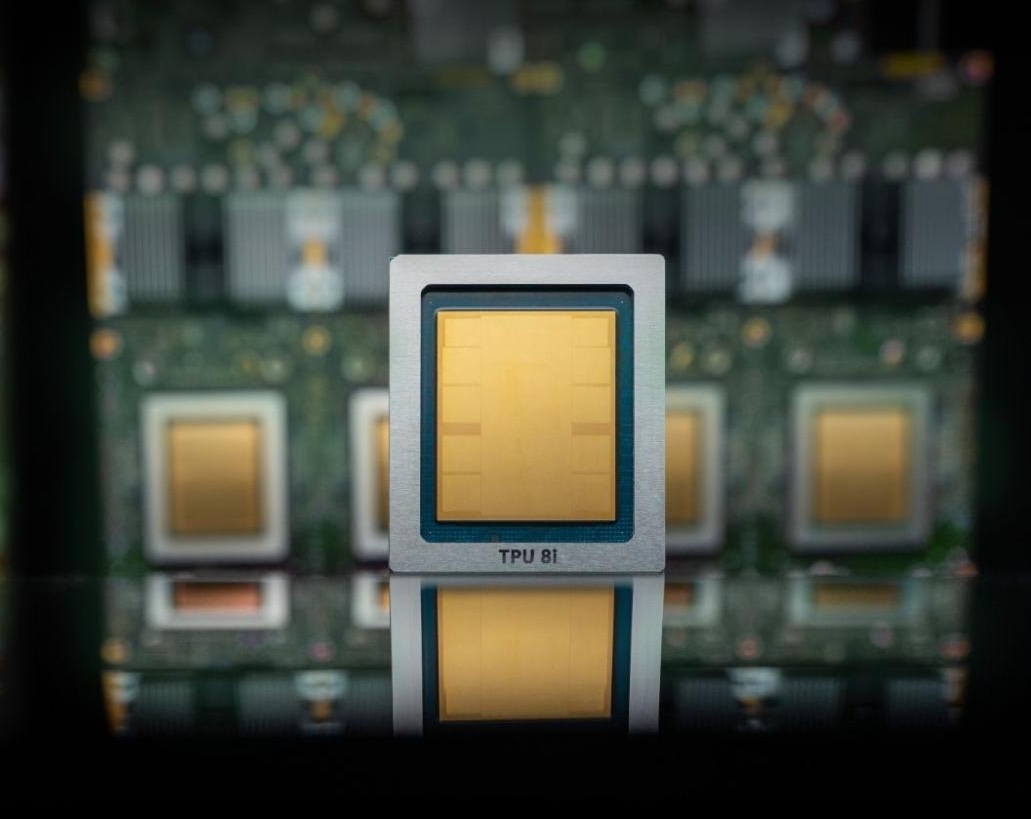

Vào thứ Tư vừa qua, Google Cloud đã công bố thế hệ thứ 8 của các chip AI tùy chỉnh (TPU - Tensor Processing Unit) sẽ được chia làm hai dòng sản phẩm riêng biệt. Một chip tên là TPU 8t được tối ưu hóa cho việc huấn luyện mô hình, trong khi chip còn lại, TPU 8i, được thiết kế chuyên biệt cho suy luận (inference) — quá trình sử dụng mô hình sau khi đã được huấn luyện để xử lý các yêu cầu của người dùng.

Hiệu suất vượt trội và tối ưu chi phí

Như mong đợi, Google đã công bố những thông số kỹ thuật ấn tượng cho các TPU mới này so với thế hệ trước. Theo đó, tốc độ huấn luyện mô hình AI nhanh hơn gấp 3 lần, hiệu suất trên mỗi đồng chi phí tốt hơn 80%, và khả năng kết nối hơn 1 triệu TPU hoạt động cùng nhau trong một cụm (cluster) duy nhất. Điều này hứa hẹn mang lại sức mạnh tính toán lớn hơn nhiều với mức tiêu thụ năng lượng và chi phí thấp hơn cho khách hàng so với các phiên bản trước. Google gọi chúng là TPU thay vì GPU vì chip tùy chỉnh tiết kiệm điện năng này ban đầu được đặt tên là Tensor.

Vẫn "kết thân" với Nvidia

Tuy nhiên, những con chip mới của Google không phải là một cuộc tấn công toàn diện vào tương lai của Nvidia, ít nhất là cho đến thời điểm hiện tại. Giống như các nhà cung cấp đám mây lớn khác bao gồm Microsoft và Amazon, Google sử dụng các chip này để bổ sung cho các hệ thống dựa trên Nvidia mà họ cung cấp trong cơ sở hạ tầng của mình, chứ không phải thay thế hoàn toàn Nvidia. Thực tế, Google cam kết đám mây của họ sẽ có chip mới nhất của Nvidia là Vera Rubin vào cuối năm nay.

Một ngày nào đó, các ông lớn xây dựng chip AI của riêng mình (bao gồm Amazon, Microsoft và Google) có thể sẽ bớt phụ thuộc vào Nvidia hơn, khi các doanh nghiệp chuyển nhu cầu AI sang các đám mây này và chuyển đổi ứng dụng sang các chip này.

Tuy nhiên, xét ở thời điểm hiện tại, việc đặt cược chống lại Nvidia là không khôn ngoan. Nhà phân tích thị trường chip Patrick Moore đã đăng tải một cách hài hước trên X rằng ông từng dự đoán TPU của Google có thể là tin xấu cho Nvidia (và Intel) vào năm 2016 khi gã khổng lồ tìm kiếm ra mắt chip đầu tiên. Giờ đây, Nvidia là một công ty có giá trị vốn hóa thị trường gần 5 nghìn tỷ USD, nghĩa là dự đoán đó không đúng với thực tế.

Nếu mọi thứ diễn ra theo kế hoạch của Nvidia, sự tăng trưởng của Google với tư cách là nhà cung cấp đám mây AI sẽ mang lại nhiều doanh thu hơn cho nhà sản xuất chip này chứ không phải ít hơn, ngay cả khi nhiều khối lượng công việc chạy trên chip của Google.

Hợp tác nâng cấp mạng lưới

Thực tế, Google cũng cho biết họ đã đồng ý hợp tác với Nvidia để thiết kế mạng máy tính cho phép các hệ thống dựa trên Nvidia hoạt động hiệu quả hơn trên đám mây của Google. Cụ thể, hai gã khổng lồ công nghệ này đang làm việc để củng cố công nghệ mạng dựa trên phần mềm có tên Falcon, mà Google đã tạo ra và mã nguồn mở vào năm 2023 dưới sự bảo trợ của Tổ chức Dự án Máy tính Mã nguồn Mở (Open Compute Project).

Bài viết liên quan

Công nghệ

Microsoft giới thiệu Surface Pro 12 và Surface Laptop 8: Sức mạnh chip Intel, giá thành gây sốc

19 tháng 5, 2026

Công nghệ

Đánh giá Corsair Galleon 100 SD: Khi Stream Deck được tích hợp ngay trên bàn phím

27 tháng 5, 2026

Công nghệ

Hiệp hội ngành cáp cảnh báo hỗn loạn nếu FCC không nới lỏng lệnh cấm router nước ngoài

04 tháng 6, 2026