Google công bố TPU thế hệ thứ 8: Bước tiến lớn cho AI Agents và huấn luyện mô hình SOTA

Google vừa giới thiệu thế hệ thứ 8 của Tensor Processing Units (TPU) với hai biến thể chip chuyên biệt là TPU 8t và TPU 8i. Các chip mới này được thiết kế để tăng tốc độ huấn luyện các mô hình tiên tiến và tối ưu hóa quy trình làm việc của các tác nhân AI (AI Agents). Google khẳng định thế hệ mới mang lại hiệu suất, bộ nhớ và hiệu quả năng lượng vượt trội so với các phiên bản trước.

Google đã chính thức tung ra thế hệ tiếp theo của Tensor Processing Units (TPU), bao gồm hai chip chuyên biệt được thiết kế để tăng tốc độ huấn luyện mô hình và quy trình làm việc của các tác nhân AI (AI Agents). Những tác nhân này đòi hỏi khả năng lập luận đa bước liên tục và các vòng lặp hành động được phân phối trên nhiều mô hình. Theo Google, thế hệ TPU mới này mang lại hiệu suất, bộ nhớ và hiệu quả năng lượng được cải thiện đáng kể.

Sự trỗi dậy của AI Agents đang tạo ra nhu cầu cấp thiết về các loại chip riêng biệt, được tối ưu hóa riêng cho việc huấn luyện (training) và suy luận (inference). Google nhận định rằng việc tách biệt hai dòng chip này sẽ giúp mở rộng lợi ích hiệu suất đáng kể cho các khối lượng công việc cụ thể mà chúng xử lý.

TPU 8t: Quy mô và tốc độ cho huấn luyện

TPU 8t tỏa sáng trong các khối lượng công việc huấn luyện quy mô lớn, tiêu tốn nhiều tài nguyên tính toán. Chip này được thiết kế với khả năng xử lý tính toán lớn hơn và băng thông mở rộng quy mô (scale-up bandwidth) cao hơn.

Về phía huấn luyện, chip mới nhằm mục đích tối đa hóa quy mô và tốc độ thô. Google cho biết chip này được thiết kế để giảm thời gian cần thiết để huấn luyện các mô hình tiên tiến (frontier models) "từ vài tháng xuống còn vài tuần". Điều này đạt được bằng cách tăng mật độ tính toán, dung lượng bộ nhớ và băng thông trên các cụm lớn, mang lại hiệu suất tính toán cao gấp gần 3 lần so với thế hệ trước.

Một siêu cụm (superpod) TPU 8t duy nhất hiện có thể mở rộng lên đến 9.600 chip và hai petabyte bộ nhớ băng thông cao chia sẻ, với băng thông giữa các chip tăng gấp đôi so với thế hệ trước. Kiến trúc này cung cấp 121 ExaFlops sức mạnh tính toán và cho phép các mô hình phức tạp nhất tận dụng một vùng bộ nhớ khổng lồ, thống nhất.

Google khẳng định hệ thống này có thể mở rộng gần như tuyến tính lên đến một triệu chip trong một cụm cục bộ đơn lẻ. Ngoài quy mô, thiết kế cũng tối đa hóa việc sử dụng thông qua bộ nhớ nhanh hơn 10 lần và tăng độ tin cậy, khả năng sẵn sàng và khả năng bảo trì để giảm thời gian chết do lỗi phần cứng, tắc nghẽn mạng hoặc khởi động lại checkpoint.

TPU 8i: Hiệu quả và độ trễ thấp cho AI Agents

Về phía suy luận, chip TPU 8i chuyển ưu tiên sang khả năng phản hồi và hiệu quả dưới tải liên tục. Google lưu ý rằng khối lượng công việc của AI Agents bao gồm các ngữ cảnh dài, thao tác tốn nhiều bộ nhớ và các yêu cầu đồng thời từ nhiều tác nhân khác nhau.

Chip được tối ưu hóa để giảm độ trễ bằng cách chuyển các hoạt động toàn cầu, tăng băng thông bộ nhớ lên tới 288GB và cải thiện hiệu suất trên mỗi đồng đô la lên 80%.

Đối với các mô hình Mixture of Experts (MoE) hiện đại, Google đã tăng gấp đôi băng thông kết nối liên kết (ICI) lên 19,2 Tb/s. Kiến trúc Boardfly mới giảm đường kính mạng tối đa hơn 50%, đảm bảo hệ thống hoạt động như một đơn vị thống nhất với độ trễ thấp.

Triết lý thiết kế và góc nhìn từ cộng đồng

Bên cạnh những cải tiến đáng kể mà các chip mới sẽ mang lại, triết lý của Google TPU vẫn phần lớn nhất quán qua nhiều năm.

"Sự hiểu biết cốt lõi đằng sau thiết kế TPU ban đầu vẫn tiếp diễn cho đến ngày nay: bằng cách tùy chỉnh và đồng thiết kế silicon với phần cứng, mạng lưới và phần mềm, bao gồm cả kiến trúc mô hình và yêu cầu ứng dụng, chúng tôi có thể mang lại hiệu quả năng lượng và hiệu suất tuyệt đối mạnh mẽ hơn nhiều."

Cảm nhận này được cộng đồng kỹ thuật phản hồi tích cực. Nhiều ý kiến cho rằng Google sở hữu toàn bộ chuỗi cung ứng từ bàn phím đến silicon, cho phép họ hiểu rõ cách tách biệt các chức năng cạnh tranh nhau về tài nguyên.

Tuy nhiên, cũng có những lo ngại về việc "xây dựng lâu đài trong vương quốc của người khác". Một số chuyên gia cảnh báo rằng dù mua từ Nvidia hay thuê từ Google, vấn đề bị khóa bởi nhà cung cấp (vendor lock-in) vẫn là một rào cản lớn mà các doanh nghiệp cần cân nhắc kỹ lưỡng khi xây dựng hạ tầng AI.

Bài viết liên quan

Công nghệ

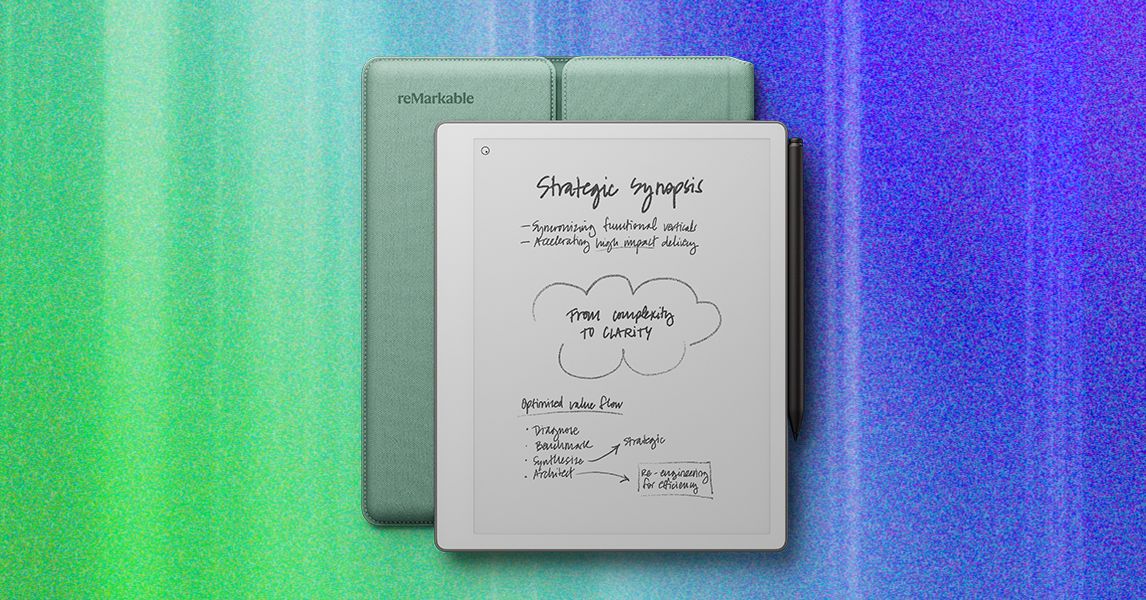

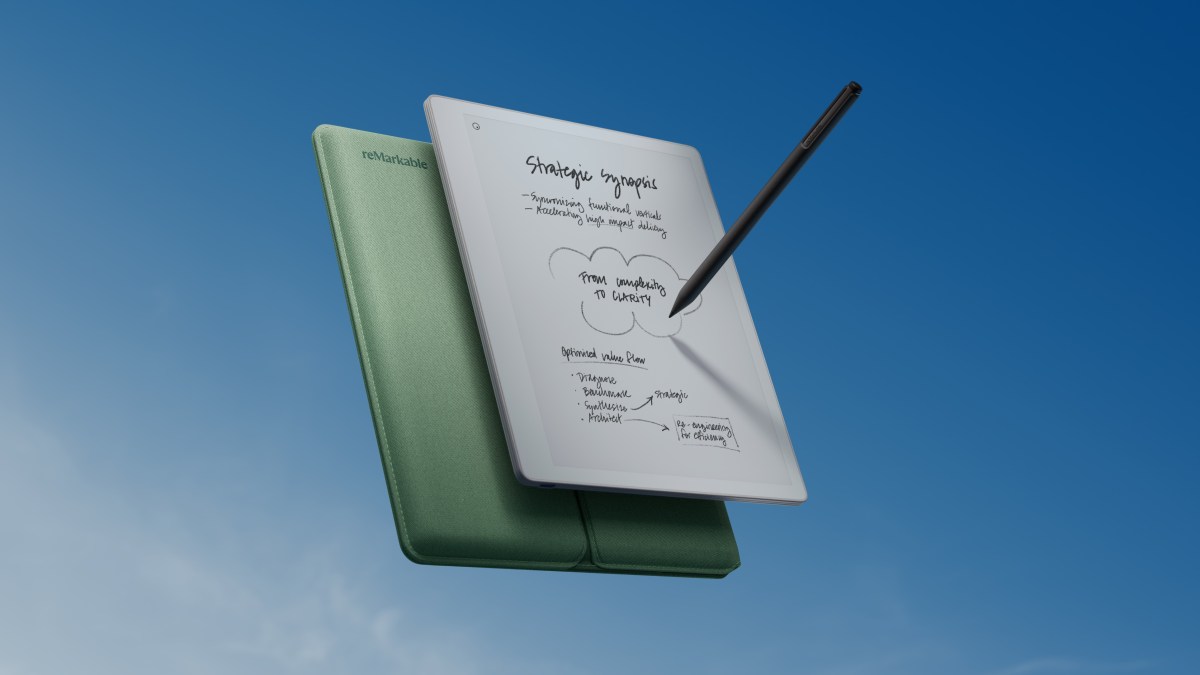

Đánh giá ReMarkable Paper Pure: Máy tính bảng ghi chú trở về bản chất

06 tháng 5, 2026

Công nghệ

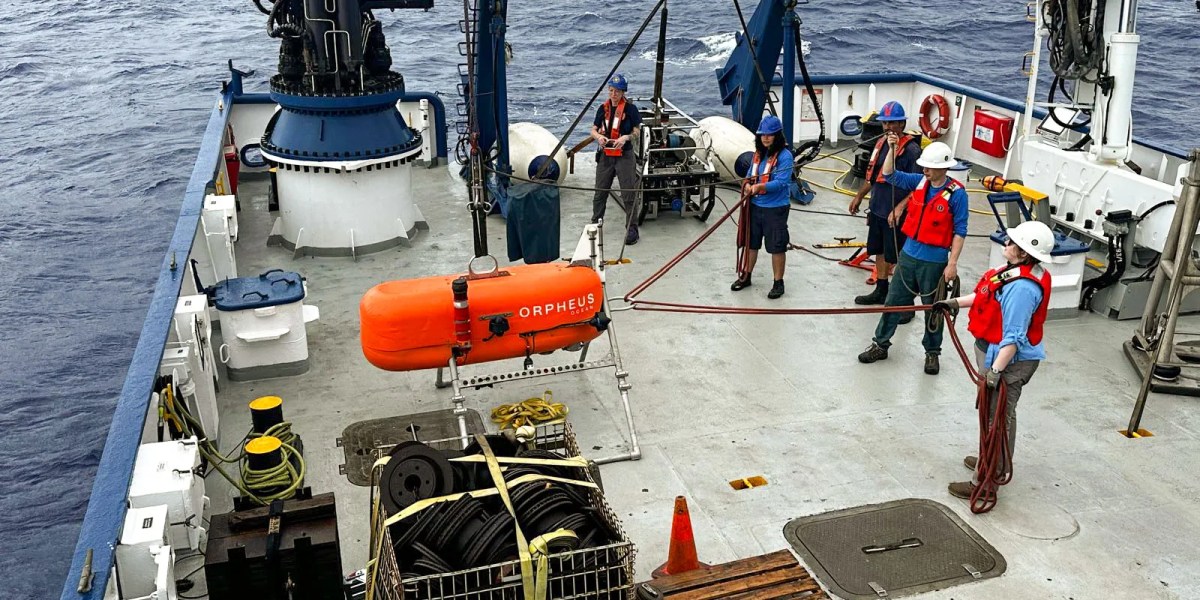

Tàu lặn biển sâu giá rẻ và Chatbot quân sự: Những điểm nhấn công nghệ tuần này

06 tháng 5, 2026

Công nghệ

reMarkable Paper Pure: Máy tính bảng E Ink mới quay về thiết kế màn hình đơn sắc

06 tháng 5, 2026