Mạng nơ-ron tự chữa lành trong PyTorch: Khắc phục "Model Drift" thời gian thực mà không cần huấn luyện lại

Bài viết giới thiệu kiến trúc mạng nơ-ron tự chữa lành (Self-Healing Neural Networks) giúp khắc phục sự trôi dạt dữ liệu trong môi trường sản xuất. Giải pháp sử dụng một lớp adapter nhẹ trong PyTorch để thích nghi thời gian thực, giúp khôi phục 27,8% độ chính xác mà không cần huấn luyện lại hay gây gián đoạn dịch vụ.

Hãy tưởng tượng bạn đang vận hành một mô hình phát hiện gian lận. Mọi thứ đang hoạt động trơn tru với độ chính xác 92,9%, nhưng đột nhiên các mẫu giao dịch bắt đầu thay đổi một cách thầm lặng. Khi bảng điều khiển (dashboard) chuyển sang màu đỏ cảnh báo, độ chính xác đã sụt giảm nghiêm trọng xuống còn 44,6%.

Vấn đề nan giải đặt ra là việc huấn luyện lại (retraining) mô hình mất sáu giờ đồng hồ — và bạn cần dữ liệu được gán nhãn (labeled data) mà phải đến tuần sau mới có. Vậy bạn phải làm gì trong khoảng thời gian "chết" sáu giờ đó?

Bài viết này sẽ đi sâu vào giải pháp Mạng nơ-ron tự chữa lành (Self-Healing Neural Networks) trong PyTorch — một cách tiếp cận phát hiện sự trôi dạt và thích ứng trong thời gian thực mà không cần tốn thời gian huấn luyện lại hay dừng hệ thống.

Khi các phương pháp chuẩn không còn hiệu quả

Thông thường, khi mô hình bắt đầu suy giảm, các kỹ sư thường có ba lựa chọn: huấn luyện lại trên dữ liệu mới, sử dụng kết hợp các mô hình (ensemble), hoặc quay lại phiên bản cũ (rollback).

Tuy nhiên, tất cả các phương pháp này đều dựa trên các giả định mà thực tế sản xuất thường không đáp ứng được: bạn có đủ dữ liệu nhãn không? Bạn có đủ thời gian để huấn luyện không? Và quan trọng nhất, việc quay lại một trạng thái cũ trên một phân phối dữ liệu đã thay đổi thực sự không giải quyết được vấn đề — nó chỉ lặp lại sai lầm cũ.

Giải pháp ở đây là một kiến trúc có khả năng vận hành trong "khoảng trống" đó: không cần dữ liệu nhãn mới, không có thời gian chết (downtime), và không rollback về một phân phối không còn tồn tại.

Kiến trúc Self-Healing Neural Network

Kiến trúc Self-Healing Neural Network

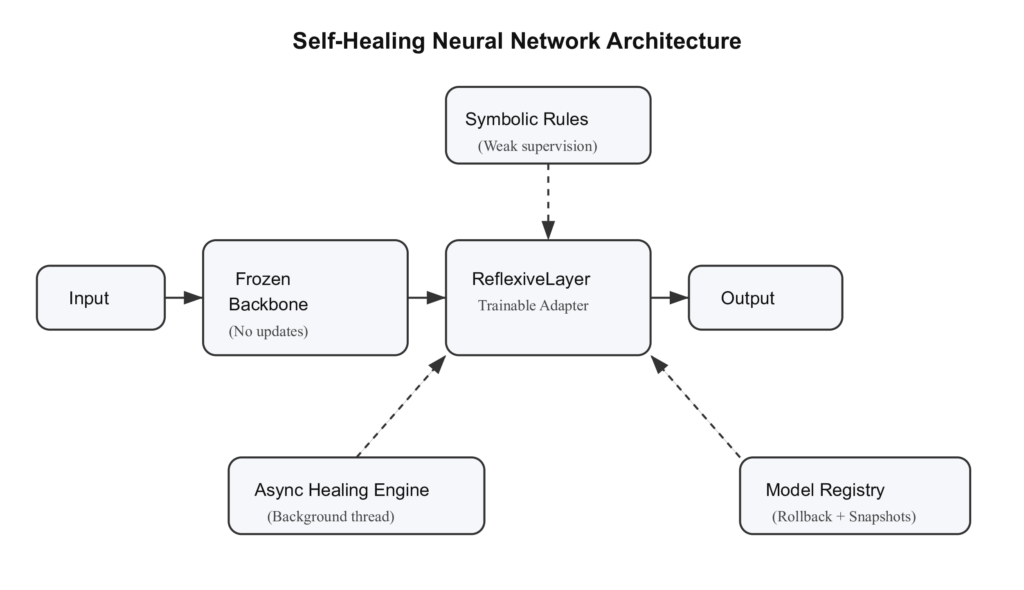

Kiến trúc: Một Backbone đóng băng và một Adapter có thể huấn luyện

Thiết kế cốt lõi ở đây là tách biệt khả năng thích nghi. Thay vì biến toàn bộ mạng neural có khả năng thích ứng, chúng ta cô lập sự thích nghi đó vào một thành phần duy nhất gọi là ReflexiveLayer. Lớp này được "kẹp" giữa backbone (đóng băng) và phần đầu ra (head, cũng đóng băng).

class ReflexiveLayer(nn.Module):

def __init__(self, dim):

super().__init__()

self.adapter = nn.Sequential(

nn.Linear(dim, dim), nn.Tanh(),

nn.Linear(dim, dim)

)

self.scale = nn.Parameter(torch.tensor(0.1))

def forward(self, x):

return x + self.scale * self.adapter(x)

Trong kiến trúc SelfHealingMLP, chỉ có ReflexiveLayer nhận được cập nhật gradient trong quá trình "chữa lành". Kết nối dư (residual connection) x + scale * adapter(x) đóng vai trò quan trọng: adapter chỉ có thể thêm các hiệu chỉnh vào tín hiệu gốc từ backbone chứ không thể ghi đè lên nó. Điều này đảm bảo rằng các kiến thức nền tảng đã học trước đó không bị phá hủy — một cách giải quyết vấn đề "quên thảm khốc" (catastrophic forgetting).

Hai tín hiệu kích hoạt quá trình chữa lành

Việc kích hoạt chữa lành quá sớm sẽ lãng phí tài nguyên tính toán, còn quá muộn sẽ để sự suy giảm tích tụ. Hệ thống sử dụng hai tín hiệu độc lập:

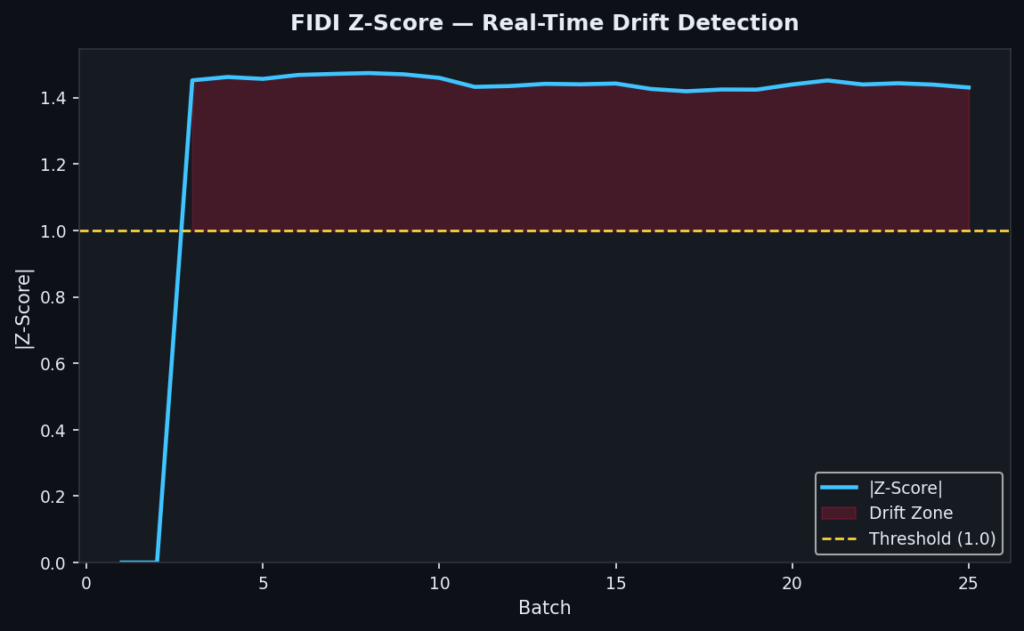

1. FIDI (Feature-based Input Distribution Inspection)

FIDI giám sát độ lệch chuẩn (z-score) của các đặc trưng đầu vào quan trọng so với thống kê huấn luyện. Khi z-score vượt qua ngưỡng cho phép, hệ thống xác định dữ liệu đầu vào đã bị trôi dạt.

2. Quy tắc biểu tượng (Symbolic Rules)

Hệ thống sử dụng một bộ quy tắc biểu tượng để cung cấp sự giám sát yếu (weak supervision). Điều này giúp adapter không bị overfit vào các mẫu nhiễu ngẫu nhiên mà vẫn bám sát kiến thức lĩnh vực.

FIDI theo dõi sự trôi dạt của dữ liệu

FIDI theo dõi sự trôi dạt của dữ liệu

Kết quả thực tế: Phục hồi độ chính xác và đánh đổi

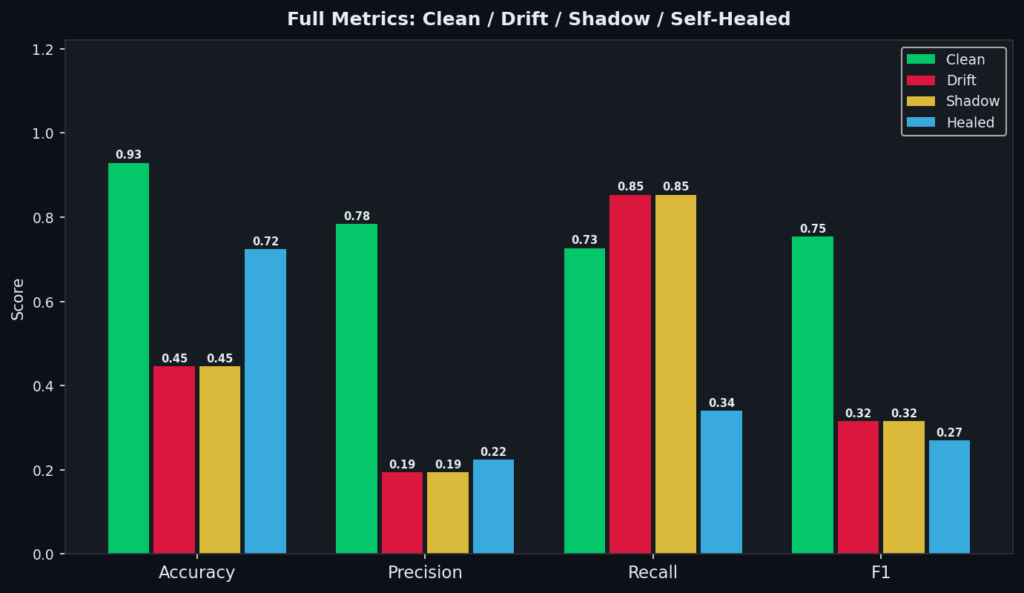

Trong thử nghiệm với dữ liệu gian lận thẻ tín dụng giả định, hệ thống đã cho thấy những kết quả đáng kể:

| Giai đoạn | Độ chính xác | Precision | Recall | F1 |

|---|---|---|---|---|

| Clean Baseline | 92.9% | 0.784 | 0.727 | 0.754 |

| Dưới Drift, Không Chữa Lành | 44.6% | 0.194 | 0.853 | 0.316 |

| Self-Healed (Sản Xuất) | 72.4% | 0.224 | 0.340 | 0.270 |

Mô hình đã tự chữa lành đạt 72,4% độ chính xác trên dữ liệu bị trôi dạt — một sự phục hồi ấn tượng 27,8 điểm phần trăm so với việc không làm gì.

Tuy nhiên, có một đánh đổi quan trọng về Recall (Độ phủ). Mô hình không chữa lành bắt được 128/150 trường hợp gian lận (Recall 0.853) nhưng lại tạo ra tới 532 báo động giả (False Positives). Trong khi đó, mô hình tự chữa lành chỉ bắt được 51/150 trường hợp (Recall 0.340) nhưng giảm đáng kể báo động giả xuống còn 177 trường hợp.

Mô hình tự chữa lành chọn sự thận trọng: thay vì gắn cờ "gian lận" bừa bãi, nó học rằng tín hiệu dữ liệu cũ không còn đáng tin cậy và từ đó đưa ra quyết định an toàn hơn.

Biểu đồ so sánh độ chính xác và F1 qua các batch

Biểu đồ so sánh độ chính xác và F1 qua các batch

Cơ chế Rollback và An toàn

Mỗi sự kiện "chữa lành" đều tạo ra hai snapshot: trước và sau khi cập nhật. Một bộ theo dõi sức khỏe (health monitor) sẽ liên tục so sánh điểm F1 trong một cửa sổ thời gian rolling với đường cơ sở. Nếu F1 giảm xuống dưới ngưỡng cho phép (ví dụ: giảm hơn 8%), hệ thống sẽ tự động khôi phục (rollback) về snapshot tốt nhất trước đó.

Cơ chế này đảm bảo rằng nếu quá trình thích nghi đi sai hướng, hệ thống sản xuất không bị sập hoàn toàn.

Kết luận

Mạng nơ-ron tự chữa lành không phải là giải pháp thay thế hoàn toàn cho việc huấn luyện lại, đặc biệt là khi các mô hình gian lận thay đổi căn bản. Tuy nhiên, nó là một công cụ cực kỳ hữu ích để "mua thời gian" trong các trường hợp trôi dạt phân phối dần dần (gradual distribution shift).

Bằng cách đóng băng backbone và chỉ cập nhật một adapter nhẹ được dẫn dắt bởi các quy tắc biểu tượng, chúng ta có thể duy trì độ chính xác của hệ thống mà không cần dừng dịch vụ hay đợi dữ liệu nhãn mới.

Tóm lại: Bạn không cần phải huấn luyện lại toàn bộ mô hình để sống sót qua sự trôi dạt dữ liệu — bạn chỉ cần một vị trí được kiểm soát để thích nghi.

Toàn bộ mã nguồn và hướng dẫn triển khai có thể được tìm thấy tại kho GitHub của dự án.

Bài viết liên quan

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026

Công nghệ

Spotify thắng kiện 322 triệu USD từ nhóm pirate Anna's Archive nhưng đối mặt với bài toán thu hồi

16 tháng 4, 2026