OpenAI giới thiệu chế độ thực thi WebSocket, giảm 40% độ trễ cho các ứng dụng AI tác nhân

OpenAI vừa tung ra chế độ thực thi mới dựa trên WebSocket cho Responses API, thay thế mô hình HTTP truyền thống để tối ưu hóa hiệu suất cho các tác nhân AI và hệ thống thời gian thực. Việc sử dụng kết nối liên tục giúp giảm độ trễ lên đến 40%, cải thiện tốc độ thực thi công cụ và khả năng điều phối đa bước trong các hệ thống quy mô lớn.

OpenAI đã chính thức giới thiệu chế độ thực thi dựa trên WebSocket cho API Responses của mình, nhằm nâng cao hiệu suất của các luồng công việc dựa trên tác nhân (agentic workflows) trong các hệ thống AI lập trình và ứng dụng thời gian thực. Sự thay đổi này thay thế mô hình yêu cầu-phản hồi (request-response) truyền thống của HTTP bằng một kết nối liên tục và hai chiều giữa client và server, nhằm giải quyết các vấn đề về độ trễ và chi phí điều phối trong các quy trình lập lý đa bước.

Theo OpenAI, các kết quả sử dụng thực tế cho thấy chế độ mới này giúp giảm độ trễ lên đến 40% và cải thiện thông lượng trong các tình huống yêu cầu độ tương tranh cao.

/filters:no_upscale()/news/2026/05/openai-websocket-responses-api/en/resources/1openaibeforewebsocket-1777845419017.jpeg) Dòng chảy HTTP truyền thống

Dòng chảy HTTP truyền thống

Cập nhật này giải quyết một điểm nghẽn đang ngày càng lớn trong các hệ thống tác nhân AI, nơi mà từng bước trong quy trình làm việc — chẳng hạn như các lệnh gọi công cụ (tool calls), lập lý trung gian và các truy vấn theo dõi — trước đây đều yêu cầu các yêu cầu HTTP riêng biệt. Khi tốc độ suy luận (inference) của các mô hình ngày càng cải thiện, tổng thời gian khứ hồi (round-trip times) qua mạng lặp đi lặp lại đã trở thành nguồn gốc chính gây ra độ trễ và sự phức tạp trong vận hành.

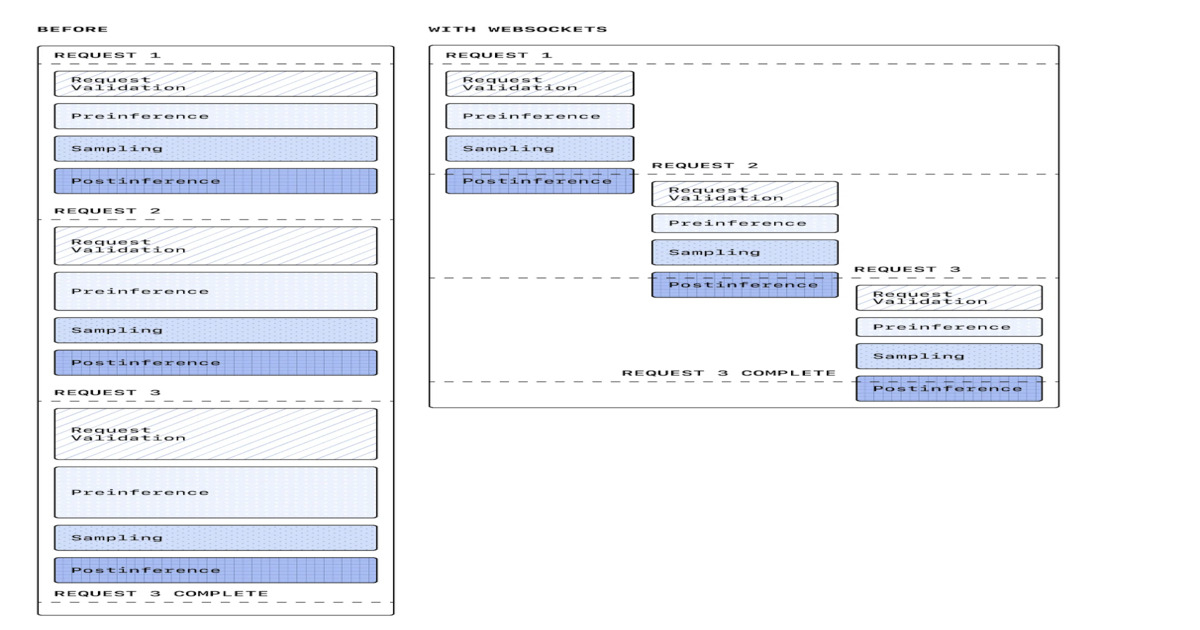

Chế độ thực thi dựa trên WebSocket sử dụng một kết nối hai chiều tồn tại trong thời gian dài (long-lived) để cho phép trao đổi dữ liệu liên tục mà không cần thực hiện bắt tay (handshake) liên tục. Điều này hỗ trợ luồng phản hồi (streaming responses), thực thi công cụ nhanh hơn và điều phối các quy trình đa bước hiệu quả hơn. Phương pháp này phù hợp với các mẫu thiết kế hướng sự kiện (event-driven design) trong các hệ thống phân tán, nơi việc duy trì trạng thái xuyên suốt các tương tác giúp cải thiện độ đáp ứng và thông lượng.

Ofek Shaked, một nhà phát triển phần mềm, đã nhận định về sự thay đổi này:

"Việc sử dụng WebSocket cho trạng thái tác nhân là một bước tiến rõ ràng nhưng mang lại hiệu quả to lớn. Không còn những khởi động nguội (cold starts) làm gián đoạn chuỗi công cụ đa dạng của bạn nữa."

/filters:no_upscale()/news/2026/05/openai-websocket-responses-api/en/resources/1openAIwebsokcet-1777845419017.jpeg) Sự tiến hóa của quy trình tác nhân với các phiên liên tục

Sự tiến hóa của quy trình tác nhân với các phiên liên tục

OpenAI báo cáo rằng việc sử dụng trong môi trường sản xuất giai đoạn đầu đã cho thấy mức giảm độ trễ lên tới 40%, cùng với thông lượng bền vững khoảng 1.000 giao dịch mỗi giây (TPS) và có thể đạt đỉnh lên tới 4.000 TPS. Những kết quả này cho thấy các tối ưu hóa ở cấp độ vận chuyển (transport-level) có thể tác động đáng kể đến hiệu suất tổng thể của hệ thống AI song song với các cải tiến ở cấp độ mô hình.

Gabriel Chua, Kỹ sư DX tại OpenAI, cho biết:

"Bạn có thể làm nóng kết nối bằng cách gửi lời nhắc hệ thống (system prompt) và định nghĩa công cụ trước. Tính này tương thích với chính sách Không Lưu Trữ Dữ liệu (Zero Data Retention - ZDR)."

Việc áp dụng công nghệ mới đã diễn ra nhanh chóng trong cộng đồng phát triển công cụ và các nền tảng tác nhân lập trình. Vercel đã tích hợp chế độ WebSocket vào AI SDK của mình và báo cáo mức giảm độ trễ lên tới 40%. Cline quan sát thấy cải thiện 39% trong các quy trình làm việc đa tệp, trong khi Cursor ghi nhận mức tăng hiệu suất lên tới 30%. Những kết quả này làm nổi bật cách các tối ưu hóa ở cấp độ hệ thống, bên ngoài mô hình AI, đang ngày càng định hình hiệu suất thực tế của các ứng dụng AI.

Về mặt triển khai kỹ thuật, các nhà phát triển tích hợp chế độ WebSocket bằng cách thay thế nhiều lệnh gọi HTTP bằng một phiên làm việc liên tục duy nhất. Điều này giúp giảm bớt việc thiết lập kết nối lặp đi lặp lại và đơn giản hóa logic điều phối xuyên suốt các quy trình đa bước. Nó cũng cải thiện khả năng hỗ trợ cho các trường hợp sử dụng streaming, chẳng hạn như tạo mã gia tăng và lập lý tương tác, nơi các đầu ra từng phần có thể được tiêu th dụng ngay khi được tạo ra.

Kevin Cho, kỹ sư tại Microsoft, nhận xét rằng cách tiếp cận này phản ánh việc:

"Quay trở lại các vấn đề của ngăn xếp phần mềm ban đầu. Websocket và các kết nối có trạng thái (stateful)."

Sự thay đổi này mang lại những cân nhắc thiết kế hệ thống mới, bao gồm quản lý vòng đời kết nối, chống áp suất ngược (backpressure) trong môi trường tương tranh cao và độ tin cậy trong các hệ thống phân tán, phù hợp với các mẫu hệ thống có trạng thái đã được thiết lập.

Tính năng này đã được OpenAI phát hành dưới dạng Alpha sau chu kỳ hai tháng thử nghiệm với các đối tác được chọn, bao gồm Codex. Kể từ đó, Codex đã chuyển đổi phần lớn lưu lượng truy cập của Responses API sang chế độ WebSocket, cho thấy tính sẵn sàng để đưa vào sản xuất thương mại.