Quản trị chặt chẽ các bot AI để tránh sự hỗn loạn trong doanh nghiệp

Theo Gartner, số lượng tác nhân AI trung bình tại các tập đoàn Fortune 500 dự kiến sẽ tăng vọt lên hơn 150.000 vào năm 2028. Nếu thiếu cơ chế quản trị hiệu quả, sự bùng nổ này có thể dẫn đến tình trạng hỗn loạn và các rủi ro bảo mật nghiêm trọng.

Ngăn chặn sự lan tràn của tác nhân AI

Với mức trung bình, mỗi tập đoàn lớn trong danh sách Fortune 500 toàn cầu dự kiến sẽ vận hành hơn 150.000 tác nhân AI vào năm 2028, tăng mạnh so với con số ít hơn 15 hiện nay. Điều này tạo ra vô số cơ hội cho sự hỗn loạn xảy ra. Công ty nghiên cứu Gartner cảnh báo rằng, nếu không có sự quản trị thích hợp, các tác nhân này sẽ nhân lên và hoạt động một cách mất kiểm soát.

Quản trị là chìa khóa để khai thác giá trị từ các triển khai AI, theo các nhà nghiên cứu của Gartner, những người đã đi sâu vào vấn đề này tại Hội nghị Thượng đỉnh Nơi làm việc Kỹ thuật số (Digital Workplace Summit) của công ty tại London vào tuần này.

"Khi các CIO và lãnh đạo công nghệ thông tin chứng kiến sự bùng nổ của các tác nhân AI trên khắp tổ chức của mình, nhiều người đang phải đối mặt với sự lan tràn không được quản trị của các tác nhân này," Max Goss, giám đốc phân tích cấp cao tại Gartner, cho biết tại hội nghị.

Một nửa số tổ chức được Gartner khảo sát cho biết họ hạn chế việc triển khai AI nội bộ cho những người dùng có rủi ro thấp hoặc đáng tin cậy. Tuy nhiên, chính những tổ chức này lại ít có khả năng báo cáo lợi nhuận cao từ các công cụ AI tạo sinh của họ so với các công ty mở rộng quyền truy cập rộng rãi hơn dưới sự quản trị chặt chẽ. Các đơn vị áp dụng rộng rãi có khả năng báo cáo giá trị cao hơn gấp 3,3 lần.

Gartner khẳng định rằng việc hạn chế quyền truy cập không phải là quản trị.

Dữ liệu cho thấy các tổ chức đầu tư vào các công cụ quản trị của bên thứ ba gần như có khả năng gấp đôi trong việc báo cáo giá trị cao hơn từ các triển khai AI của mình.

Mô hình quản trị của Gartner kêu gọi một cấu trúc hai cấp: một ủy ban quản trị AI tập trung ở cấp cao — bao gồm CIO, CISO, giám đốc AI, kiến trúc sư doanh nghiệp, pháp lý và các lãnh đạo kinh doanh — sẽ thiết lập chiến lược và chính sách. Dưới đó, các nhóm quản trị vận hành được nhúng trong từng lĩnh vực ứng dụng sẽ chuyển hóa các chính sách đó thành các biện pháp kiểm soát cụ thể cho nền tảng của họ.

Sự lan truyền nhanh chóng của các tác nhân AI trên phần mềm doanh nghiệp, từ các nền tảng CRM và ERP đến các công cụ nơi làm việc kỹ thuật số như Microsoft 365 Copilot, đang tạo ra những gì các nhà phân tích gọi là "sự lan tràn của tác nhân" (agent sprawl). Đây là một mớ hỗn độn các công cụ AI tự chủ khiến tổ chức phải đối mặt với thông tin sai lệch, mất mát dữ liệu và sự phức tạp trong CNTT ngày càng gia tăng.

Chỉ có 15% người được hỏi cho biết họ đang xem xét, thí điểm hoặc triển khai các tác nhân AI hoàn toàn tự chủ, theo khảo sát năm 2025 của Gartner với 360 lãnh đạo ứng dụng CNTT. Và chỉ có 13% tổ chức tin rằng họ đã có cơ chế quản trị phù hợp về tổng thể.

Các thông báo gần đây từ Google và ServiceNow đều tự hào cả về việc tạo ra và kiểm soát các tác nhân. Okta và Commvault đều đã giới thiệu các cách để theo dõi tác nhân và, trong trường hợp của Commvault, có khả năng hoàn tác các hành động của chúng.

Gartner đã đưa ra một khuôn khổ để kiểm soát sự gia tăng của các tác nhân AI.

Các tổ chức cần thiết lập các chính sách quản trị rõ ràng xác định khi nào và cách thức các tác nhân được xây dựng, ai có thể tạo và chia sẻ chúng, cũng như dữ liệu nào chúng có thể truy cập. Họ nên xây dựng một danh mục tập trung hóa cho mọi tác nhân trong doanh nghiệp. Công ty phân tích khuyến nghị sử dụng các công cụ quản lý niềm tin, rủi ro và bảo mật AI, một danh mục mà Gartner gọi là AI TRiSM, để phát hiện và phân loại các tác nhân trên cả các nền tảng được chấp thuận và các triển khai AI bóng tối (shadow AI).

Khi một tổ chức đã biết mình đang sở hữu những gì, họ có thể bắt đầu áp dụng các biện pháp kiểm soát thích ứng dựa trên mức độ rủi ro của từng tác nhân.

Gartner cho rằng mọi tác nhân đều cần một danh tính được xác định, một bộ quyền hạn rõ ràng và một kế hoạch vòng đời. Điều đó có nghĩa là thực thi quyền truy cập tối thiểu và loại bỏ các tác nhân dư thừa trước khi chúng tích tụ lại.

Các công ty cần tìm cách liên tục giám sát hành vi của tác nhân, theo dõi các mô hình sử dụng, gắn cờ các bất thường và chỉnh sửa các tác nhân đi chệch khỏi phạm vi của chúng.

Các nhà phân tích của Gartner cho biết giáo dục về AI có trách nhiệm sẽ trở nên quan trọng như đào tạo an ninh mạng và có thể sẽ được lồng ghép vào các chương trình bảo mật bắt buộc.

Bài viết liên quan

Công nghệ

AI khám phá DNA thực chất không bị "khóa chặt" trong tế bào như quan niệm cũ

30 tháng 4, 2026

Công nghệ

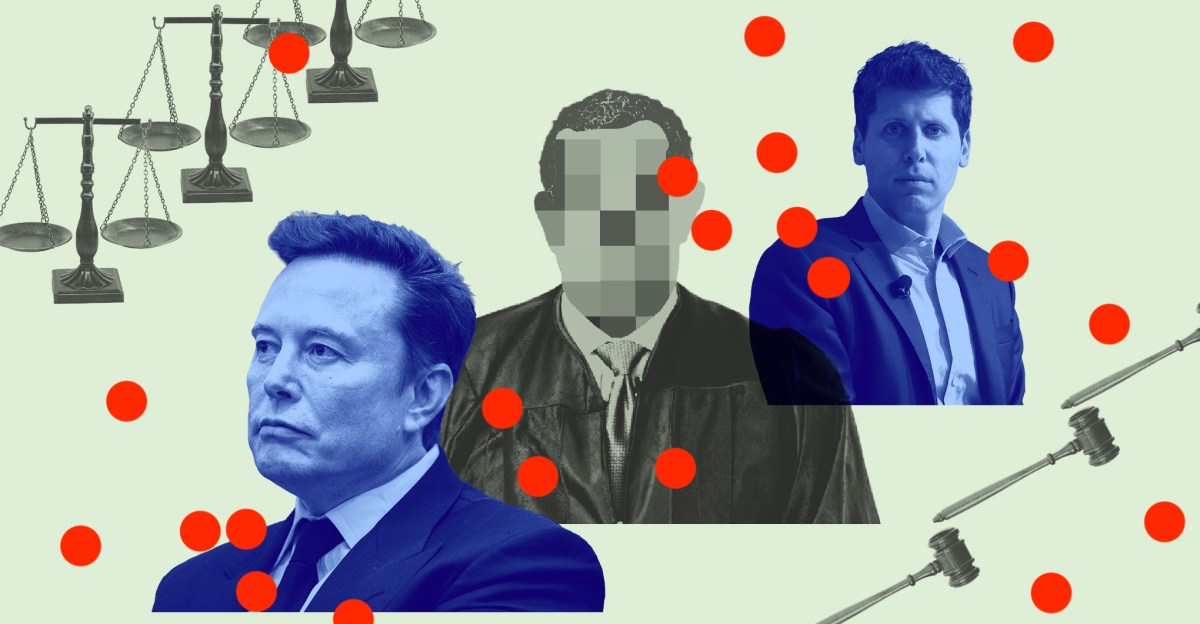

Vụ kiện Musk kiện OpenAI: Đội ngũ luật sư của Elon vừa mắc sai lầm nghiêm trọng khi bồi thẩm đoàn vắng mặt?

30 tháng 4, 2026

Phần cứng

Meta chấm dứt hợp đồng với nhân viên báo cáo nhìn thấy hình ảnh nhạy cảm từ kính Ray-Ban Meta

30 tháng 4, 2026