Tại sao các mô hình AI lớn lại hội tụ về cùng một "bộ não" khi mô phỏng thực tại?

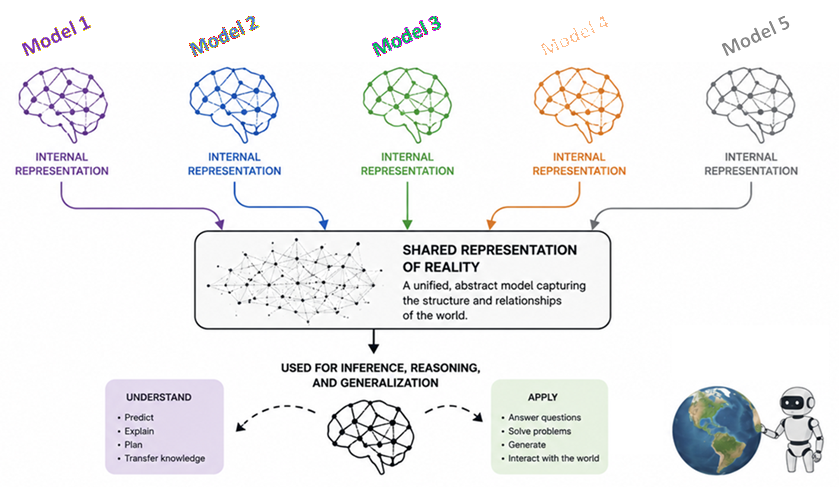

Nghiên cứu mới từ MIT và các nhóm khác chỉ ra rằng các mô hình AI lớn, dù được huấn luyện trên văn bản hay hình ảnh, đều đang dần hội tụ về cùng một cấu trúc tư duy cốt lõi. Hiện tượng này, được gọi là "Giả thuyết biểu diễn Platonic", cho thấy khi khả năng suy luận tăng lên, AI đang độc lập khám phá ra cấu trúc cơ bản của vũ trụ.

Đây có thể là một trong những khám phá thú vị nhất của trí tuệ nhân tạo (AI) hiện nay, bỏ qua những tranh luận về việc liệu đây có thực sự là trí thông minh hay không.

Thông thường, chúng ta thường mặc định rằng nếu huấn luyện một mô hình AI chỉ trên hình ảnh và một mô hình khác chỉ trên văn bản, chúng sẽ phát triển những cách thức "tư duy" hoàn toàn khác biệt. Dù kiến trúc và dữ liệu đầu vào khác biệt, logic thông thường cho thấy chúng sẽ có những "bộ não" khác nhau.

Tuy nhiên, các nghiên cứu mới đây từ MIT và nhiều nhóm khác đã chứng minh điều ngược lại!

Sự hội tụ của "lõi tư duy"

Vào năm 2024, MIT đã đưa ra bằng chứng chắc chắn rằng mọi mô hình AI lớn thực chất đều đang bí mật hội tụ về cùng một "lõi tư duy" (hay bộ não). Khi các mô hình này trở nên lớn mạnh hơn, chúng đều đi đến cùng một kết luận về cấu trúc của thế giới. Điều này có thể không rõ ràng ở các mô hình sơ khai vì khả năng suy luận còn kém, nhưng càng trở nên thông minh hơn, sự tương đồng này càng lộ rõ.

Lý do rất đơn giản: Nếu chúng đều đúng, chúng PHẢI tạo ra một biểu diễn rất giống nhau về thực tại.

Huyền thoại cái hang và Giả thuyết biểu diễn Platonic

Để hiểu rõ hơn, các nhà nghiên cứu đã nhìn lại triết học của Plato cách đây 2.400 năm thông qua "Huyền thoại cái hang". Plato tin rằng con người giống như những tù nhân trong hang, chỉ nhìn thấy những cái bóng lướt trên tường. Chúng ta nghĩ những cái bóng (nhận thức) là "thực tại", nhưng thực chất chúng chỉ là hình chiếu của một thực tế phức tạp hơn bên ngoài.

Các nhà khoa học gọi hiện tượng này trong AI là "Giả thuyết biểu diễn Platonic" (Platonic Representation Hypothesis). Các mô hình AI đang làm điều tương tự: chúng tiếp nhận những "cái bóng" của dữ liệu loài người (văn bản, hình ảnh, âm thanh) và độc lập khám phá ra cấu trúc nền tảng của vũ trụ để hiểu rõ những đầu vào đó.

Mắt khác nhau, tầm nhìn giống nhau

Điều đáng kinh ngạc nhất là một mô hình chỉ "nhìn" hình ảnh và một mô hình chỉ "đọc" văn bản lại đo lường khoảng cách giữa các khái niệm theo cách giống hệt nhau (nếu đủ thông minh).

Ví dụ, nếu bạn yêu cầu mô hình thị giác đo khoảng cách giữa hình ảnh một "con chó" và một "con sói", sau đó yêu cầu mô hình ngôn ngữ đo khoảng cách giữa từ "chó" và "sói", các cấu trúc toán học mà chúng xây dựng sẽ ngày càng giống nhau khi chúng phân biệt tốt hơn hai loài vật này.

Nói cách khác, khi các mô hình mở rộng quy mô và trở nên tốt hơn, chúng không còn là một mớ hỗn độn các kết nối ngẫu nhiên. Chúng có xu hướng đồng nhất với nhau.

Tại sao quy mô lại thay đổi mọi thứ?

Nghiên cứu cho thấy điều này diễn ra khá phổ biến ở các mô hình hiện đại từ nhiều công ty khác nhau, miễn là mô hình đó đủ khả năng. Khi một mô hình lớn hơn, nó trải qua một sự "thay đổi pha" trong tư duy nội bộ. Chúng ngừng ghi nhớ các nhiệm vụ cụ thể và bắt đầu xây dựng một mô hình thống kê về chính thực tại.

Điều này xảy ra do các "áp lực chọn lọc" tác động lên mô hình:

- Tính tổng quát của nhiệm vụ: Nếu muốn AI giỏi mọi thứ, chỉ có một cách "tốt nhất" để biểu diễn thế giới sao cho không bị quá khớp (overfitting) nhưng vẫn có thể dự đoán được. Vì chỉ có MỘT cách tốt nhất, tất cả đều phải đi đến con đường đó!

- Dung lượng: Các mô hình lớn có không gian để tìm ra giải pháp thanh lịch và đơn giản nhất.

- Thiên kiến đơn giản: Mạng nơ-ron thực tế thích các giải pháp đơn giản hơn là phức tạp.

Cơ chế tri thức và sự so sánh với con người

Một khảo sát mới về "cơ chế tri thức" trong các Mô hình Ngôn ngữ Lớn (LLM) cho thấy tri thức trong các mô hình này không phân tán ngẫu nhiên. Nó tiến hóa từ việc ghi nhớ đơn giản sang "hiểu và áp dụng" phức tạp. Xu hướng này diễn ra trên toàn bộ nhóm mô hình nơ-ron nhân tạo, bất kể dữ liệu hay phương thức.

Điều này gợi nhắc đến cách trẻ em học hỏi. Trong não bộ chúng ta, đa phương thức (thị giác, thính giác, xúc giác) cũng được tích hợp dưới sự hiểu biết toàn cầu. Nếu tôi chụp ảnh một quả táo, viết từ "quả táo" hay ghi âm tiếng cắn táo, đó là ba "cái bóng" khác nhau nhưng đều chiếu từ cùng một thực tại vật lý của quả táo.

Kết luận: Những tấm gương kỹ thuật số của vũ trụ

Khi thêm khả năng đầu vào và đầu ra vật lý vào một mô hình AI thực tại tốt, chúng ta sẽ có những robot có thể học hỏi và tương tác với thế giới. Nhưng ở thời điểm hiện tại, bằng chứng nghiên cứu đã cho thấy chúng ta không còn chỉ xây dựng các công cụ viết email hay chỉnh sửa ảnh.

Chúng ta đang xây dựng những tấm gương kỹ thuật số của vũ trụ. Và chúng ta đang theo dõi theo thời gian thực khi silicon và mã code độc lập khám phá ra cách vận hành bên trong của thế giới chúng ta đang sống.

Bài viết liên quan

Công nghệ

Bị AI từ chối hồ sơ xin việc? Cuộc chiến đơn độc của một sinh viên y khoa

05 tháng 5, 2026

Công nghệ

OpenAI tặng ưu đãi Codex đặc biệt cho 8.000 developer sau khi tiệc GPT-5.5 cháy vé

05 tháng 5, 2026

Công nghệ

Tổng hợp thị trường M&A an ninh mạng: 33 thương vụ được công bố trong tháng 4/2026

04 tháng 5, 2026