Tìm hiểu DenseNet: Mạng nơ-ron kết nối dày đặc và tối ưu hóa tham số

Khi xây dựng các mạng nơ-ron sâu, vấn đề "độ dốc biến mất" (vanishing gradient) thường gây khó khăn trong việc huấn luyện. DenseNet ra đời như một giải pháp thông minh, tận dụng các đường nối ngắn (shortcut connections) một cách mạnh mẽ hơn ResNet để lưu trữ và tái sử dụng đặc trưng (feature reuse), giúp tối ưu hóa hiệu quả tính toán và giảm thiểu số lượng tham số.

Tìm hiểu DenseNet: Mạng nơ-ron kết nối dày đặc và tối ưu hóa tham số

Khi phát triển các mô hình học sâu, đặc biệt là các mạng nơ-ron tích chập (CNN) có độ sâu lớn, nhà nghiên cứu thường đối mặt với thách thức nổi tiếng là vấn đề độ dốc biến mất (vanishing gradient). Vấn đề này khiến quá trình cập nhật trọng số (weight update) bị chậm lại hoặc dừng lại, khiến mô hình không thể học tốt.

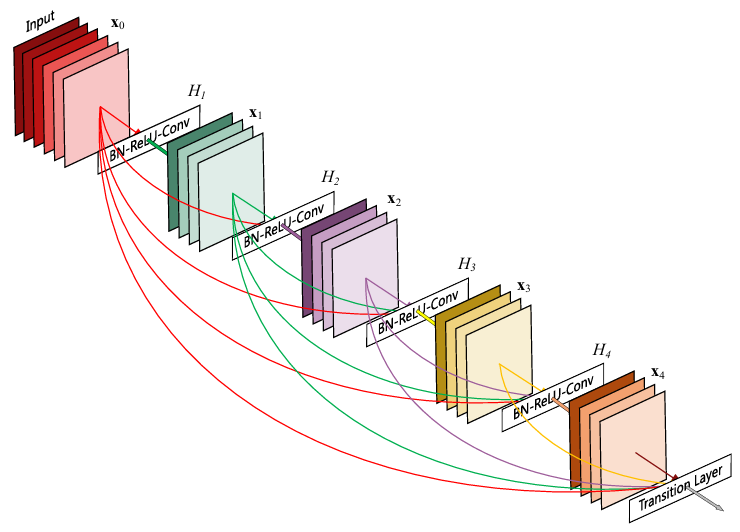

Để giải quyết vấn đề này, kiến trúc DenseNet ra đời với ý tưởng đột phá: kết nối dày đặc (Dense Connectivity). Thay vì chỉ nối các tầng như mạng truyền thống hay chỉ nhảy một bước như ResNet, DenseNet kết nối từng tầng với tất cả các tầng tiếp theo. Cách tiếp cận này không chỉ giải quyết vấn đề gradient mà còn giúp mạng lưới hoạt động cực kỳ hiệu quả về mặt số lượng tham số.

Cấu trúc của một khối Dense

Cấu trúc của một khối Dense

Ý tưởng cốt lõi: Tái sử dụng đặc trưng

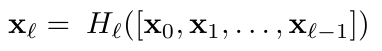

Khác với ResNet thực hiện phép cộng theo chiều ngang (element-wise summation), DenseNet kết nối thông tin bằng cách nối kênh (channel-wise concatenation). Điều này có nghĩa là đầu ra của một lớp sẽ được nối trực tiếp với đầu vào của lớp tiếp theo.

Cách nối kênh trong DenseNet

Cách nối kênh trong DenseNet

Hãy hình dung một mạng có 5 tầng. Trong mạng CNN truyền thống, bạn chỉ có 5 đường nối thẳng. Tuy nhiên, với DenseNet, số lượng đường nối tăng lên lên tới L(L+1)/2. Mỗi tầng đều có thể tiếp cận trực tiếp đặc trưng từ tất cả các tầng trước đó. Điều này thúc đẩy tái sử dụng đặc trưng (feature reuse), giúp mô hình học hiệu quả hơn mà không cần tính toán lại từ đầu.

Tại sao DenseNet lại hiệu quả?

Một trong những điểm thú vị nhất của DenseNet là khả năng tiết kiệm tham số. Dưới đây là một ví dụ minh họa về cách tính toán số lượng tham số giữa mạng CNN truyền thống và DenseNet trong cùng một cấu trúc.

Giả sử sử dụng các lớp tích chập 3x3 với tốc độ tăng trưởng (growth rate) k = 4:

- Mạng CNN truyền thống: Tổng số tham số khoảng 7,632.

- DenseNet: Tổng số tham số chỉ khoảng 1,728.

Điều này chứng tỏ rằng DenseNet gấp hơn 4 lần ít tham số hơn trong khi vẫn duy trì cấu trúc phức tạp. Nguyên nhân là do mỗi lớp chỉ tính toán k đặc trưng mới và nối chúng vào tập dữ liệu đã có sẵn, thay vì tính toán lại toàn bộ đặc trưng từ đầu.

Cấu trúc kiến trúc: Khối Dense và Lớp chuyển tiếp

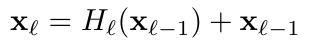

Mô hình DenseNet hoàn chỉnh thường bao gồm hai thành phần chính:

1. Khối Dense (Dense Block)

Đây là thành phần cốt lõi nơi các lớp tích chập được nối chặt chẽ với nhau. Mỗi lớp trong khối này sẽ nhận đầu vào là kết hợp của tất cả đặc trưng từ các lớp trước đó trong cùng khối.

2. Lớp chuyển tiếp (Transition Layer)

Vì việc nối kênh liên tục khiến số lượng kênh (channel) tăng lên rất nhanh, các lớp chuyển tiếp được sử dụng để giảm thiểu chiều sâu không gian và số lượng kênh. Một lớp chuyển tiếp thường bao gồm một lớp tích chập 1x1 để nén kênh và một lớp pooling (thường là AvgPool) để giảm kích thước không gian.

Cấu trúc tổng quan kiến trúc DenseNet

Cấu trúc tổng quan kiến trúc DenseNet

Triển khai với PyTorch

Việc triển khai DenseNet từ đầu cho phép chúng ta hiểu rõ hơn về cách hoạt động của từng thành phần. Dưới đây là tóm tắt các bước cốt lõi trong code (dựa trên PyTorch):

- Khối Bottleneck: Để giảm chi phí tính toán, mỗi lớp trong Dense Block thường sử dụng cấu trúc Bottleneck (1x1, 3x3, 1x1) để giảm số lượng kênh trước khi tính toán 3x3 và sau đó mở rộng lại.

- Khối Dense (DenseBlock): Lớp này lặp lại việc thêm các khối Bottleneck, liên tục nối đầu ra vào đầu vào.

- Lớp chuyển tiếp (Transition): Giảm chiều sâu và số kênh giữa các Dense Block.

# Ví dụ cấu trúc cơ bản trong code

class DenseBlock(nn.Module):

def __init__(self, in_channels, growth_rate, num_layers):

super().__init__()

self.layers = nn.ModuleList()

for _ in range(num_layers):

self.layers.append(Bottleneck(in_channels, growth_rate))

in_channels += growth_rate

def forward(self, x):

for layer in self.layers:

x = layer(x) # Nối kênh tại đây

return x

Kết luận

DenseNet là một ví dụ điển hình về sự sáng tạo trong kiến trúc học sâu. Bằng cách kết nối dày đặc giữa các lớp, nó không chỉ giải quyết vấn đề gradient biến mất hiệu quả mà còn giúp giảm thiểu đáng kể bộ nhớ và tốc độ tính toán. Với các kiến trúc như DenseNet-121 hay DenseNet-201, người ta có thể đạt được độ chính xác cao hơn ResNet mà lại sử dụng ít tham số hơn, tạo ra một mô hình cân bằng giữa hiệu suất và hiệu quả.

Bài viết liên quan

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026

Công nghệ

Spotify thắng kiện 322 triệu USD từ nhóm pirate Anna's Archive nhưng đối mặt với bài toán thu hồi

16 tháng 4, 2026