Vercel cảnh báo rò rỉ thông tin đăng nhập khách hàng do lỗi từ công cụ AI bên thứ ba

Vercel, công ty đứng sau framework Next.js, vừa xác nhận một sự cố bảo mật dẫn đến việc lộ thông tin đăng nhập của một nhóm nhỏ khách hàng. Vụ việc bắt nguồn từ lỗ hổng tại Context.ai, nơi một nhân viên Vercel đã vô tình cấp quyền truy cập quá mức cho tài khoản công ty.

Vercel, công ty mẹ của khung phát triển web mã nguồn mở Next.js, đã công bố một bản tin bảo mật cho biết vào ngày 19 tháng 4, họ đã phát hiện ra một sự cố bảo mật liên quan đến việc truy cập trái phép vào một số hệ thống nội bộ. Điều này dẫn đến việc bị xâm phạm thông tin đăng nhập của "một tập hợp con hạn chế" khách hàng. Công ty đã liên hệ với những khách hàng bị ảnh hưởng và khuyến nghị họ "thay đổi thông tin đăng nhập ngay lập tức".

"Chúng tôi tiếp tục điều tra xem liệu có dữ liệu nào bị đánh cắp hay không và sẽ liên hệ với khách hàng nếu phát hiện thêm bằng chứng về việc xâm phạm", bản tin cho biết thêm. Vercel cũng khẳng định họ đã "triển khai các biện pháp bảo vệ và giám sát rộng rãi. Các dịch vụ của chúng tôi vẫn hoạt động bình thường".

Nguyên nhân từ Context.ai

Vercel đã chỉ định nguyên nhân của sự cố này bắt nguồn từ việc bị xâm phạm tài khoản tại Context.ai, một công cụ AI bên thứ ba được một nhân viên của Vercel sử dụng. Kẻ tấn công đã sử dụng quyền truy cập này để chiếm đoạt tài khoản Google Workspace của nhân viên Vercel, từ đó cho phép chúng truy cập vào một số môi trường Vercel và các biến môi trường không được đánh dấu là "nhạy cảm".

Context.ai cũng đã đăng tải một bản tin bảo mật riêng, tiết lộ về một sự cố vào tháng 3 khi họ phát hiện và ngăn chặn việc truy cập trái phép vào môi trường AWS của mình. Context.ai đã thuê CrowdStrike để điều tra và đóng hạ tầng AWS. Tuy nhiên, công ty thừa nhận: "Hôm nay, dựa trên thông tin do Vercel cung cấp và một số điều tra nội bộ bổ sung, chúng tôi biết rằng trong sự cố tháng trước, tác nhân trái phép cũng có thể đã xâm phạm mã thông báo OAuth (OAuth tokens) cho một số người dùng tiêu dùng của chúng tôi".

Rủi ro từ AI tác nhân

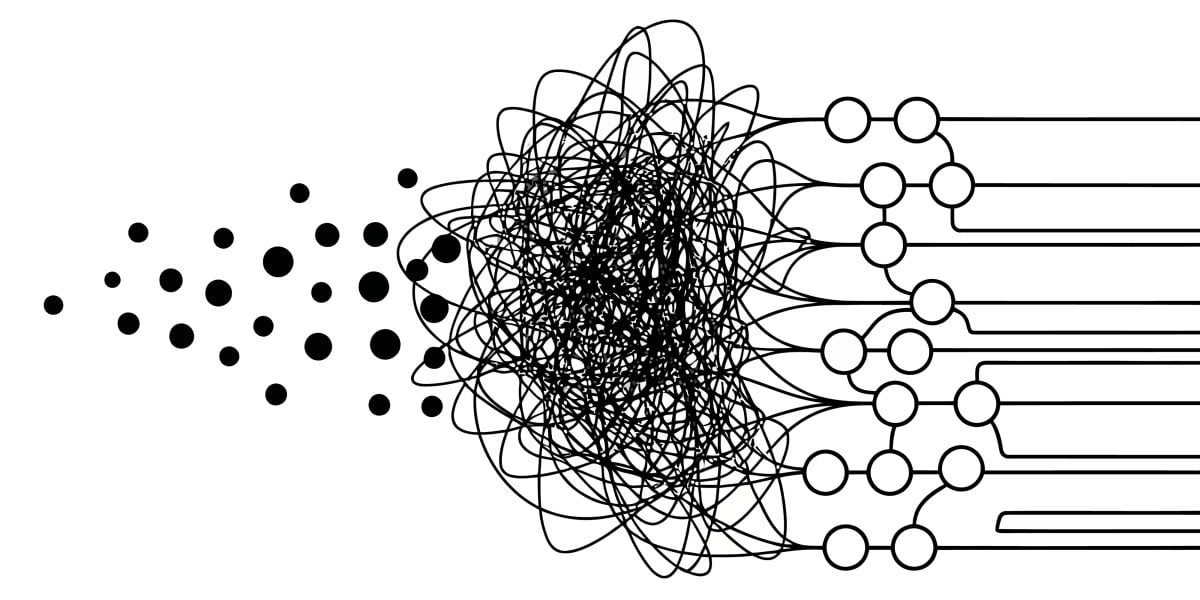

Khách hàng tiêu dùng của công ty này sử dụng một sản phẩm gọi là AI Office suite, được Context.ai mô tả là "không gian làm việc được thiết kế để giúp người dùng làm việc với các tác nhân AI để xây dựng bản trình bày, tài liệu và bảng tính". Bộ công cụ này cung cấp tính năng cho phép người dùng bật các tác nhân AI thực hiện hành động trên các ứng dụng bên ngoài của họ, được thực hiện thông qua một dịch vụ bên thứ ba khác.

Quay lại bản tin của Context.ai, công ty cho rằng kẻ tấn công hệ thống của họ "dường như đã sử dụng mã thông báo OAuth bị xâm phạm để truy cập vào Google Workspace của Vercel. Vercel không phải là khách hàng của Context, nhưng có vẻ như ít nhất một nhân viên của Vercel đã đăng ký AI Office Suite bằng tài khoản doanh nghiệp Vercel của họ và cấp quyền 'Cho phép tất cả' (Allow All)".

Context.ai cho rằng cấu hình OAuth nội bộ của Vercel "dường như đã cho phép hành động này cấp các quyền hạn rộng rãi trong Google Workspace doanh nghiệp của Vercel".

Bài học về sai lầm bảo mật

Tất cả các bên liên quan trong vụ việc này đều đã mắc sai lầm. Context.ai rõ ràng không có an ninh mạng tốt. Cuộc điều tra của CrowdStrike dường như đã bỏ sót một số chi tiết. Vercel cũng không khóa chặt tài khoản Google Workspace của mình.

Và giờ đây, thế giới có một ví dụ điển hình về sản phẩm AI tác nhân (agentic AI) liên kết với các dịch vụ bên thứ ba gây ra rắc rối — đúng là loại rủi ro mà các chuyên gia an ninh mạng đã cảnh báo.