Astera Labs thách thức Nvidia với switch Scorpio X: Kết nối AI tốc độ cao mà không cần NVLink

Astera Labs đã công bố switch Scorpio X sử dụng PCIe 6.0 với băng thông 5,12 TB/s, cung cấp giải pháp thay thế linh hoạt cho NVSwitch của Nvidia trong việc xây dựng hệ thống AI quy mô rack. Thiết bị mới này hỗ trợ khả năng tính toán trong mạng và tối ưu hóa cho các mô hình Mixture-of-Experts (MoE), giúp tăng tốc độ suy luận AI mà không phụ thuộc vào phần cứng chuyên dụng.

Astera Labs vừa công bố một giải pháp thay thế cho công nghệ NVSwitch của Nvidia, nhằm hỗ trợ việc xây dựng các hệ thống AI quy mô rack mà không bị ràng buộc bởi các công nghệ độc quyền. Được đặt tên mã là Scorpio X, switch kết nối AI này tích hợp 320 làn kết nối PCIe 6.0 vào một con chip ASIC duy nhất, cung cấp băng thông song công lên tới 5,12 TB/s.

Về mặt lịch sử, các switch PCIe đã được sử dụng trong nhiều ứng dụng khác nhau, bao gồm cả các cơ chế tính toán mở rộng quy mô (scale-out compute fabrics). Việc chỉ dựa vào CPU thường không cung cấp đủ số lượng làn kết nối hoặc tốc độ đủ nhanh cho tất cả các GPU, NIC và thiết bị lưu trữ cần thiết. Do đó, thay vì kết nối mọi thứ trực tiếp vào CPU, một switch PCIe (thường được tích hợp sẵn trong NIC) sẽ được sử dụng để kết nối tất cả các thành phần này lại với nhau.

Astera lập luận rằng với một switch đủ lớn, PCIe là một giải pháp khả thi để thay thế các công nghệ kết nối như NVLink trong các cấu trúc "scale-up", nơi hàng chục GPU hoạt động giống như một hệ thống lớn duy nhất mà không cần thiết kế lại các bộ tăng tốc (accelerator).

Tối ưu hóa cho Mixture-of-Experts (MoE)

Tuy nhiên, Astera không chỉ đơn thuần tạo ra một switch PCIe lớn hơn. Scorpio được trang bị nhiều khả năng tính toán trong mạng (in-network compute) tương tự như NVSwitch của Nvidia, giúp tăng tốc các hoạt động truyền thông tập thể.

Các hoạt động truyền thông này đặc biệt quan trọng đối với suy luận (inference) của AI tạo sinh. Các mô hình ngôn ngữ lớn (LLM) đang trở nên "tốn băng thông" hơn rất nhiều về mặt mạng lưới khi kiến trúc Mixture-of-Experts (MoE) ngày càng phổ biến.

Các mô hình MoE bao gồm nhiều mô hình con được gọi là các chuyên gia (experts). Với mỗi token được tạo ra, một lựa chọn khác nhau của các chuyên gia — có thể chạy trên các GPU khác nhau — sẽ được sử dụng. Bằng cách chuyển các hoạt động truyền thông tập thể sang switch, các GPU sẽ dành ít thời gian hơn để chờ mạng bắt kịp và nhiều thời gian hơn để xử lý token.

Astera đã đi xa hơn khi phát triển một hoạt động đa hướng (multicast) được tối ưu hóa cho suy luận MoE mà họ gọi là Hypercast.

"Một trong những hạn chế của multicast tiêu chuẩn là số lượng nhóm bạn thực sự có thể hỗ trợ, cũng như tính chất động của việc cần thay đổi các nhóm đó ngay lập tức cho các mô hình mixture-of-experts," Ahmad Danesh, Phó Chủ tịch quản lý sản phẩm tại Astera, chia sẻ với The Register.

Lựa chọn linh hoạt thay vì đối đầu trực tiếp

Mặc dù có những lợi ích rõ ràng khi sử dụng PCIe làm kết nối chip-to-chip, Scorpio không hoàn toàn là một sản phẩm thay thế trực tiếp cho các chip NVSwitch của Nvidia. NVSwitch 6, được công bố tại CES vào tháng 1, cung cấp băng thông cao hơn gần 3 lần ở mức 14,4 TB/s.

Tuy nhiên, Astera không cần cạnh tranh trực tiếp với NVSwitch. Trên thực tế, Astera đã công bố kế hoạch mở rộng hỗ trợ cho NVLink Fusion — nỗ lực của Nvidia nhằm mở kết nối tốc độ cao của mình cho hệ sinh thái rộng lớn hơn — vào mùa xuân năm ngoái.

Thay vào đó, Scorpio được định vị nhiều hơn như một giải pháp thay thế trung lập (vendor agnostic). Các công nghệ như NVLink Fusion hoặc giao thức UALink đang nổi lên, nhưng các chip cần được thiết kế xung quanh chúng. PCIe hoạt động với hầu hết mọi thứ vì nó đã được sử dụng để đưa dữ liệu vào và ra khỏi các bộ tăng tốc.

Ví dụ, nếu bạn muốn kết nối 32 thẻ Nvidia RTX Pro 6000 Server trở lên, bạn sẽ cần một switch PCIe, vì những GPU này không hỗ trợ NVLink.

PCIe cũng giúp việc kết hợp và ghép nối các chip dễ dàng hơn cho các kiến trúc suy luận tách rời (disaggregated inference architectures), giống như chúng ta đã thấy với Nvidia và Groq, AWS và Cerebras, hoặc Intel và SambaNova.

Các kiến trúc này liên quan đến việc sử dụng một bộ tăng tốc cho các hoạt động tiền xử lý (prefill) tốn nhiều tài nguyên tính toán và một bộ khác cho các hoạt động giải mã (decode) tốn nhiều băng thông. Để điều này hoạt động, các chip phải được kết nối với nhau. Nhiều nhà sản xuất chip AI đang thực hiện việc này qua Ethernet, nhưng PCIe sẽ trực tiếp hơn.

Quản lý và khả năng sẵn có

Cùng với dòng chip Scorpio X, Astera cũng đang mở rộng dòng switch Scorpio P-series với các mẫu có số lượng kết nối PCIe từ 32 đến 320 làn.

Tất cả các switch này đều hoạt động với bộ quản lý COSMOS, một nền tảng giám sát phần cứng được thiết kế để giúp theo dõi và giải quyết các vấn đề trên toàn bộ mạng kết nối.

Các switch Scorpio mới được làm mới của Astera hiện đang được gửi mẫu thử nghiệm, với sản xuất dự kiến sẽ tăng tốc vào nửa sau năm 2026.

Bài viết liên quan

Công nghệ

Xe tự hành Curiosity của NASA gặp sự cố "kẹt đá" khi khoan mẫu trên Sao Hỏa

06 tháng 5, 2026

Công nghệ

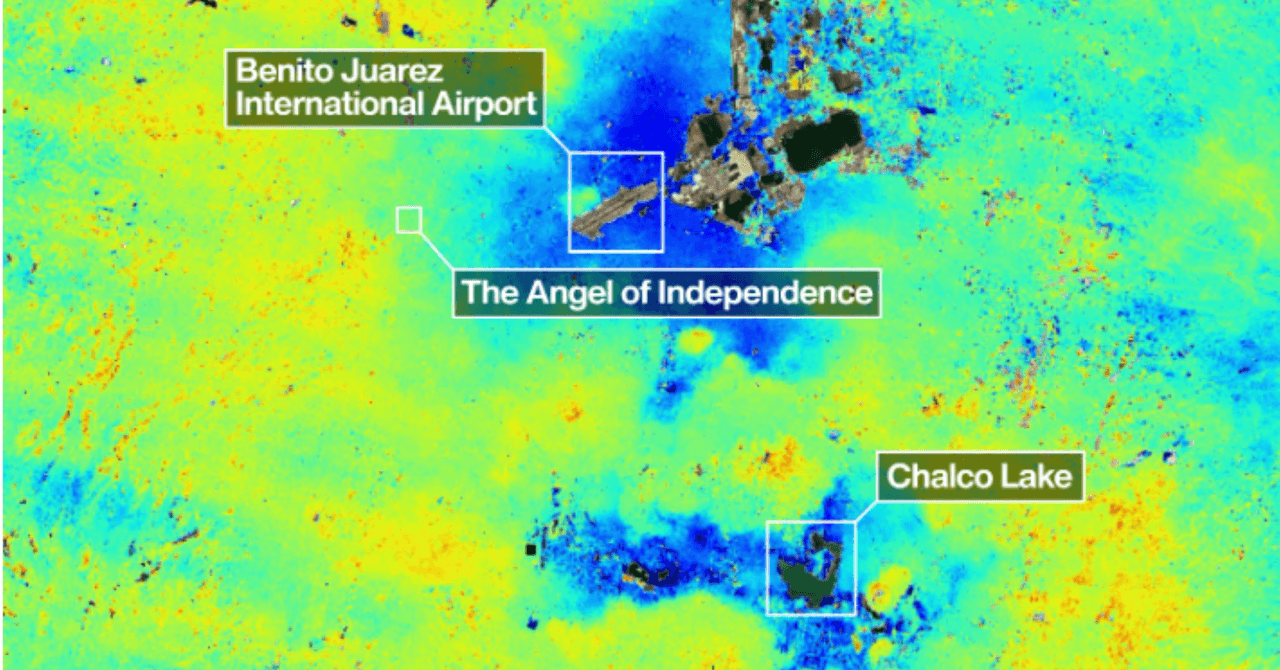

Vệ tinh NISAR của NASA hé lộ tốc độ sụt lún đáng báo động tại Thành phố Mexico

06 tháng 5, 2026

Công nghệ

Nutribullet Chill: Máy làm kem nhỏ gọn giải quyết nỗi lo không gian bếp chật hẹp

06 tháng 5, 2026