Cách GitHub bảo vệ các luồng công việc AI (Agentic Workflows) trong hệ thống CI/CD hiện đại

GitHub đã công bố kiến trúc bảo mật nhiều lớp cho các luồng công việc do AI điều hành (agentic workflows) trong các đường ống CI/CD. Thiết kế này tập trung vào sự cô lập, thực thi bị giới hạn và khả năng kiểm toán để giảm thiểu rủi ro từ việc tự động hóa bằng AI.

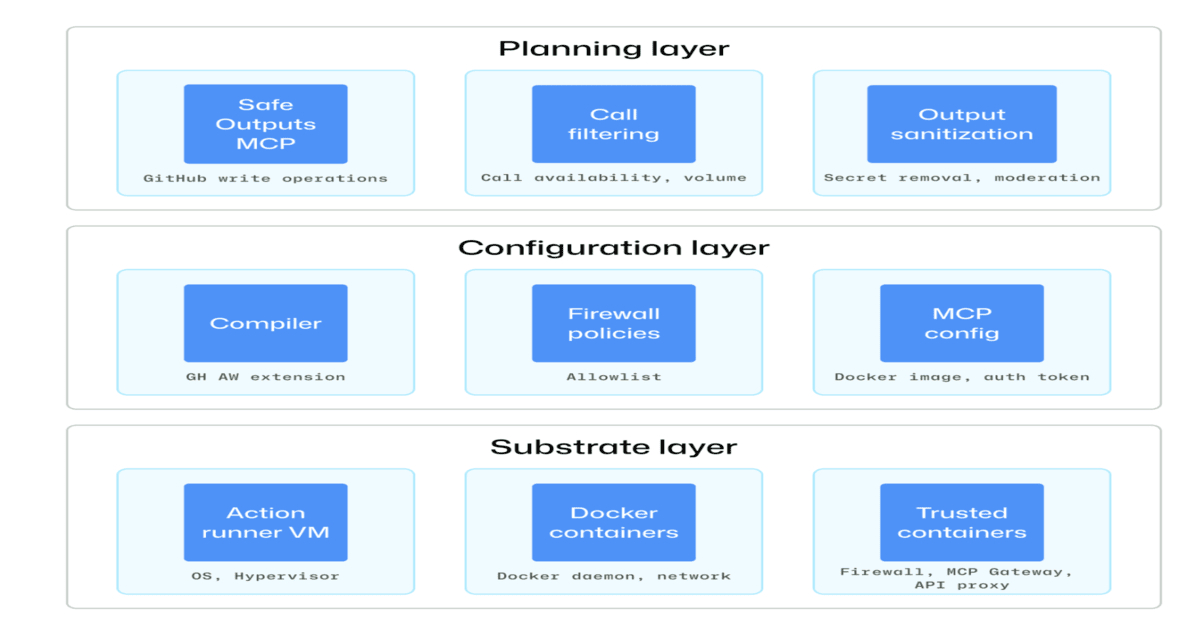

GitHub vừa chia sẻ chi tiết về kiến trúc bảo mật đằng sau các Agentic Workflows (luồng công việc do tác nhân AI điều hành), mô tả một cách tiếp cận "phòng thủ theo chiều sâu" (defense-in-depth) để tích hợp an toàn các tác nhân AI tự chủ vào các đường ống CI/CD. Thiết kế này nhấn mạnh vào sự cô lập, thực thi bị giới hạn và khả năng kiểm toán nhằm giảm thiểu các rủi ro mới do tự động hóa dựa trên AI mang lại.

Agentic Workflows mở rộng khả năng tự động hóa truyền thống bằng cách cho phép các tác nhân AI diễn giải ý định, đưa ra quyết định và thực thi nhiệm vụ ngay trong GitHub Actions. Mặc dù điều này mang lại lợi ích lớn về năng suất, nó cũng làm mở rộng bề mặt tấn công, bao gồm các rủi ro như prompt injection (tiêm lệnh), leo thang đặc quyền và các hành động không mong muốn.

/filters:no_upscale()/news/2026/05/github-agentic-workflows/en/resources/1Screenshot%202026-04-23%20at%2010.07.33%E2%80%AFPM-1777009711941.png) Kiến trúc bảo mật của GitHub cho Agentic Workflows

Kiến trúc bảo mật của GitHub cho Agentic Workflows

Mô hình bảo mật nhiều lớp

Tại cốt lõi của thiết kế này là một mô hình phân lớp được xây dựng dựa trên sự cô lập. Các tác nhân AI sẽ chạy trong các môi trường sandbox tạm thời (ephemeral) với quyền hạn bị hạn chế chặt chẽ, ngăn chặn sự duy trì trạng thái (persistence) và giới hạn phạm vi ảnh hưởng tiềm năng.

Theo mặc định, các luồng công việc sẽ hoạt động ở chế độ chỉ đọc (read-only). Bất kỳ thao tác ghi nào cũng phải thông qua các đầu ra an toàn được kiểm soát, chẳng hạn như pull request hoặc bình luận trên issue. Điều này đảm bảo rằng mọi thay đổi đều minh bạch, có thể xem xét và cần sự phê duyệt trước khi được áp dụng.

Ngăn chặn lộ mật khẩu và bí mật

Một nguyên tắc quan trọng là ngăn chặn việc tiếp xúc bí mật (secrets) với các tác nhân. Trong môi trường runner dùng chung, tác nhân có thể truy cập vào các biến môi trường, tệp cấu hình và trạng thái thời gian chạy, khiến việc tiêm prompt trở thành rủi ro nghiêm trọng.

Ví dụ, một đầu vào độc hại có thể đánh lừa tác nhân đọc thông tin đăng nhập từ các tệp cục bộ hoặc nhật ký và exfiltrate (tống xuất) chúng thông qua các cuộc gọi bên ngoài. GitHub giảm thiểu điều này bằng cách cô lập tác nhân trong các vùng chứa (container) chuyên biệt với lưu lượng mạng đi (egress) bị hạn chế, đồng thời định tuyến các thông tin đăng nhập nhạy cảm như token API thông qua các proxy và cổng tin cậy nằm ngoài ranh giới của tác nhân.

Giới hạn khả năng và kiểm soát đầu ra

Lớp bảo mật thứ hai hạn chế các khả năng của tác nhân. Quyền truy cập công cụ được cho phép một cách rõ ràng, giới hạn các API hoặc hệ thống mà tác nhân có thể gọi, trong khi sự cô lập mạng giúp giảm thiểu rủi ro rò rỉ dữ liệu.

Để hạn chế thêm tác động không mong muốn, GitHub phân chia các luồng công việc và hạn chế các thao tác ghi chỉ ở các đầu ra được kiểm soát. Các tác nhân chỉ có thể đề xuất thay đổi, sau đó được lưu vào bộ đệm và phân tích sau khi thực thi, đảm bảo các sửa đổi được xác thực và tuân thủ chính sách trước khi được commit.

"Những hàng rào bảo vệ này chính là điều khiến việc đưa tự động hóa tác nhân vào các kho lưu trữ sản xuất thực tế trở nên khả thi," — Eddie Aftandilian, Trưởng bộ phận Kỹ thuật Nền tảng tại XBOW.

Khả năng quan sát (Observability)

Khả năng quan sát tạo thành trụ cột cuối cùng. GitHub ghi lại hoạt động trên các ranh giới tin cậy, bao gồm lưu lượng mạng, tương tác mô hình, sử dụng công cụ và các hành động thời gian chạy nhạy cảm. Điều này cho phép khả năng truy xuất thực thi đầy đủ, hỗ trợ phân tích pháp y và cung cấp cơ sở để thực thi các chính sách kiểm soát luồng thông tin trong tương lai.

Bài viết liên quan

Công nghệ

Tổng hợp thị trường M&A an ninh mạng: 33 thương vụ được công bố trong tháng 4/2026

04 tháng 5, 2026

Phần mềm

Bun công bố hướng dẫn chuyển đổi sang Rust, nhưng gọi dự án viết lại là "chưa chín muồi"

05 tháng 5, 2026

Công nghệ

Nhà xuất bản cáo buộc Mark Zuckerberg cá nhân chỉ đạo vi phạm bản quyền để đào tạo AI Llama

05 tháng 5, 2026