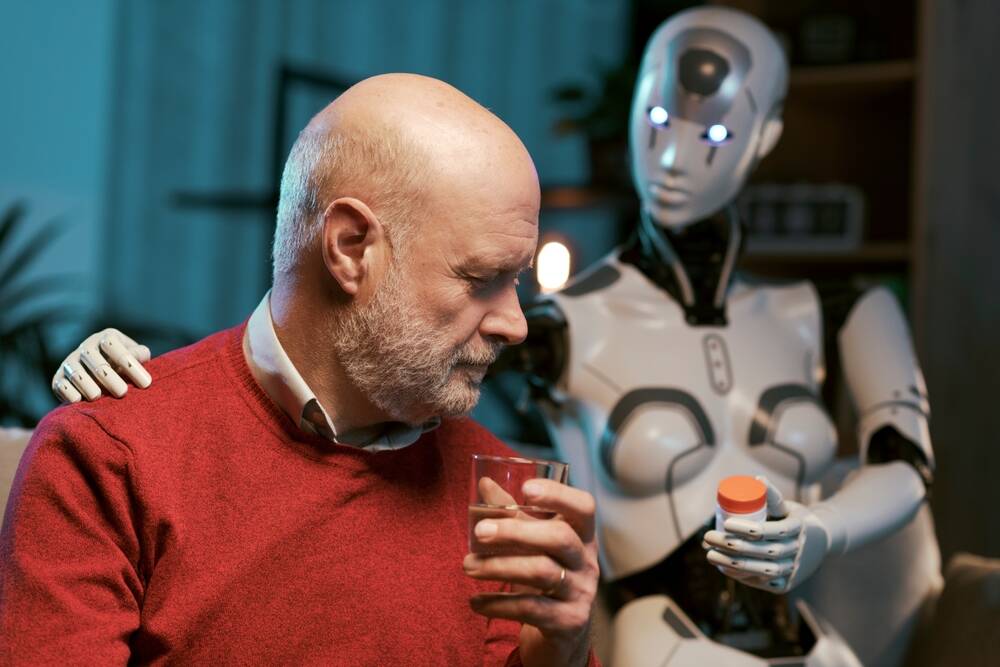

Đừng để AI đóng vai bác sĩ! Mô hình ngôn ngữ lớn sai sót đến 80% trong chẩn đoán sớm

Nghiên cứu mới từ Harvard cảnh báo các mô hình AI hàng đầu hiện nay thất bại trong việc chẩn đoán phân biệt sớm ở hơn 80% trường hợp. Các chuyên gia khuyên rằng không nên tin tưởng hoàn toàn vào AI để đưa ra nhận định y tế đối với bệnh nhân mà không có sự giám sát của con người.

Mọi người thường hỏi AI mọi loại câu hỏi, kể cả những vấn đề sức khỏe thường dành cho bác sĩ. Tuy nhiên, lần tới khi bạn định hỏi ChatGPT xem khối u trên mặt có phải là ung thư da hay không, hãy cân nhắc kỹ: nghiên cứu cho thấy các mô hình AI hàng đầu hiện nay thất bại trong việc chẩn đoán phân biệt sớm ở hơn 8 trên 10 trường hợp.

Dưới sự dẫn dắt của sinh viên y khoa Arya Rao từ Harvard, một nhóm nghiên cứu đã công bố kết quả trên tạp chí JAMA Network Open tuần này. Nghiên cứu đã kiểm tra 21 mô hình AI có sẵn trên thị trường thông qua 29 tình huống lâm sàng tiêu chuẩn. Các chatbot này hoạt động khá tốt khi được cung cấp đầy đủ thông tin y tế và yêu cầu đưa ra chẩn đoán cuối cùng, với tỷ lệ chính xác lên tới 91%. Tuy nhiên, tỷ lệ thất bại hơn 80% lại xuất hiện ở khâu chẩn đoán phân biệt sớm - giai đoạn mà các bác sĩ lâm sàng cố gắng loại trừ một số bệnh trạng trong khi cân nhắc các khả năng khác nhau.

"Mọi mô hình chúng tôi kiểm tra đều thất bại ở đại đa số các trường hợp," Rao chia sẻ. "Đó là giai đoạn mà sự không chắc chắn quan trọng nhất, và cũng là nơi các hệ thống này yếu kém nhất."

Nói cách khác, đây giống như việc lo âu lướt WebMD vào nửa đêm ngày xưa, nhưng nay được "tăng tốc" bởi AI và có khả năng sai lầm còn cao hơn cả chính bạn.

"Kết quả của chúng tôi cho thấy các mô hình ngôn ngữ lớn (LLM) hiện nay không nên được tin tưởng để suy luận chẩn đoán trực tiếp cho bệnh nhân mà không có sự xem xét toàn diện và có cấu trúc từ con người," Tiến sĩ Marc Succi, bác sĩ X quang tại Bệnh viện Đa khoa Massachusetts và đồng tác giả nghiên cứu, cho biết.

"Chúng có thể thể hiện sự tự tin mà không đưa ra lập luận vững chắc, đặc biệt là trong chẩn đoán phân biệt," Succi nói thêm, lưu ý rằng sự tự tin này có thể làm trầm trọng thêm nỗi lo âu của những bệnh nhân đang gặp vấn đề về căng thẳng.

Tuy nhiên, Rao chỉ ra rằng sự thất bại trong bài báo không nhất thiết có nghĩa là AI hoàn toàn chẩn đoán sai, mà là nó không đưa ra câu trả lời hoàn toàn chính xác. Bà cho rằng có thể nên đo lường AI bằng độ chính xác thô, dao động từ 63 đến 78% - cao hơn nhiều so với thước đo thất bại nghiêm ngặt được nhấn mạnh trong bài báo.

Dữ liệu thô "gợi ý rằng các mô hình thường đúng một phần, đưa ra một số nhưng không phải tất cả các câu trả lời đúng, ngay cả khi chúng không tạo ra một chẩn đoán phân biệt hoàn toàn chính xác theo định nghĩa tỷ lệ thất bại nghiêm ngặt," Rao giải thích.

Bên cạnh đó, nhóm nghiên cứu lập luận rằng định nghĩa về tỷ lệ thất bại nghiêm ngặt vẫn đáng được chú ý, đặc biệt khi các bot AI thường được quảng cáo là các tác nhân chăm sóc y tế tuyến đầu nhằm thu hẹp chẩn đoán trước khi chuyển bệnh nhân sang con người.

"Việc tiếp thị LLMs như các tác nhân chẩn đoán có nguy cơ tạo ra sự tự tin sai lầm đúng nơi chúng kém đáng tin cậy nhất," nhóm giải thích. "Những thất bại liên tục trong việc tạo ra chẩn đoán phân biệt và điều hướng sự không chắc chắn cho thấy LLMs chưa thể được tin tưởng trong việc ra quyết định tuyến đầu."

Succi cũng nói rằng tỷ lệ thành công cao hơn trong chẩn đoán cuối cùng không nên gây an tâm chủ quan, cảnh báo rằng dữ liệu đó có thể tạo ra cảm giác an toàn và năng lực sai lệch về mô hình.

"Lập luận lâm sàng thực sự bắt đầu sớm hơn, khi tính mơ hồ cao nhất, và đó chính là nơi chúng vẫn yếu kém nhất," Succi cảnh báo. "Ngay cả khi bạn cuối cùng có được câu trả lời đúng, chẩn đoán phân biệt sai có thể dẫn đến trì hoãn điều trị, các thủ tục không cần thiết với biến chứng, chi phí cao và nhiều hệ lụy khác."

Tóm lại, lần tới khi bạn lo lắng về một vấn đề sức khỏe, đừng lên mạng trừ khi là để tìm số điện thoại của bác sĩ để được chẩn đoán đúng đắn bởi con người. AI chưa sẵn sàng cho việc này.