Google giới thiệu TPU thế hệ thứ 8: TPU 8t và TPU 8i định hình kỷ nguyên AI tác tử

Google công bố hai chip TPU thế hệ thứ 8 mới là TPU 8t và TPU 8i, được thiết kế riêng biệt để tối ưu hóa cho việc huấn luyện mô hình lớn và suy luận tốc độ cao trong kỷ nguyên AI tác tử. Các chip này mang lại hiệu suất vượt trội, khả năng mở rộng quy mô lớn và cải thiện đáng kể hiệu suất năng lượng so với thế hệ trước.

Google giới thiệu TPU thế hệ thứ 8: TPU 8t và TPU 8i định hình kỷ nguyên AI tác tử

Tại hội nghị Google Cloud Next vừa diễn ra, Google đã chính thức công bố thế hệ thứ 8 của bộ xử lý Tensor (TPU) do chính hãng phát triển. Điểm nhấn của lần ra mắt này là sự ra đời của hai kiến trúc chip chuyên biệt: TPU 8t dành cho huấn luyện và TPU 8i dành cho suy luận (inference). Cả hai đều được thiết kế để cung cấp sức mạnh cho siêu máy tính của Google, đáp ứng các yêu cầu khắt khe của kỷ nguyên AI tác tử (Agentic AI).

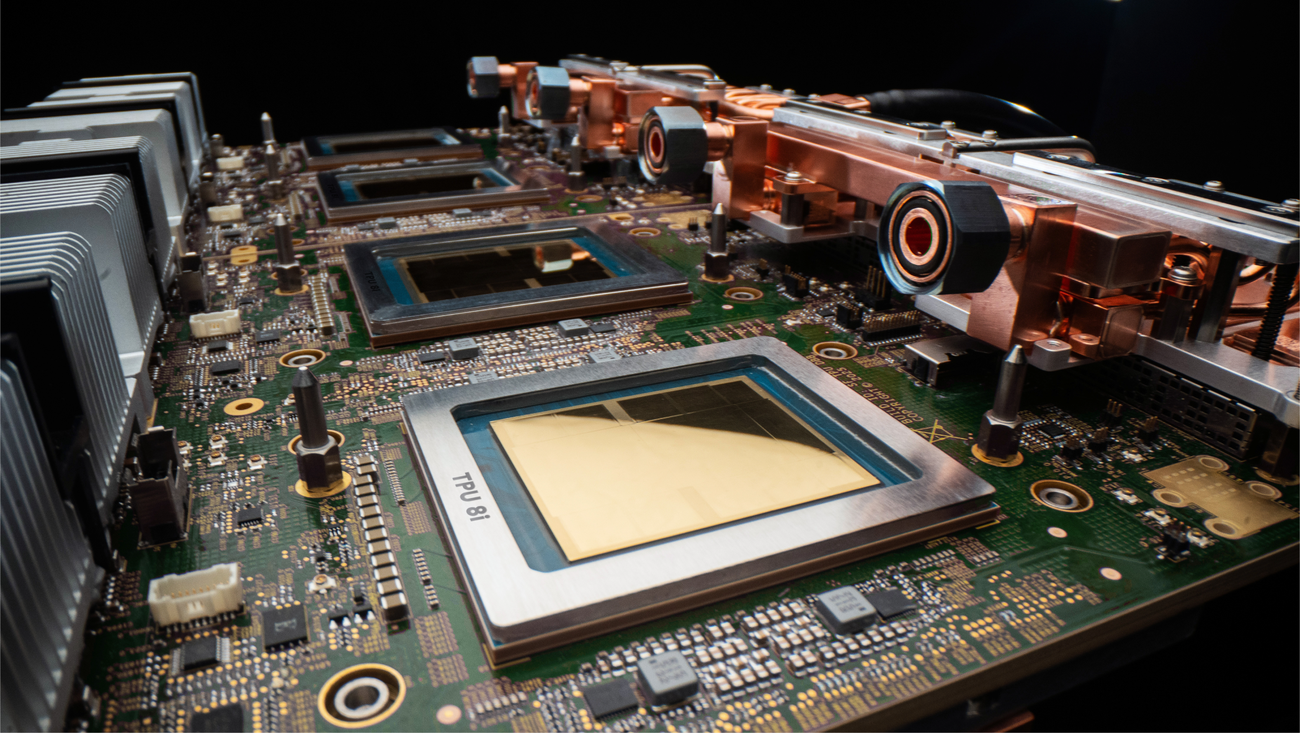

TPU thế hệ thứ 8

TPU thế hệ thứ 8

Trong kỷ nguyên mới này, các mô hình AI không chỉ đơn thuần trả lời câu hỏi mà còn phải suy luận, thực thi các quy trình đa bước và tự học hỏi từ hành động của mình. Điều này đặt ra những yêu cầu mới mẻ về cơ sở hạ tầng, và TPU 8t cùng TPU 8i chính là câu trả lời của Google sau hơn một thập kỷ phát triển công nghệ TPU.

Hai chip cho hai nhiệm vụ chuyên biệt

Google nhận thấy rằng việc phát triển phần cứng mất nhiều thời gian hơn phần mềm, do đó họ đã dự đoán trước sự gia tăng nhu cầu về suy luận khi các mô hình AI tiên phong được đưa vào sản xuất thực tế. Thay vì dùng một loại chip cho mọi việc, Google quyết định tách biệt hai dòng chip để tối ưu hóa hiệu suất:

- TPU 8t: Tập trung vào khả năng xử lý tính toán khổng lồ để huấn luyện các mô hình tiên phong (frontier models).

- TPU 8i: Tập trung vào băng thông bộ nhớ cao để xử lý các khối lượng công việc suy luận nhạy cảm về độ trễ, đặc biệt quan trọng khi các tác tử AI cần tương tác liên tục với nhau.

TPU 8t: Cỗ máy huấn luyện mạnh mẽ

TPU 8t được xây dựng để rút ngắn chu kỳ phát triển mô hình từ vài tháng xuống còn vài tuần. Với khả năng mở rộng quy mô lớn, một siêu nhóm TPU 8t (superpod) hiện có thể mở rộng lên đến 9.600 chip và 2 petabyte bộ nhớ chia sẻ băng thông cao.

TPU 8t

TPU 8t

Điểm nổi bật của TPU 8t bao gồm:

- Hiệu suất tính toán: Cung cấp 121 ExaFlops sức mạnh tính toán, mang lại hiệu suất tính toán trên mỗi nhóm (pod) cao gấp gần 3 lần so với thế hệ trước.

- Tận dụng tối đa: Tích hợp quyền truy cập lưu trữ nhanh hơn 10 lần kết hợp với công nghệ TPUDirect để kéo dữ liệu trực tiếp vào TPU, đảm bảo hệ thống hoạt động ở công suất tối đa.

- Độ tin cậy: Được thiết kế để đạt trên 97% "goodput" (thời gian tính toán hữu ích), nhờ các khả năng RAS (Độ tin cậy, Khả dụng và Khả năng bảo trì) toàn diện như tự động phát hiện và định tuyến lại các liên kết lỗi mà không làm gián đoạn công việc.

TPU 8i: Động cơ suy luận tốc độ cao

Trong khi TPU 8t tập trung vào sức mạnh thô, TPU 8i lại được thiết kế để xử lý các tác vụ suy luận phức tạp, lặp đi lặp lại của nhiều tác tử AI chuyên biệt. Google đã thiết kế lại toàn bộ ngăn xếp (stack) để loại bỏ hiệu ứng "phòng chờ" thông qua bốn đột phá chính:

- Phá vỡ "bức tường bộ nhớ": TPU 8i kết hợp 288 GB bộ nhớ băng thông cao (HBM) với 384 MB SRAM trên chip (gấp 3 lần thế hệ trước), giữ toàn bộ tập dữ liệu làm việc của mô hình ngay trên chip.

- Hiệu quả với Axion: Sử dụng CPU chủ dựa trên Arm tùy chỉnh Axion của Google, tối ưu hóa hệ thống cho hiệu suất vượt trội.

- Mở rộng mô hình MoE: Tăng gấp đôi băng thông Liên kết liên chip (ICI) lên 19,2 Tb/s và sử dụng kiến trúc Boardfly mới để giảm độ trễ mạng.

- Loại bỏ độ trễ: Công cụ tăng tốc tập hợp (Collectives Acceleration Engine - CAE) tích hợp trên chip giảm độ trễ trên chip lên đến 5 lần.

Những cải tiến này giúp TPU 8i mang lại hiệu suất trên mỗi đô la tốt hơn 80% so với thế hệ trước, cho phép các doanh nghiệp phục vụ lượng khách hàng gần như gấp đôi với cùng chi phí.

Thiết kế đồng bộ và hiệu suất năng lượng

Cả TPU 8t và TPU 8i đều là minh chứng mới nhất cho triết lý "thiết kế đồng bộ" (co-design) của Google, nơi mọi thông số kỹ thuật đều được xây dựng để giải quyết các thách thức lớn nhất của AI. Cả hai nền tảng đều hỗ trợ các khung công việc phổ biến như JAX, PyTorch, vLLM và cung cấp quyền truy cập bare metal cho khách hàng.

Hệ thống làm mát

Hệ thống làm mát

Về hiệu suất năng lượng, Google đã tối ưu hóa trên toàn bộ ngăn xếp, giúp TPU thế hệ 8 mang lại hiệu suất trên mỗi watt tốt hơn gấp 2 lần so với thế hệ trước (Ironwood). Cả hai chip đều được hỗ trợ bởi công nghệ làm mát bằng chất lỏng thế hệ thứ tư, giúp duy trì mật độ hiệu suất mà làm mát bằng khí không thể đạt được.

Cả TPU 8t và TPU 8i sẽ có mặt chung vào cuối năm nay và có thể được sử dụng như một phần của Google AI Hypercomputer, mang lại giải pháp toàn diện cho các khối lượng công việc AI trong tương lai.

Bài viết liên quan

Phần cứng

Đánh giá xe đạp điện Segway Myon: Khi công nghệ trở nên thừa thãi?

04 tháng 6, 2026

Công nghệ

Microsoft giới thiệu Surface Pro 12 và Surface Laptop 8: Sức mạnh chip Intel, giá thành gây sốc

19 tháng 5, 2026

Công nghệ

Đánh giá Corsair Galleon 100 SD: Khi Stream Deck được tích hợp ngay trên bàn phím

27 tháng 5, 2026