Kiến Trúc AI Địa Phương An Toàn: Giải Pháp Cầu Nối Giữa WSL2 và Ollama

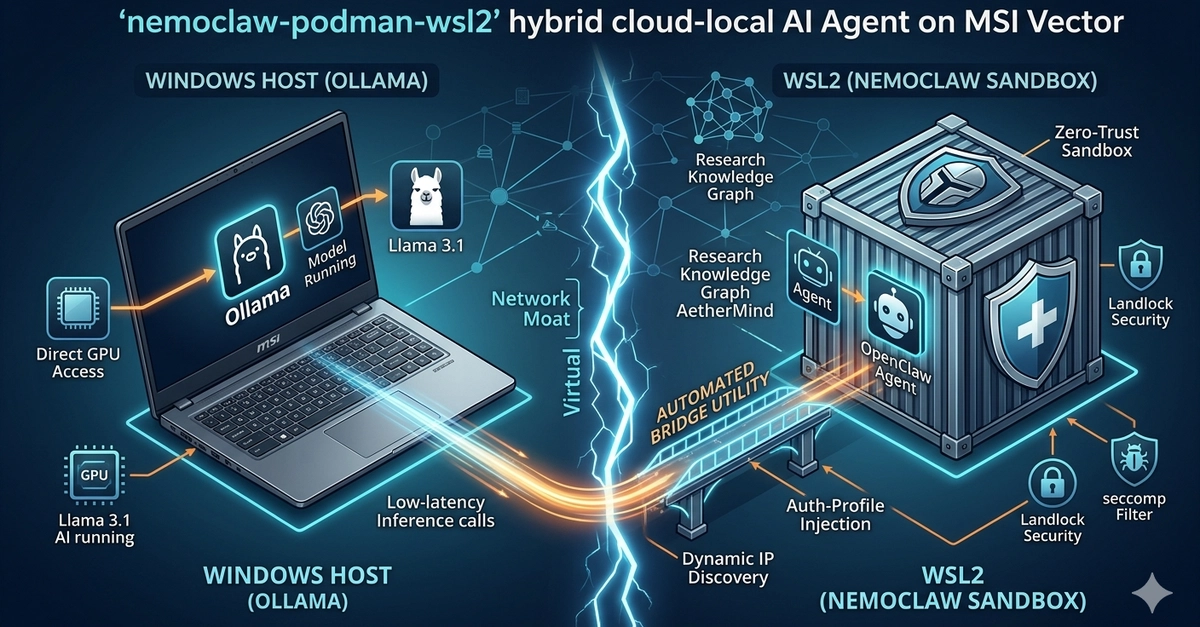

Trong bối cảnh các Agent AI ngày càng phát triển, việc bảo vệ dữ liệu riêng tư là ưu tiên hàng đầu. Bài viết này khám phá cách kiến trúc một môi trường 'Local-First' an toàn, sử dụng công cụ cầu nối mã nguồn mở nemoclaw-podman-wsl2 để kết nối hiệu quả giữa WSL2 và Ollama.

Xây Dựng Các Agent AI An Toàn Tại Nơi (Local-First) với NemoClaw, Podman và Ollama

Trong bối cảnh các Agent AI ngày càng phát triển, việc bảo vệ dữ liệu riêng tư là ưu tiên hàng đầu. Bài viết này khám phá cách kiến trúc một môi trường 'Local-First' an toàn, sử dụng công cụ cầu nối mã nguồn mở nemoclaw-podman-wsl2 để kết nối hiệu quả giữa WSL2 và Ollama.

Sự Chuyển Đổi Sang AI Địa Phương (Local-First)

Khi chúng ta di chuyển hướng tới các hệ thống tự chủ hơn, cuộc tranh luận giữa "Quyền Lượng Dữ Liệu" (Data Sovereignty) và "Khả Năng" (Capability) đang ngày càng gay gắt. Đối với nhiều tổ chức và nhà nghiên cứu, việc gửi dữ liệu độc quyền hoặc các bản ghi nghiên cứu sang các mô hình ngôn ngữ lớn (LLM) dựa trên đám mây là một lựa chọn không khả thi.

Trong quá trình làm việc trên dự án nghiên cứu AetherMind (một dự án đồ thị tri thức), tác giả đã thiết kế kiến trúc một môi trường "Zero-Trust" cục bộ cho các Agent AI. Mục tiêu tuy đơn giản nhưng thực thi lại khá phức tạp:

- Xác suất (Inference): Sử dụng các mô hình LLM hiệu năng cao trên máy cục bộ thông qua Ollama.

- Bảo mật: Tạo sandbox ở cấp độ kernel thông qua NVIDIA NemoClaw.

- Phần cứng: Tận dụng toàn bộ sức mạnh của máy tính MSI Vector 16 HX (máy chủ RTX) trong khi duy trì sự phân tách rõ ràng giữa Windows và WSL2.

Thách Thức Kỹ Thuật: Rào Cản Mạng

Rào cản lớn nhất trong kiến trúc "Local-First" này là ranh giới mạng.

Thông thường, Ollama chạy trên máy chủ Windows để có quyền truy cập trực tiếp và độ trễ thấp vào GPU. Trong khi đó, NemoClaw (và runtime OpenShell của nó) hoạt động bên trong WSL2 để tận dụng các tính năng bảo mật gốc của Linux như Landlock và seccomp.

Theo mặc định, hai môi trường này bị tách biệt. Khi một Agent NemoClaw cố gắng gọi một mô hình cục bộ, kết nối sẽ bị từ chối. Hầu hết các hệ thống sẽ "thất bại" (fail-over) sang các nhà cung cấp đám mây như Anthropic hoặc OpenAI. Nếu bạn chưa cấu hình khóa API đám mây, Agent đơn giản sẽ gặp lỗi xác thực và sập.

Giải Pháp: Công Cụ Cầu Nối Đa Năng

Tác giả đã phát triển một tiện ích chuyên biệt để nối liền khoảng cách này mà không làm giảm tính bảo mật. Nó đảm bảo rằng sandbox WSL2 có thể khám phá và xác thực với động cơ suy luận chạy trên Windows theo thời gian thực, bất kể IP có thay đổi sau khi khởi động lại.

Công cụ này đã được phát hành dưới dạng mã nguồn mở với tên nemoclaw-podman-wsl2.

Các Điểm Nổi Bật Kỹ Thuật:

- Khám phá IP Động: Sử dụng máy chủ tên WSL để giải quyết IP của Máy chủ Windows theo thời gian thực.

- Đăng ký Nhà cung cấp Buộc (Force-Registration): Ghi đè logic mặc định là "Anthropic-first" bằng cách chèn nhà cung cấp cục bộ Ollama vào đầu danh sách auth-profiles.json.

- Thân thiện với Podman: Đã được kiểm tra cụ thể cho các nhà phát triển thích sử dụng Podman thay vì Docker Desktop để quản lý container cục bộ.

Hướng Dẫn Triển Khai Chi Tiết

Bước 1: Chuẩn bị Máy chủ Windows (Ollama)

Cấu hình Ollama để lắng nghe trên tất cả các giao diện để WSL2 có thể tiếp cận:

# Chạy trong PowerShell Admin

netsh interface portproxy add v4tov4 listenport=11434 listenaddress=0.0.0.0 connectport=11434 connectaddress=127.0.0.1

Khởi động lại Ollama và đảm bảo tường lửa Windows cho phép lưu lượng truy cập đầu vào trên cổng 11434.

Bước 2: Triển khai Cầu Nối (WSL2)

Clone tiện ích và chạy script cài đặt đã được xác minh:

git clone https://github.com/suryakumaran2611/nemoclaw-podman-wsl2

cd nemoclaw-podman-wsl2

chmod +x setup_nemoclaw.sh

./setup_nemoclaw.sh

Bước 3: Xác Minh Vòng Lặp Bảo Mật

Sau khi được kết nối, truy cập sandbox và khởi động terminal tương tác:

nemoclaw main connect

Bên trong sandbox:

openclaw tui

Lời Kết

Kiến trúc cho AI địa phương không chỉ là về quyền riêng tư; đó là về kiểm soát. Bằng cách bảo vệ "các tay" của Agent trong một sandbox NemoClaw trong khi giữ "bộ não" trong một phiên bản Ollama hiệu năng cao, chúng ta tạo ra một khung khổ vững chắc cho các công cụ tự động thế hệ mới.

Tác giả rất mong chờ thấy cách những người khác thích ứng cầu nối này cho các thiết lập phần cứng chuyên biệt của riêng họ. Nếu bạn có câu hỏi hoặc muốn đóng góp cho logic, hãy kết nối với chúng tôi trên GitHub hoặc trong phần bình luận!

Bài viết liên quan

Công nghệ

George Orwell đã tiên đoán sự trỗi dậy của "rác thải AI" trong tác phẩm 1984

16 tháng 4, 2026

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026