Mặt tối của trào lưu "AI Doomer": Khi ngôn ngữ cực đoan dẫn đến bạo lực

Một thanh niên 20 tuổi đã ném bom xăng vào nhà của CEO OpenAI Sam Altman, bị thúc đẩy bởi niềm tin tuyệt đối vào thuyết diệt vong của AI. Sự kiện này đặt ra câu hỏi gay gắt về trách nhiệm của các nhà lý thuyết an toàn AI khi ngôn từ của họ biến thành hành động thực tế.

Vào lúc 3:45 sáng ngày thứ Sáu tuần trước, một thanh niên 20 tuổi đã ném một quả bom xăng (Molotov cocktail) vào nhà của Sam Altman. Sau đó, hắn đi bộ khoảng 5km đến trụ sở chính của OpenAI và đe dọa sẽ đốt cháy tòa nhà này. Hiện tại, nghi phạm đã bị bắt giữ với cáo buộc cố ý giết người.

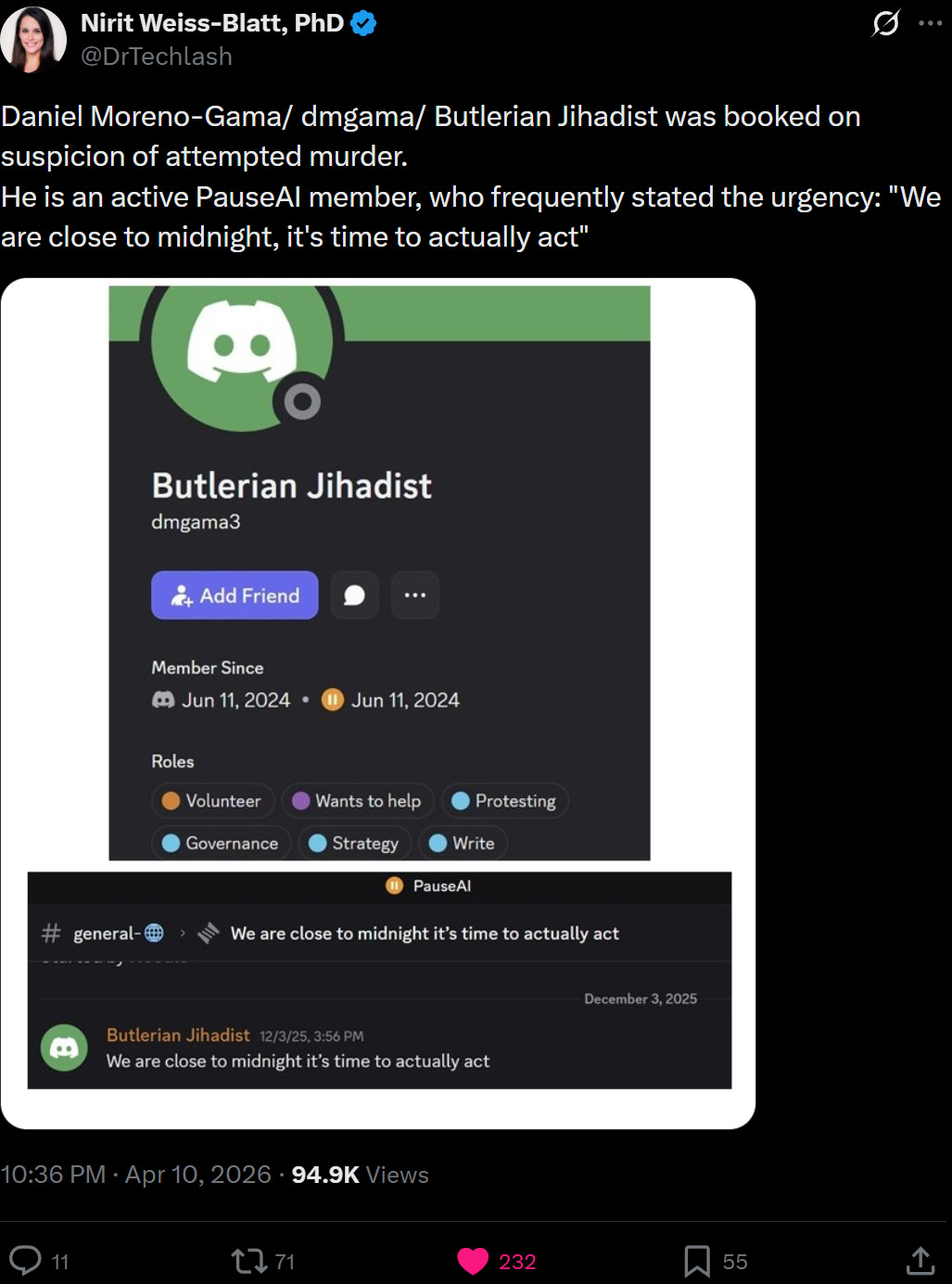

Tên của hắn là Daniel Moreno-Gama. Tuy nhiên, điều đáng lo ngại hơn là động cơ đằng sau hành động này. Hắn không phải là một kẻ cực đoan đơn lẻ hoạt động riêng lẻ, mà là một thành viên tích cực của tổ chức PauseAI, một nhóm vận động đình chỉ phát triển AI. Trên Discord, hắn sử dụng biệt danh "Butlerian Jihadist" — một tham chiếu đến cuộc thánh chiến chống lại máy móc trong vũ trụ Dune. Instagram của hắn đầy ắp các nội dung bi quan về AI (doomer content), từ các biểu đồ năng lực cho đến những nhận định rằng "nếu chúng ta không hành động ngay, chúng ta sẽ chết".

Nội dung bi quan về AI trên mạng xã hội

Nội dung bi quan về AI trên mạng xã hội

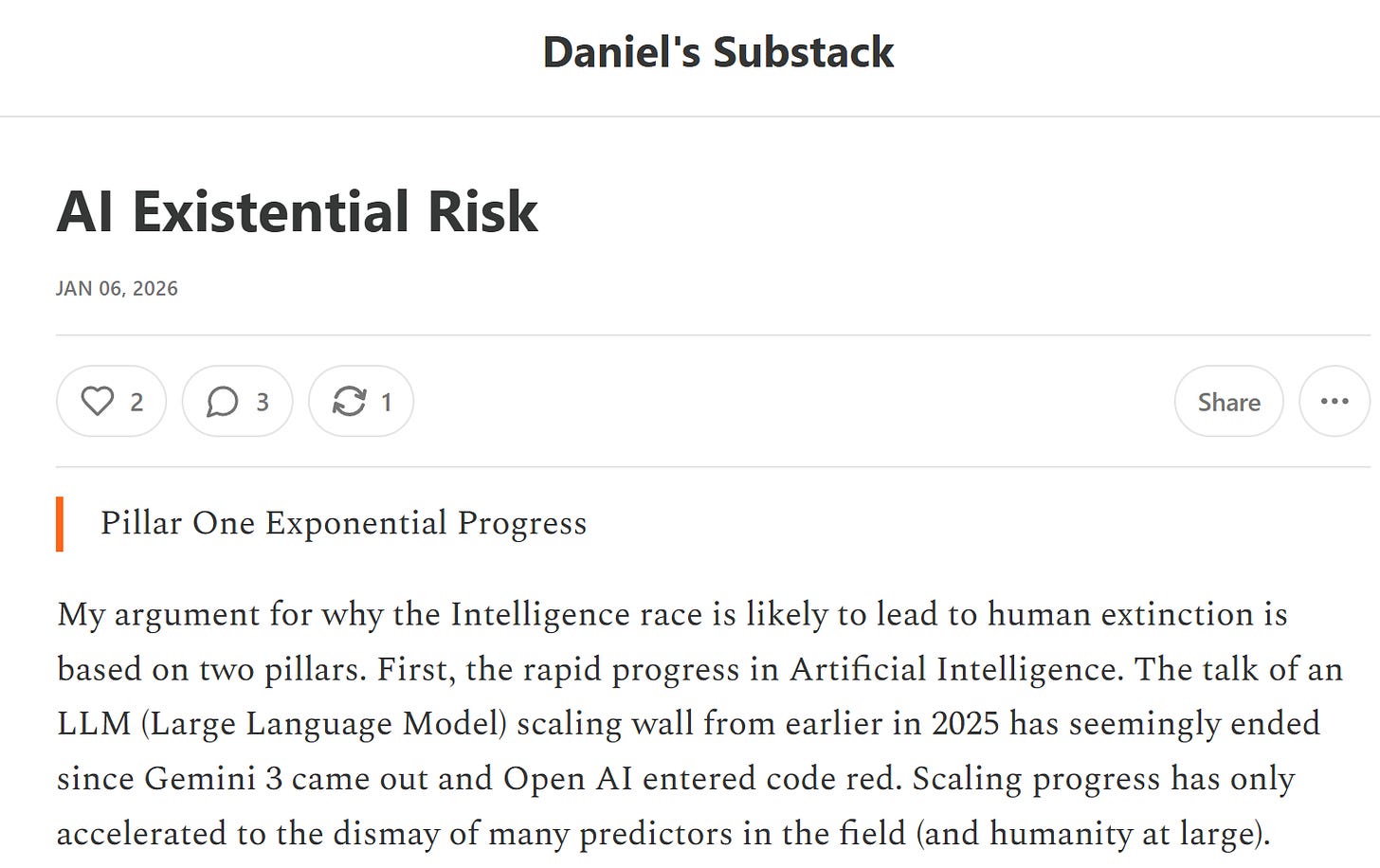

Bốn tháng trước khi tấn công, hắn đã giới thiệu cuốn sách "If Anyone Builds It, Everyone Dies" (Nếu Ai đó Xây Dựng Nó, Mọi Người Sẽ Chết) của Yudkowsky và Soares cho những người theo dõi mình. Trên blog cá nhân, hắn đánh giá xác suất AI gây ra sự diệt vong của loài người là "gần như chắc chắn" và kết luận: "Chúng ta phải đối phó với mối đe dọa này trước, rồi mới đặt câu hỏi sau".

Sự kiện này là một ví dụ điển hình và đáng sợ của việc lý thuyết "bi quan về AI" (AI Doomerism) bị đẩy đến cực hạn.

Khung lý thuyết của sự chắc chắn

Vấn đề bắt nguồn từ những tuyên bố mang tính tuyệt đối trong cộng đồng an toàn AI. Eliezer Yudkowsky, một trong những nhân vật nổi tiếng nhất của trào lưu này, từng khẳng định trên tạp chí TIME rằng nếu bất kỳ ai xây dựng một AI đủ thông minh, mọi người trên Trái đất sẽ chết. Không phải "có thể", mà là "chắc chắn". Ông thậm chí đã lập luận rằng việc không kích oanh các trung tâm dữ liệu là một sai lầm, và rủi ro của một cuộc chiến hạt nhân vẫn tốt hơn là để một đợt huấn luyện AI hoàn tất.

Biểu đồ minh họa rủi ro

Biểu đồ minh họa rủi ro

Trong cộng đồng này, các thành viên cạnh tranh nhau để chứng minh sự cam kết bằng cách nâng cao mức độ rủi ro. Con số P(doom) — xác suất diệt vong — leo thang từ 50% lên 90%, thậm chí 99,99999%. Người phát ngôn của Trung tâm An toàn AI (Center for AI Safety) từng nói trên camera rằng phản hồi đúng đắn là "đi đến các phòng lab trên khắp đất nước và đốt cháy chúng".

Khi "lời nói suông" gặp thực tế

Các nhà lý thuyết trò chơi có một thuật ngữ cho hiện tượng này: "cheap talk" (lời nói suông) — là những tín hiệu không tốn kém mà cuối cùng sẽ va phải thực tế. Khi bạn đặt mức cược là sự sinh tồn của toàn bộ loài người, bạn có thể biện minh cho bất kỳ mức độ cực đoan nào nếu nó giúp giảm bớt P(doom) thiêng liêng đó.

Daniel Moreno-Gama đã đọc cuốn sách đó, gia nhập cộng đồng đó và viết bản tuyên ngôn của riêng mình. Trong một bài viết, hắn tự nhận mình là một người theo chủ nghĩa hậu quả (consequentialist): "Tôi rất ít khi quan tâm đến ý định nếu kết quả không phù hợp". Hắn coi những người xây dựng AI là "sinh vật hèn hạ" và thậm chí viết thơ tưởng tượng cái chết của những đứa trẻ của các kỹ sư AI.

Hắn đã đưa ra một bài toán xe điện (trolley problem): Một mạng sống so với toàn bộ nhân loại. Và hắn đã kéo cần gạt.

Nghịch lý của người bi quan

Có một sự mỉa mai cuối cùng cần được lưu ý. Nếu những người theo chủ nghĩa bi quan thực sự tin vào niềm tin được tuyên bố của họ ở mức độ tự tin như vậy, họ nên trung thực hơn về những gì niềm tin đó hàm ý. Khi được hỏi tại sao không tấn công các trung tâm dữ liệu nếu AI nguy hiểm đến vậy, câu trả lời của Yudkowsky (được Soares truyền lại) là: "Nếu bạn thấy một tiêu đề nói tôi đã làm điều đó, bạn có nói 'ồ, AI đã dừng lại, chúng ta an toàn' không? Nếu không, bạn đã biết nó sẽ không hiệu quả".

Hãy chú ý xem câu trả lời đó không phải là gì. Nó không phải là "vì bạo lực là sai". Nó là "vì nó chưa hiệu quả". Sự kiềm chế mang tính chiến lược, không phải đạo đức.

Đây là điểm yếu sâu sắc nhất trong toàn bộ thế giới quan của những người bi quan: sự nhầm lẫn giữa trí thông minh và quyền lực. Họ tin rằng một AI đủ thông minh sẽ tự động có khả năng hủy diệt nhân loại. Tương tự, họ tin rằng trí thông minh ngôn ngữ của mình cho phép họ có quyền lực tư tưởng để quyết định số phận của công nghệ.

Yudkowsky có thể chối bỏ trách nhiệm với gã trai cầm bom xăng. Nhưng ông không thể chối bỏ phép suy luận (syllogism) của mình. Nếu những người xây dựng AI sẽ giết tất cả mọi người, thì ngăn chặn những người xây dựng là tự vệ. Đó là tuyên bố trung tâm, được nói ra một cách rõ ràng. Câu hỏi duy nhất luôn luôn là khi nào thì ai đó sẽ coi nó là sự thật.

Họ nên ngừng giả vờ ngạc nhiên khi chính logic của họ xuất hiện lúc 3:45 sáng với một chai đầy xăng.