Mistral nâng cấp Le Chat với Remote Agents và Work Mode, ra mắt mô hình Medium 3.5

Mistral vừa ra mắt mô hình Mistral Medium 3.5 với 128 tỷ tham số, được thiết kế để xử lý lập trình và suy luận hiệu quả. Đồng thời, công ty cũng giới thiệu các khả năng tác nhân đám mây (cloud-based agents) mới trong sản phẩm Vibe và chế độ Work Mode cho Le Chat.

Mistral đã công bố Mistral Medium 3.5, một mô hình ngôn ngữ lớn (LLM) với 128 tỷ tham số, được tối ưu hóa để xử lý việc tuân thủ hướng dẫn, suy luận và lập trình trong cùng một hệ thống. Đi kèm với đó là sự ra mắt của các khả năng tác nhân đám mây (cloud-based agents) mới trong các sản phẩm Vibe và Le Chat của hãng.

Mô hình Mistral Medium 3.5 hiện đã có sẵn dưới dạng bản xem trước công khai với trọng số mở theo giấy phép MIT đã sửa đổi. Nó hỗ trợ cửa sổ ngữ cảnh lên đến 256k token và có khả năng tự lưu trữ (self-host) trên một số lượng nhỏ GPU. Một điểm nổi bật là tính năng cấu hình nỗ lực suy luận cho từng yêu cầu, cho phép tạo ra cả câu trả lời ngắn gọn hoặc các quy trình thực thi đa bước dài hơn.

Remote Agents và chuyển đổi sang đám mây

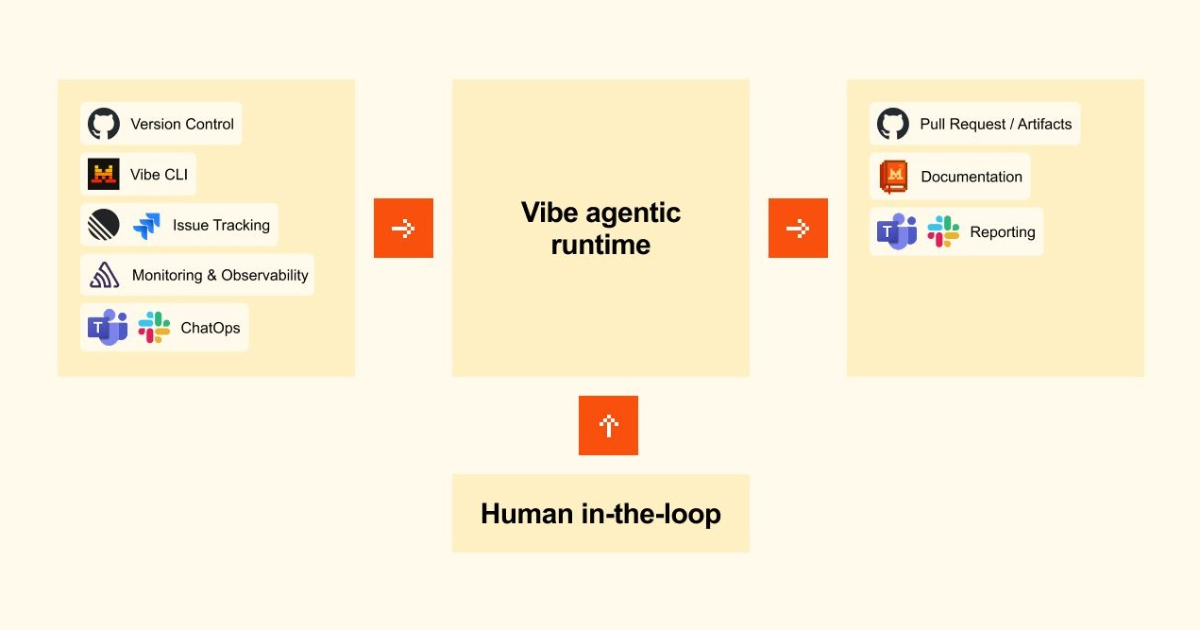

Bản phát hành này cũng giới thiệu các tác nhân lập trình từ xa (remote coding agents) trong Mistral Vibe, đánh dấu sự chuyển đổi việc thực thi từ môi trường cục bộ sang thời gian chạy trên đám mây. Các nhà phát triển có thể bắt đầu phiên lập trình từ giao diện dòng lệnh (CLI) hoặc ngay trong Le Chat, nơi các nhiệm vụ tiếp tục chạy không đồng bộ.

Các phiên làm việc có thể được chuyển từ thực thi cục bộ sang đám mây mà vẫn giữ nguyên trạng thái và lịch sử, đồng thời nhiều tác nhân có thể chạy song song. Mỗi phiên hoạt động trong một môi trường cô lập, nơi tác nhân có thể sửa đổi mã, cài đặt các phần phụ thuộc và tương tác với các hệ thống bên ngoài. Khi hoàn thành nhiệm vụ, các tác nhân có thể tạo đầu ra như pull request và thông báo cho người dùng xem xét.

Mistral Medium 3.5 đóng vai trò là mô hình mặc định cho các tác nhân này và thay thế các mô hình cũ hơn trong CLI của Vibe. Nó được thiết kế cho các quy trình làm việc kéo dài (long-running workflows), bao gồm các nhiệm vụ đa bước yêu cầu sử dụng công cụ và đầu ra có cấu trúc. Mô hình cũng bao gồm một bộ mã hóa hình ảnh (vision encoder) được đào tạo để xử lý các đầu vào hình ảnh biến đổi.

Work Mode trên Le Chat

Ngoài ra, Mistral đã giới thiệu chế độ Work Mode mới trên Le Chat, cho phép một tác nhân thực hiện các quy trình làm việc đa bước trên các công cụ được kết nối. Trong chế độ này, hệ thống có thể truy cập các nguồn dữ liệu bên ngoài, thực hiện phân tích và thực hiện các hành động như soạn thảo tin nhắn, tạo vấn đề (issues) hoặc tạo báo cáo.

Tác nhân hoạt động với khả năng hiển thị các hành động của mình, bao gồm cả các cuộc gọi công cụ và các bước trung gian, đồng thời yêu cầu sự phê duyệt của người dùng cho các thao tác nhạy cảm. Các phiên duy trì qua nhiều bước, cho phép tác nhân lặp lại cho đến khi nhiệm vụ hoàn thành.

Phản hồi của cộng đồng

Phản hồi từ cộng đồng trên X (Twitter cũ) phần lớn là tích cực, với lời khen ngợi cho việc chuyển giao mượt mà từ cục bộ sang đám mây, sự hào hứng về đà tăng trưởng của AI tại EU và sự đánh giá cao đối với một mô hình dày (dense model) có khả năng chạy trên ít GPU hơn.

Nhà phát triển Jarek Sobiecki nhận xét: "Mô hình mới - Cho đến nay thì rất tốt. Một sự cải thiện đáng kể so với DevStral 2! Tôi đã kiểm tra thấy nó hoạt động tốt với Helm templates, cải thiện trên GitLab pipeline hoặc tạo các bài kiểm tra đầu cuối (end-to-end tests). Nó phù hợp tốt với kỳ vọng và không có các lỗi ngẫu nhiên nào. Đây thực sự là một công việc tốt!"

Tuy nhiên, một số người dùng cũng lưu ý đến so sánh về giá cả, cho rằng mức giá hiện tại hơi cao so với kích thước của mô hình khi so sánh với các đối thủ như Gemini 3 Flash.

So với các công cụ như OpenAI Codex, Cursor và Claude Code, Mistral tập trung vào cách tiếp cận hướng tới nhà phát triển với trọng số mở, tùy chọn tự lưu trữ và thực thi tác nhân dựa trên đám mây. Các tác nhân từ xa của họ cũng phản ánh xu hướng rộng lớn hơn hướng tới các quy trình làm việc AI không đồng bộ, đa bước chạy độc lập và tích hợp vào các quy trình phát triển phần mềm. Hệ thống tích hợp với các công cụ dành cho nhà phát triển như GitHub, Jira và Slack, cho phép các tác nhân hoạt động trong các quy trình làm việc hiện có.