Model Context Protocol (MCP) là gì? Hướng dẫn toàn tập cho kỹ sư phần mềm

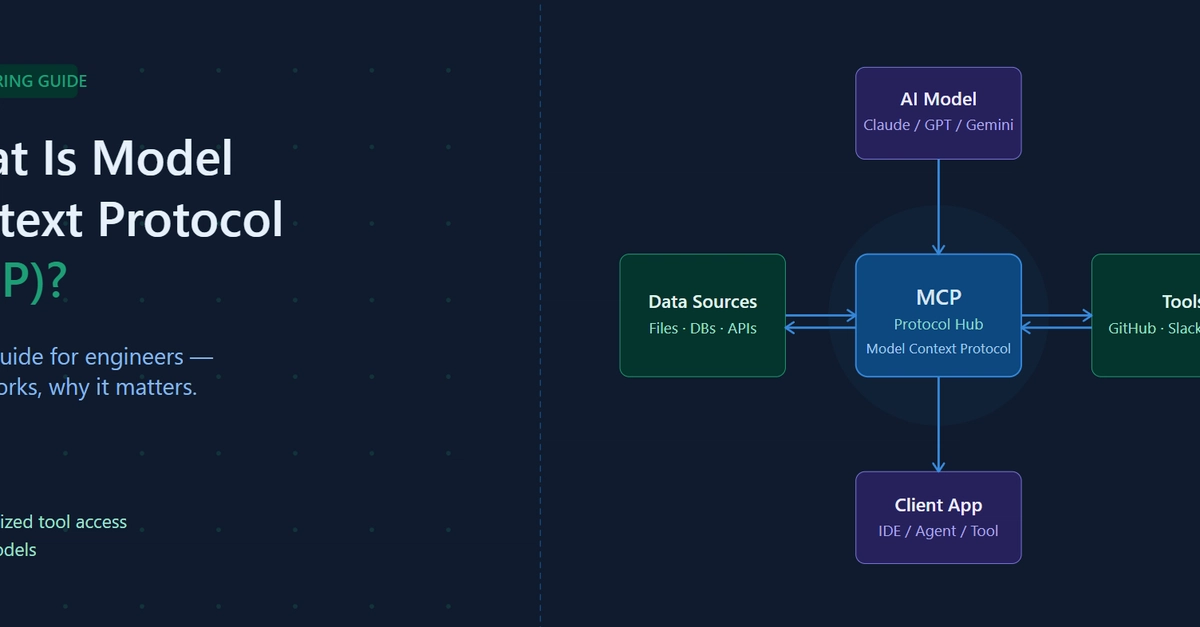

Model Context Protocol (MCP) là một tiêu chuẩn mở giúp các tác nhân AI kết nối và tương tác với các công cụ bên ngoài một cách thống nhất. Bài viết này giải thích cách MCP giải quyết bài toán tích hợp phức tạp, cơ chế hoạt động và lý do tại sao hệ sinh thái của nó lại phát triển nhanh chóng.

Nếu tuần này bạn đã thấy cụm từ "MCP" xuất hiện ba lần — trong một bản mô tả công việc, một cuộc thảo luận trên Slack và một kho lưu trữ GitHub — và bạn chỉ gật đầu cho qua mà không thực sự chắc chắn nó là gì, thì bài viết này dành cho bạn.

Model Context Protocol (Giao thức Ngữ cảnh Mô hình) thực ra không hề phức tạp. Nó giải quyết một vấn đề cụ thể, thực hiện việc đó một cách gọn gàng, và một khi bạn hiểu được vấn đề đó là gì, giải pháp sẽ trở nên hoàn toàn hợp lý. Dưới đây là mọi thứ bạn cần biết.

Vấn đề mà MCP giải quyết

Các mô hình AI rất giỏi trong việc suy luận. Tuy nhiên, bản thân chúng hoàn toàn bị cô lập. Một mô hình ngôn ngữ được huấn luyện trên văn bản biết rất nhiều điều, nhưng nó không biết dữ liệu trong cơ sở dữ liệu của bạn là gì, trong kênh Slack của bạn đang có gì, hay những nhiệm vụ nào hiện đang mở trên Jira. Nó không thể gửi email, truy vấn CRM của bạn, hay kích hoạt một quá trình triển khai (deployment).

Để các tác nhân AI có thể thực hiện công việc hữu ích — không chỉ trả lời câu hỏi mà thực sự hành động — chúng cần kết nối với các công cụ và nguồn dữ liệu bên ngoài. Trước khi có MCP, mỗi kết nối đó đều được xây dựng riêng (custom-built). Một đội ngũ xây dựng trợ lý AI cho quy trình kỹ thuật của họ sẽ phải viết một tích hợp riêng cho GitHub, một cái khác cho Jira, và thêm một cái nữa cho hệ thống triển khai nội bộ của họ. Không một tích hợp nào trong số đó có thể chuyển sang cho đội ngũ khác sử dụng. Không cái nào có thể tái sử dụng trên các LLM khác nhau. Nếu họ muốn chuyển từ OpenAI sang Claude, họ phải viết lại các tích hợp. Nếu một đội ngũ khác muốn chức năng tương tự, họ phải xây dựng từ đầu.

BCG đã đưa ra một con số về vấn đề này: nếu không có một giao thức chuẩn, độ phức tạp của tích hợp sẽ tăng theo cấp số nhân khi các tác nhân AI nhân lên trong một tổ chức. Mỗi tác nhân mới cần các kết nối riêng của nó đến mọi công cụ mà nó cần. Sự phức tạp này cộng hưởng rất nhanh.

MCP giải quyết vấn đề này bằng cách chuẩn hóa kết nối. Thay vì mỗi đội ngũ xây dựng các tích hợp tùy chỉnh, các công cụ sẽ tự hiển thị dưới dạng máy chủ MCP (MCP servers) sử dụng một giao diện duy nhất. Bất kỳ tác nhân nào tương thích với MCP đều có thể kết nối với bất kỳ máy chủ MCP nào mà không cần mã tùy chỉnh. Tích hợp được xây dựng một lần và hoạt động ở khắp mọi nơi.

MCP thực chất là gì?

Model Context Protocol là một tiêu chuẩn mở — ban đầu được Anthropic phát hành vào tháng 11 năm 2024, được quyên tặng cho Linux Foundation vào tháng 12 năm 2025 như một phần của Quỹ Agentic AI mới thành lập — định nghĩa cách các tác nhân AI khám phá và gọi các công cụ bên ngoài.

Tại cốt lõi của nó, MCP là một giao thức truyền thông. Nó quy định:

- Cách mô tả công cụ: Một máy chủ MCP hiển thị danh sách các công cụ với các định nghĩa có cấu trúc: tên, mô tả, lược đồ đầu vào, lược đồ đầu ra. LLM đọc các định nghĩa này để hiểu công cụ nào có sẵn và cách sử dụng chúng.

- Cách gọi công cụ: Khi một tác nhân muốn sử dụng công cụ, nó gửi một yêu cầu có cấu trúc đến máy chủ MCP. Máy chủ thực thi công cụ và trả về phản hồi có cấu trúc. Mọi thứ đều truyền qua định dạng thông báo tiêu chuẩn dựa trên JSON-RPC 2.0.

- Cách hoạt động khám phá: Các tác nhân truy vấn máy chủ MCP để tìm ra những công cụ mà nó cung cấp. Điều này có nghĩa là các tác nhân có thể thích ứng với các công cụ có sẵn thay vì yêu cầu các định nghĩa công cụ được mã hóa cứng (hard-coded).

So sánh hợp lý nhất là: MCP đối với các tác nhân AI giống như USB-C đối với các thiết bị. Trước khi có USB-C, mỗi thiết bị sử dụng một cổng kết nối khác nhau. Dây sạc, dây dữ liệu, dây cáp hiển thị — tất cả đều khác nhau và không tương thích. USB-C đã chuẩn hóa cổng kết nối. Bạn cắm vào và nó hoạt động, bất kể thiết bị hay cáp nào.

MCP đã chuẩn hóa kết nối giữa các tác nhân AI và công cụ. Một tác nhân "nói" MCP có thể kết nối với bất kỳ công cụ nào cũng "nói" MCP, bất kể LLM nào cung cấp sức mạnh cho tác nhân đó hay công cụ đó kết nối với hệ thống nào.

Cách hoạt động trong ba bước

Bước 1: Chủ sở hữu công cụ tạo ra một máy chủ MCP. Đây là một dịch vụ nhẹ (lightweight service) hiển thị một hoặc nhiều công cụ — chẳng hạn như chức năng truy vấn cơ sở dữ liệu, khả năng nhắn tin qua Slack, môi trường thực thi mã — sử dụng giao diện MCP. Máy chủ mô tả những công cụ nó cung cấp và cách gọi chúng.

Bước 2: Tác nhân khám phá các công cụ có sẵn. Khi một tác nhân khởi tạo, nó truy vấn máy chủ MCP và nhận được danh sách có cấu trúc các công cụ có sẵn cùng với lược đồ của chúng. Tác nhân giờ đây biết nó có thể làm gì.

Bước 3: Tác nhân gọi một công cụ. Khi LLM quyết định nó cần sử dụng một công cụ — dựa trên yêu cầu của người dùng và các công cụ mà nó biết có sẵn — nó gửi một lệnh gọi công cụ có cấu trúc đến máy chủ MCP. Máy chủ thực thi công cụ và trả về kết quả. LLM kết hợp kết quả đó vào suy luận của nó và tiếp tục.

Đó là toàn bộ vòng lặp. LLM không cần biết chi tiết triển khai của công cụ. Công cụ không cần biết bất cứ điều gì về LLM. Giao thức xử lý cuộc hội thoại giữa chúng.

Tại sao hệ sinh thái lại phát triển nhanh chóng

MCP ra mắt vào tháng 11 năm 2024. Đến tháng 4 năm 2025, số lượt tải xuống máy chủ MCP đã tăng từ khoảng 100.000 lên hơn 8 triệu mỗi tháng. Đến cuối năm 2025, có hơn 5.800 máy chủ MCP công khai có sẵn, bao gồm mọi thứ từ Slack, Confluence và Sentry đến cơ sở dữ liệu, môi trường thực thi mã và hệ thống doanh nghiệp nội bộ. Lượt tải xuống SDK đã vượt qua 97 triệu mỗi tháng.

Ba yếu tố đã thúc đẩy việc áp dụng nhanh chóng như vậy.

Thứ nhất, các nhà cung cấp LLM lớn đã xác nhận ngay lập tức. Anthropic đã xây dựng nó, nhưng OpenAI, Google và Microsoft đã áp dụng trong vòng vài tháng. Sự hỗ trợ đa nhà cung cấp đó có nghĩa là các nhà phát triển có thể xây dựng tích hợp MCP một lần và sử dụng chúng với bất kỳ LLM nào.

Thứ hai, chi phí tích hợp giảm xuống gần bằng không đối với chủ sở hữu công cụ. Việc hiển thị một API hiện có dưới dạng máy chủ MCP chỉ cần một lượng nhỏ mã bao bọc (wrapper code). Các công ty như Slack, Datadog và Sentry đã thêm hỗ trợ MCP nhanh chóng vì nỗ lực bổ sung là tối thiểu.

Thứ ba, các nhà phát triển đang rất cần điều này. Phương án thay thế — xây dựng và duy trì các tích hợp công cụ tùy chỉnh cho từng tác nhân, từng đội ngũ, từng LLM — là rõ ràng đau đớn. MCP đã mang lại sự giải tỏa mà người ta cảm thấy ngay lập tức.

Những gì MCP không bao gồm

MCP định nghĩa kết nối. Nó không định nghĩa các quy tắc xung quanh kết nối.

Giao thức không có cơ chế tích hợp sẵn để chỉ định tác nhân nào được phép gọi công cụ nào. Nó không có ghi nhật ký kiểm tra (audit logging). Nó không có cách nào để phát hiện xem phản hồi của công cụ có chứa các lệnh được chèn (injected instructions) được thiết kế để thao túng LLM hay không. Nó không có khái niệm về chính sách truy cập cho từng đội ngũ.

Đây không phải là một lỗi — đó là một quyết định phạm vi có chủ đích. Các giao thức luôn giữ ở mức tối thiểu. Lớp quản trị (governance layer) được xây dựng trên nền tảng đó.

Đối với các đội ngũ sử dụng MCP trong phát triển cục bộ hoặc thử nghiệm quy mô nhỏ, khoảng trống này có thể quản lý được. Đối với các đội ngũ triển khai các tác nhân trong môi trường sản xuất với nhiều đội ngũ, dữ liệu nhạy cảm và các yêu cầu tuân thủ, khoảng cách giữa những gì MCP cung cấp và những gì triển khai doanh nghiệp yêu cầu là đáng kể.

Khoảng trống đó chính là thứ mà một cổng MCP (MCP gateway) lấp đầy: một lớp quản trị và bảo mật nằm trước các máy chủ MCP của bạn và xử lý xác thực, kiểm soát truy cập, ghi nhật ký kiểm tra và phạm vi công cụ ở một nơi, nhất quán, cho mọi tác nhân đi qua nó.

Cổng MCP của TrueFoundry được xây dựng riêng cho lớp này. Nó kết nối với nhà cung cấp danh tính hiện có của bạn, thực thi RBAC ở cấp độ công cụ, ghi lại mọi lần gọi công cụ với đầy đủ ngữ cảnh và triển khai hoàn toàn trong cơ sở hạ tầng của riêng bạn — để dữ liệu của bạn không bao giờ rời khỏi môi trường của bạn. Các đội ngũ đang quản lý khối lượng công việc AI đáng kể đã sử dụng nó để đưa MCP từ hoạt động trong bản demo sang hoạt động đáng tin cậy trong môi trường sản xuất, trên nhiều đội ngũ, ở quy mô doanh nghiệp.

Bài viết liên quan

Công nghệ

George Orwell đã tiên đoán sự trỗi dậy của "rác thải AI" trong tác phẩm 1984

16 tháng 4, 2026

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026