Nhân viên của bạn đang chạy AI cục bộ: Tại sao suy luận trên thiết bị trở thành "điểm mù" mới của CISO?

Sự chuyển dịch phần cứng đang thúc đẩy việc sử dụng mô hình ngôn ngữ lớn (LLM) từ mạng lưới xuống thiết bị đầu cuối, tạo ra kỷ nguyên "mang mô hình của riêng bạn" (BYOM). Điều này tạo ra những rủi ro mới về tính toàn vẹn, tuân thủ và chuỗi cung ứng mà các biện pháp bảo mật mạng truyền thống không thể phát hiện. Các CISO cần chuyển trọng tâm kiểm soát từ việc chặn URL sang quản lý các hiện vật mô hình ngay trên máy tính của nhân viên.

Trong 18 tháng qua, sách lược của các Giám đốc An ninh Thông tin (CISO) đối với AI tạo sinh khá đơn giản: Kiểm soát trình duyệt.

Các đội ngũ an ninh đã thắt chặt chính sách CASB (Broker bảo mật truy cập đám mây), chặn hoặc giám sát lưu lượng truy cập đến các điểm cuối AI nổi tiếng và định tuyến việc sử dụng thông qua các cổng được chấp thuận. Mô hình vận hành rất rõ ràng: Nếu dữ liệu nhạy cảm rời mạng lưới để thực hiện lệnh gọi API bên ngoài, chúng ta có thể quan sát, ghi nhật ký và ngăn chặn nó. Nhưng mô hình đó đang bắt đầu phá sản.

Một sự chuyển dịch phần cầm lặng lẽ đang đẩy việc sử dụng Mô hình Ngôn ngữ Lớn (LLM) ra khỏi mạng lưới và lên trên thiết bị đầu cuối. Hãy gọi nó là Shadow AI 2.0, hay kỷ nguyên "Mang mô hình của riêng bạn" (BYOM): Nhân viên chạy các mô hình có khả năng mạnh mẽ ngay cục bộ trên laptop, ngoại tuyến, không có lệnh gọi API và không có dấu hiệu mạng rõ ràng. Cuộc trò chuyện về quản trị vẫn được định hình là "rò rỉ dữ liệu ra đám mây", nhưng rủi ro doanh nghiệp cấp bách hơn hiện nay ngày càng là "suy luận chưa được kiểm tra bên trong thiết bị".

Khi suy luận diễn ra cục bộ, các biện pháp Phòng ngừa Mất dữ liệu (DLP) truyền thống không thể nhìn thấy sự tương tác đó. Và khi an ninh không thể nhìn thấy nó, họ không thể quản lý nó.

Tại sao suy luận cục bộ đột nhiên trở nên khả thi

Cách đây hai năm, chạy một LLM hữu ích trên máy tính làm việc là một trò chơi khéo léo ngách. Ngày nay, đó là việc bình thường đối với các đội ngũ kỹ thuật.

Ba yếu tố đã hội tụ:

- Bộ tăng tốc cấp người dùng nghiêm túc: Một MacBook Pro với 64GB bộ nhớ thống nhất thường có thể chạy các mô hình lớp 70B đã lượng tử hóa ở tốc độ sử dụng được (với các giới hạn thực tế về độ dài ngữ cảnh). Những thứ từng yêu cầu nhiều máy chủ GPU hiện nay khả thi trên một laptop cao cấp cho nhiều quy trình làm việc thực tế.

- Lượng tử hóa trở nên phổ biến: Giờ đây rất dễ nén các mô hình thành các định dạng nhỏ hơn, nhanh hơn vừa vặn với bộ nhớ laptop, thường với sự đánh đổi chất lượng chấp nhận được cho nhiều nhiệm vụ.

- Phân phối không ma sát: Các mô hình có trọng số mở (open-weight) chỉ cách một lệnh duy nhất, và hệ sinh thái công cụ làm cho việc "tải xuống -> chạy -> trò chuyện" trở nên tầm thường.

Kết quả: Một kỹ sư có thể kéo xuống một hiện vật mô hình nhiều GB, tắt Wi-Fi và chạy các quy trình làm việc nhạy cảm cục bộ: xem xét mã nguồn, tóm tắt tài liệu, soạn thảo liên lạc khách hàng, thậm chí phân tích khám phá trên các tập dữ liệu được điều chỉnh. Không có gói tin đi ra, không có nhật ký proxy, không có đường dẫn kiểm toán đám mây.

Từ góc độ bảo mật mạng, hoạt động đó có thể trông không thể phân biệt được với "không có gì xảy ra".

Rủi ro không còn chỉ là dữ liệu rời khỏi công ty

Nếu dữ liệu không rời khỏi laptop, tại sao CISO cần quan tâm?

Bởi vì các rủi ro chủ yếu chuyển từ việc rò rỉ sang tính toàn vẹn, nguồn gốc và sự tuân thủ. Trong thực tế, suy luận cục bộ tạo ra ba lớp điểm mù mà hầu hết các doanh nghiệp chưa vận hành hóa.

1. Nhiễu mã và quyết định (rủi ro toàn vẹn)

Các mô hình cục bộ thường được áp dụng vì chúng nhanh, riêng tư và "không cần phê duyệt". Nhược điểm là chúng thường chưa được kiểm tra cho môi trường doanh nghiệp.

Một kịch bản phổ biến: Một nhà phát triển cấp cao tải xuống một mô hình mã hóa được tinh chỉnh bởi cộng đồng vì nó có điểm chuẩn tốt. Họ dán logic xác thực nội bộ, luồng thanh toán hoặc tập lệnh cơ sở hạ tầng vào để "làm sạch nó". Mô hình trả về kết quả trông có năng lực, biên dịch được và vượt qua các bài kiểm tra đơn vị, nhưng làm suy giảm subtly tư thế bảo mật (xác thực đầu vào yếu, mặc định không an toàn, thay đổi đồng thời mong manh, các lựa chọn phụ thuộc không được phép nội bộ). Kỹ sư đó cam kết thay đổi.

Nếu tương tác đó xảy ra ngoại tuyến, bạn có thể không có bất kỳ hồ sơ nào cho thấy AI đã ảnh hưởng đến đường dẫn mã. Và khi sau này bạn phản hồi sự cố, bạn sẽ điều tra triệu chứng (một lỗ hổng) mà không có khả năng nhìn thấy nguyên nhân chính (việc sử dụng mô hình không kiểm soát).

2. Giấy phép và phơi bày IP (rủi ro tuân thủ)

Nhiều mô hình hoạt động hiệu quả cao đi kèm với giấy phép bao gồm các hạn chế về sử dụng thương mại, yêu cầu ghi nhận, giới hạn lĩnh vực sử dụng hoặc nghĩa vụ có thể không tương thích với phát triển sản phẩm độc quyền. Khi nhân viên chạy mô hình cục bộ, việc sử dụng đó có thể bỏ qua quy trình mua sắm và xem xét pháp lý bình thường của tổ chức.

Nếu một nhóm sử dụng mô hình phi thương mại để tạo mã sản xuất, tài liệu hoặc hành vi sản phẩm, công ty có thể kế thừa rủi ro xuất hiện sau này trong quá trình thẩm định M&A, đánh giá bảo mật của khách hàng hoặc kiện tụng. Phần khó không chỉ là các điều khoản giấy phép, mà là thiếu hàng tồn kho và khả năng truy xuất nguồn gốc. Nếu không có trung tâm mô hình được quản lý hoặc hồ sơ sử dụng, bạn có thể không thể chứng minh cái gì đã được sử dụng ở đâu.

3. Phơi bày chuỗi cung ứng mô hình (rủi ro nguồn gốc)

Suy luận cục bộ cũng thay đổi vấn đề chuỗi cung ứng phần mềm. Các thiết bị đầu cuối bắt đầu tích lũy các hiện vật mô hình lớn và các chuỗi công cụ xung quanh chúng: trình tải xuống, bộ chuyển đổi, thời gian chạy, plugin, vỏ UI và gói Python.

Có một sắc thái kỹ thuật quan trọng ở đây: Định dạng tệp quan trọng. Trong khi các định dạng mới hơn như Safetensors được thiết kế để ngăn chặn thực thi mã tùy ý, các tệp PyTorch dựa trên Pickle cũ hơn có thể thực thi các tải độc hại chỉ đơn giản bằng cách được tải. Nếu các nhà phát triển của bạn đang lấy các điểm kiểm tra chưa được kiểm tra từ Hugging Face hoặc các kho lưu trữ khác, họ không chỉ đang tải xuống dữ liệu — họ có thể đang tải xuống một khai thác.

Các đội ngũ bảo mật đã dành hàng thập kỷ để học cách xử lý các tệp thực thi không xác định là thù địch. BYOM yêu cầu mở rộng tư duy đó sang các hiện vật mô hình và ngăn xếp thời gian chạy xung quanh. Khoảng cách tổ chức lớn nhất hiện nay là hầu hết các công ty không có tương đương với hóa đơn vật liệu phần mềm (SBOM) cho các mô hình: Nguồn gốc, băm, nguồn được phép, quét và quản lý vòng đời.

Giảm thiểu BYOM: Coi trọng số mô hình như hiện vật phần mềm

Bạn không thể giải quyết suy luận cục bộ bằng cách chặn URL. Bạn cần các điều khiển nhận biết thiết bị đầu cuối và trải nghiệm nhà phát triển làm cho con đường an toàn trở thành con đường dễ dàng.

Dưới đây là ba cách thực tế:

1. Đưa quản trị xuống thiết bị đầu cuối

DLP mạng và CASB vẫn quan trọng cho việc sử dụng đám mây, nhưng chúng không đủ cho BYOM. Bắt đầu xử lý việc sử dụng mô hình cục bộ như một vấn đề quản trị thiết bị đầu cuối bằng cách tìm kiếm các tín hiệu cụ thể:

- Hàng tồn kho và phát hiện: Quét các chỉ số độ trung thực cao như tệp .gguf lớn hơn 2GB, quy trình như llama.cpp hoặc Ollama và trình nghe cục bộ trên cổng mặc định phổ biến 11434.

- Nhận thức quy trình và thời gian chạy: Giám sát việc sử dụng GPU/NPU (đơn vị xử lý thần kinh) cao lặp đi lặp lại từ các thời gian chạy chưa được phê duyệt hoặc máy chủ suy luận cục bộ không xác định.

- Chính sách thiết bị: Sử dụng chính sách MDM (Quản lý thiết bị di động) và EDR (Phản hồi và phát hiện thiết bị đầu cuối) để kiểm soát cài đặt các thời gian chạy chưa được phê duyệt và thực hiện tăng cường cơ sở trên các thiết bị kỹ thuật. Điểm không phải là trừng phạt thử nghiệm. Đó là để lấy lại khả năng hiển thị.

2. Cung cấp con đường trải nhựa: Một trung tâm mô hình nội bộ được tuyển chọn

Shadow AI thường là kết quả của ma sát. Các công cụ được chấp nhận quá hạn chế, quá chung chung hoặc quá chậm để phê duyệt. Một cách tiếp cận tốt hơn là cung cấp một danh mục nội bộ được tuyển chọn bao gồm:

- Các mô hình được chấp thuận cho các nhiệm vụ phổ biến (mã hóa, tóm tắt, phân loại).

- Giấy phép được xác minh và hướng dẫn sử dụng.

- Các phiên bản được ghim với băm (ưu tiên các định dạng an toàn hơn như Safetensors).

- Tài liệu rõ ràng cho việc sử dụng cục bộ an toàn, bao gồm nơi dữ liệu nhạy cảm được và không được phép. Nếu bạn muốn các nhà phát triển ngừng săn lùng, hãy cho họ thứ gì đó tốt hơn.

3. Cập nhật ngôn ngữ chính sách: "Dịch vụ đám mây" không còn đủ nữa

Hầu hết các chính sách sử dụng chấp nhận được nói về các công cụ SaaS và đám mây. BYOM yêu cầu chính sách bao gồm rõ ràng:

- Tải xuống và chạy các hiện vật mô hình trên các thiết bị đầu cuối của công ty.

- Nguồn chấp nhận được.

- Yêu cầu tuân thủ giấy phép.

- Quy tắc sử dụng mô hình với dữ liệu nhạy cảm.

- Kỳ vọng lưu giữ và ghi nhật ký cho các công cụ suy luận cục bộ. Điều này không cần quá nặng nề. Nó cần phải rõ ràng.

Chu vi đang chuyển dịch trở lại thiết bị

Trong một thập kỷ, chúng ta đã chuyển các điều khiển bảo mật "lên" đám mây. Suy luận cục bộ đang kéo một phần có ý nghĩa của hoạt động AI "xuống" thiết bị đầu cuối.

5 tín hiệu Shadow AI đã chuyển sang thiết bị đầu cuối:

- Hiện vật mô hình lớn: Tiêu thụ lưu trữ không thể giải thích được bởi các tệp .gguf hoặc .pt.

- Máy chủ suy luận cục bộ: Các quy trình đang nghe trên các cổng như 11434 (Ollama).

- Mô hình sử dụng GPU: Các đỉnh sử dụng GPU trong khi ngoại tuyến hoặc ngắt kết nối khỏi VPN.

- Thiếu hàng tồn kho mô hình: Không thể ánh xạ đầu ra mã đến các phiên bản mô hình cụ thể.

- Sự mơ hồ về giấy phép: Sự hiện diện của trọng số mô hình "phi thương mại" trong các bản dựng sản xuất.

Shadow AI 2.0 không phải là một tương lai giả định, nó là một hệ quả có thể dự đoán của phần cứng nhanh, phân phối dễ dàng và nhu cầu của nhà phát triển. Các CISO chỉ tập trung vào các điều khiển mạng sẽ bỏ lỡ những gì đang xảy ra trên tấm silicon ngay trên bàn của nhân viên.

Giai đoạn tiếp theo của quản trị AI ít hơn về việc chặn trang web và nhiều hơn về việc kiểm soát các hiện vật, nguồn gốc và chính sách tại thiết bị đầu cuối, mà không giết chết năng suất.

Jayachander Reddy Kandakatla là một kỹ sư MLOps cấp cao.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

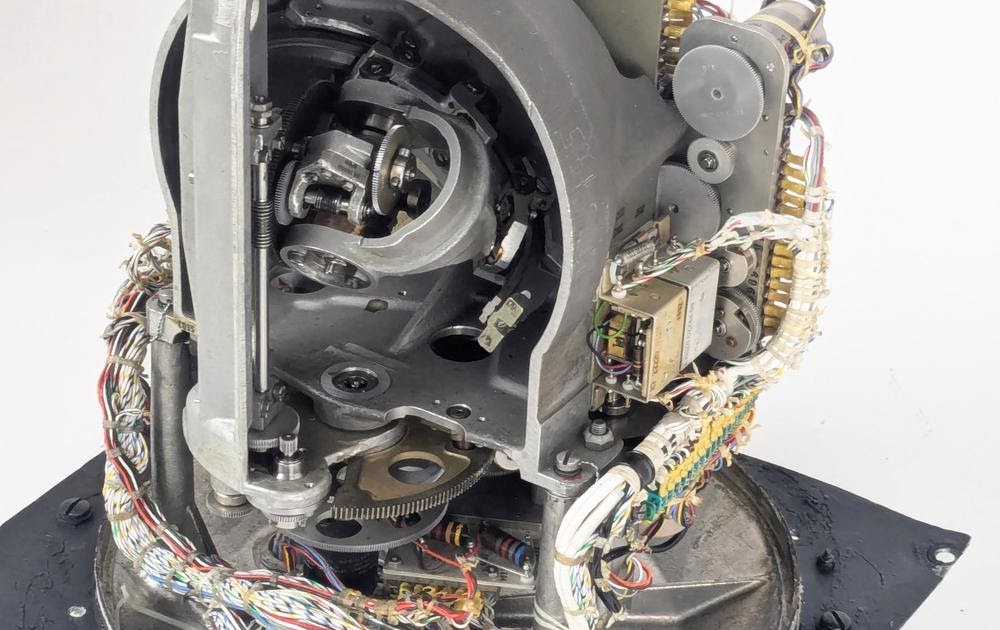

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026