Thỏa thuận 21 tỷ USD giữa Anthropic, Google và Broadcom tạo bước ngoặt hạ tầng AI

Anthropic ký hợp đồng trị giá khoảng 21 tỷ USD với Google và Broadcom để trang bị hơn 1 triệu chip TPU Ironwood, đạt công suất 1GW vào cuối 2026 và mở rộng lên 3,5GW vào năm 2027. Chiến lược đa đám mây cùng hiệu quả năng lượng vượt trội giúp Anthropic củng cố vị thế trong cuộc đua AI.

Thỏa thuận 21 tỷ USD giữa Anthropic, Google và Broadcom tạo bước ngoặt hạ tầng AI

Anthropic vừa công bố hợp đồng đầu tư khổng lồ trị giá khoảng 21 tỷ USD thông qua quan hệ đối tác với Google và Broadcom. Thỏa thuận này nhằm trang bị hơn 1 triệu chip TPU Ironwood, nhằm đáp ứng nhu cầu xử lý AI khổng lồ, với công suất tính toán vượt 1GW vào cuối năm 2026 và dự kiến mở rộng lên 3,5GW vào năm 2027.

Đây là bước đi chiến lược không chỉ giúp Anthropic đảm bảo hạ tầng để duy trì tốc độ tăng trưởng doanh thu từ 9 tỷ lên 30 tỷ USD chỉ trong 3 tháng, mà còn thể hiện mô hình triển khai đa đám mây với sự kết hợp giữa AWS Trainium, Google TPU và Nvidia GPU, giảm thiểu rủi ro phụ thuộc vào một nhà cung cấp duy nhất.

Hiệu quả năng lượng và lợi thế kỹ thuật của TPU Ironwood

Bảng so sánh kỹ thuật cho thấy chip Google TPU Ironwood có hiệu suất tính toán nổi bật với 52% hiệu quả năng lượng vượt trội so với các GPU Nvidia B200/GB300 (5.42 TFLOPS/W so với 3.57 TFLOPS/W). Điều này mang lại lợi thế quan trọng:

- Tối ưu chi phí vận hành dữ liệu lớn khi điện năng và làm mát chiếm tỷ lệ cao trong tổng chi phí

- Giảm quy mô và số lượng trung tâm dữ liệu cần thiết, từ đó tối ưu độ trễ phục vụ người dùng

- Khả năng mở rộng quy mô cụm lớn hơn đáng kể, hỗ trợ trực tiếp cho các mô hình AI quy mô lớn với hơn 9.000 chip trên một cụm, so với tối đa 72 GPU trên một cụm Nvidia NVLink

Kiến trúc này giúp giảm số lần trao đổi dữ liệu qua các chip, tối ưu đồng bộ gradient và tăng hiệu quả sử dụng phần cứng, đồng nghĩa giá thành suy luận trên mỗi token giảm đáng kể.

Chiến lược đa đám mây và giảm thiểu rủi ro

Anthropic không chỉ tin tưởng vào một nhà cung cấp mà sử dụng kết hợp:

- AWS Trainium: chip tùy chỉnh của Amazon, là đối tác đám mây chính

- Google TPU Ironwood: cung cấp khả năng xử lý lớn

- Nvidia GPU: duy trì cho các nhu cầu đặc thù

Chiến lược này giúp phân tán rủi ro, tránh phụ thuộc tuyệt đối, ví dụ như sự cố chuỗi cung ứng chip từ TSMC trong năm 2022 đã ảnh hưởng nghiêm trọng đến khách hàng chỉ dùng một nhà cung cấp, trong khi đa đám mây giúp giảm tác động xuống mức có thể kiểm soát.

Vai trò mới của Broadcom

Broadcom không còn đơn thuần là nhà sản xuất chip theo đơn đặt hàng mà chuyển sang vai trò tích hợp hệ thống toàn diện. Họ sẽ sản xuất, lắp ráp và giao hệ thống Ironwood hoàn chỉnh đến tận tay Anthropic, giúp rút ngắn thời gian triển khai và giảm phức tạp vận hành cho khách hàng.

Đây cũng là chiến lược giúp Broadcom đa dạng hóa nguồn thu và tăng sức mạnh định giá trong chuỗi cung ứng hạ tầng AI.

Tác động đến người dùng API và nhà phát triển hạ tầng

Với người dùng API Claude, thỏa thuận giúp:

- Giảm độ trễ và lỗi timeout nhờ công suất lớn hơn

- Duy trì ổn định giá dịch vụ nhờ hiệu quả năng lượng cao

- Tăng độ tin cậy nhờ mô hình đa đám mây hạn chế sự cố toàn hệ thống

Đối với các CTO và quản lý hạ tầng, bài học quan trọng là không nên phụ thuộc duy nhất vào Nvidia hoặc một nhà cung cấp. Hiệu quả năng lượng, khả năng mở rộng cụm, và tổng chi phí sở hữu (TCO) mới là những tiêu chí quyết định.

Nvidia có bị ảnh hưởng?

Nvidia vẫn giữ vị thế mạnh nhờ hệ sinh thái CUDA rộng lớn và phần mềm hỗ trợ phát triển AI. Tuy nhiên, sự xuất hiện của TPU trên quy mô lớn cho thấy xu hướng đa dạng phần cứng đang diễn ra, tạo ra cuộc cạnh tranh công bằng hơn và lựa chọn tối ưu cho từng loại workload.

Anthropic lựa chọn TPU cho đào tạo và suy luận lớn, đồng thời vẫn dùng GPU Nvidia cho những trường hợp cần thiết, thể hiện cách tiếp cận thực dụng thay vì phân cực.

Câu hỏi thường gặp

-

Tại sao không dùng AWS Trainium cho mọi tác vụ?

AWS là nền tảng chính, nhưng TPU vượt trội về hiệu quả năng lượng và khả năng mở rộng cụm. -

Giá API Claude có giảm không?

Chưa hẳn ngay lập tức vì chi phí hạ tầng chủ yếu ảnh hưởng tới lợi nhuận, nhưng chất lượng dịch vụ sẽ được cải thiện. -

3,5GW điện cho hạ tầng có thực tế không?

Con số này chiếm khoảng 5% tổng công suất trung tâm dữ liệu tại Mỹ, khá tham vọng nhưng khả thi với Anthropic quy mô lớn. -

Mô hình mở nguồn có hưởng lợi gì?

Gián tiếp có lợi khi tăng tính cạnh tranh, đa dạng phần cứng và giảm phụ thuộc Nvidia cho toàn bộ hệ sinh thái AI.

Thỏa thuận đầu tư khổng lồ này không chỉ là câu chuyện về tiền bạc mà đang định hình lại cách các công ty AI lớn xây dựng và vận hành hạ tầng. Với các doanh nghiệp công nghệ Việt Nam đang bắt đầu chú trọng AI, đây cũng là tín hiệu quan trọng về xu hướng và lựa chọn công nghệ nên cân nhắc trong tương lai gần.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

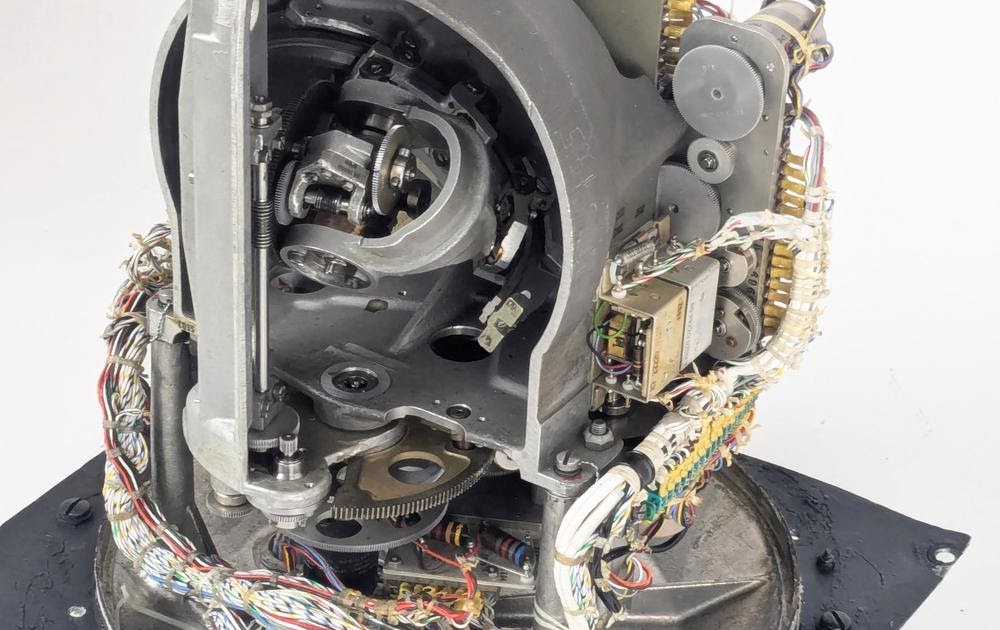

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026