TurboQuant của Google: Thuật toán nén mới giúp chạy LLM trên phần cứng khiêm tốn hơn mà vẫn giữ nguyên độ chính xác

Google Research giới thiệu TurboQuant, thuật toán lượng tử hóa mới giúp nén bộ nhớ đệm Key-Value (KV cache) của các mô hình ngôn ngữ lớn (LLM) lên đến 6 lần. Với khả năng nén xuống mức 3.5-bit mà không gây mất mát đáng kể về độ chính xác và không cần huấn luyện lại, công nghệ này cho phép triển khai các cửa sổ ngữ cảnh khổng lồ trên phần cứng khiêm tốn hơn nhiều so với trước đây.

Google Research vừa công bố TurboQuant, một thuật toán lượng tử hóa (quantization) đột phá giúp giải quyết vấn đề bộ nhớ khi chạy các mô hình ngôn ngữ lớn (LLM). Công nghệ này có khả năng nén bộ nhớ đệm Key-Value (KV cache) – một thành phần tiêu tốn nhiều tài nguyên nhất trong quá trình suy luận (inference) – xuống mức 3.5-bit mà vẫn giữ nguyên độ chính xác gần như tuyệt đối so với độ chính xác 16-bit ban đầu.

Thách thức về bộ nhớ trong LLM

Một trong những tối ưu hóa quan trọng nhất trong suy luận LLM là bộ nhớ đệm KV. Trong quá trình tạo văn bản tự động (autoregressive generation), mỗi token mới được tạo ra đều phụ thuộc vào dữ liệu của tất cả các token trước đó. Việc lưu trữ các tensor Key và Value giúp hệ thống tránh phải tính toán lại toàn bộ lịch sử chuỗi, nhưng cái giá phải trả là bộ nhớ VRAM tăng lên tuyến tính theo độ dài của chuỗi.

Ví dụ, để chạy mô hình Llama 70B với cửa sổ ngữ cảnh 1 triệu token, bộ nhớ VRAM cần thiết chỉ cho riêng KV cache là khoảng 328GB. Con số này lớn hơn nhiều so với 140GB cần thiết để lưu trữ trọng số mô hình. Đây là rào cản lớn buộc các kỹ sư phải sử dụng cấu hình đa GPU đắt đỏ. TurboQuant hứa hẹn giải quyết vấn đề này bằng cách giảm dung lượng cache xuống còn khoảng 72GB, vừa vặn với một GPU H100 80GB duy nhất.

Cơ chế hoạt động của TurboQuant

Khó khăn lớn nhất của việc lượng tử hóa KV cache là sự phân bố giá trị không đồng đều. Một số ít token đầu vào tạo ra các vector KV có độ lớn hàng trăm hoặc hàng nghìn, trong khi phần lớn các token khác có giá trị gần bằng 0. Các giá trị ngoại lai (outliers) này làm cho việc lượng tử hóa tuyến tính 4-bit trở nên bất khả thi nếu không có các kỹ thuật chuyên sâu.

TurboQuant giải quyết vấn đề này bằng phương pháp tiếp cận hai bước:

- Biến đổi Hadamard ngẫu nhiên: Các vector dữ liệu được xoay (rotate) để giữ lại các tính chất Euclide quan trọng như khoảng cách, đồng thời làm lan tỏa các giá trị. Quá trình này loại bỏ sự phân phối tọa độ nặng về các điểm ngoại lai, khiến các tọa độ vector tuân theo phân phối beta dễ nén hơn.

- Biến đổi Quantized Johnson-Lindenstrauss (QJL): Một kỹ thuật cũ được áp dụng để loại bỏ độ lệch (bias) tạo ra ở bước đầu tiên. Theo bài báo, tích vô hướng giữa các vector đã lượng tử hóa sau bước này là các ước tính không thiên lệch, hiệu quả về tính toán và chính xác của các vector chưa lượng tử hóa.

Hiệu năng và phản hồi từ cộng đồng

Trên các tiêu chuẩn benchmark như LongBench và Needle in a Haystack, bản triển khai TurboQuant 3.5-bit đã khớp hoàn toàn với hiệu suất của độ chính xác đầy đủ 16-bit trên các mô hình Gemma và Mistral. Điểm cộng lớn là thuật toán này không yêu cầu huấn luyện lại (retraining) mô hình.

Tuy nhiên, các phân tích từ cộng đồng kỹ thuật, như kênh Two Minute Papers, cho rằng dù trong lý thuyết mức nén có thể lên tới 6 lần, nhưng trong thực tế, mức cải thiện về giảm bộ nhớ và tốc độ xử lý sẽ khoảng 30-40%.

"Dựa trên kết quả, chúng ta không thể kết luận rằng mọi máy tính AI đột nhiên cần ít RAM hơn 6 lần. Không. Điều đó hơi lý tưởng hóa và chỉ đúng với một số trường hợp cụ thể. [...] Nhưng nó vẫn rất tốt. Nó giúp hầu hết những người chạy hệ thống AI với ngữ cảnh rất dài có thể làm điều đó rẻ hơn, với bộ nhớ ít hơn đáng kể."

Dù hiệu quả thực tế có thể khiêm tốn hơn con số lý thuyết, TurboQuant vẫn là một bước tiến quan trọng. Nó mở ra cơ hội cho các nhà phát triển chạy các tác vụ AI yêu cầu ngữ cảnh dài như phân tích tài liệu PDF khổng lồ, mã nguồn hoặc video trên phần cứng phổ thông hơn, thay vì phụ thuộc vào các hệ thống siêu máy tính đắt đỏ.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

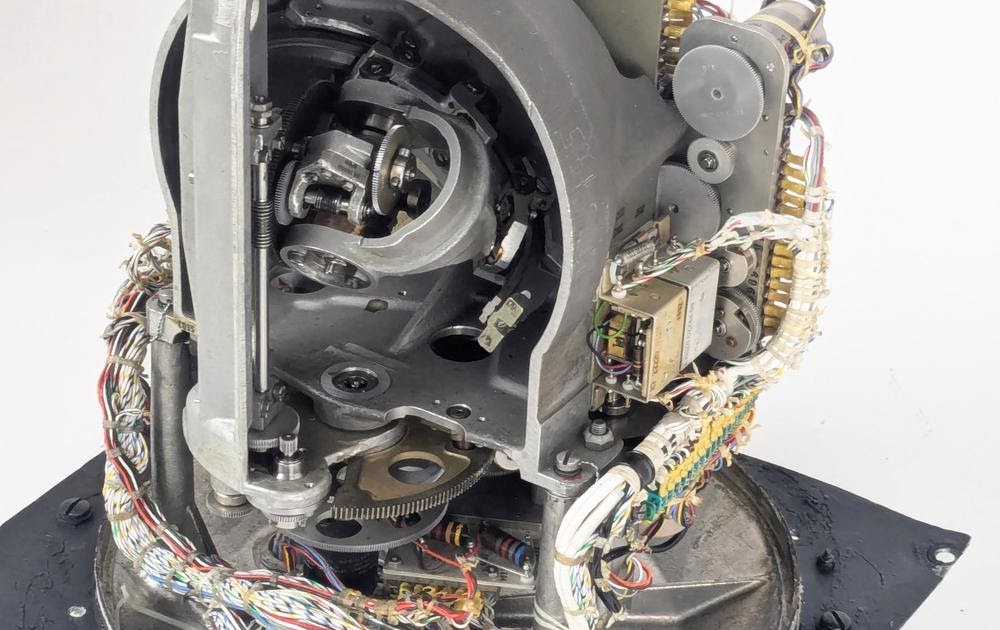

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026