Agent-skills-eval: Công cụ kiểm thử đánh giá hiệu quả thực tế của Agent Skills

Agent-skills-eval là framework kiểm thử giúp các nhà phát triển xác định liệu việc bổ sung kỹ năng (skills) vào AI Agent có thực sự cải thiện chất lượng đầu ra hay không thông qua việc so sánh và đánh giá tự động.

Trong lĩnh vực phát triển AI, việc cung cấp kiến thức chuyên môn cho các tác nhân (agents) thông qua tiêu chuẩn Agent Skills của Anthropic đang ngày càng phổ biến. Tuy nhiên, một câu hỏi lớn đặt ra là: Làm sao để biết liệu việc thêm một tệp SKILL.md vào ngữ cảnh có thực sự giúp mô hình hoạt động tốt hơn hay không?

Công cụ agent-skills-eval ra đời để giải quyết vấn đề này một cách khoa học và thực nghiệm.

Agent Skills Eval Interface

Agent Skills Eval Interface

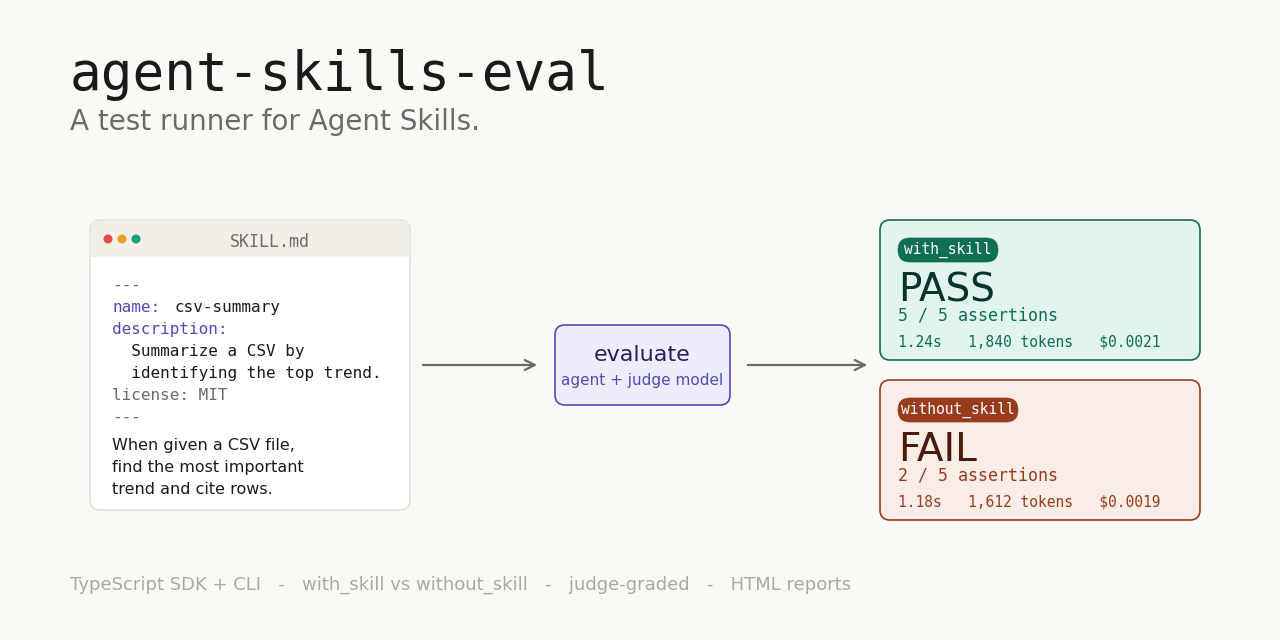

Cơ chế hoạt động: So sánh và Đánh giá

Thay vì dựa vào cảm tính, agent-skills-eval hoạt động bằng cách chạy cùng một prompt hai lần:

- with_skill: Chạy với tệp SKILL.md được tải vào ngữ cảnh.

- without_skill: Chạy ở trạng thái cơ bản (baseline) mà không có kỹ năng.

Sau đó, một "mô hình phán xét" (judge model) sẽ chấm điểm cả hai đầu ra dựa trên các khẳng định (assertions) được định nghĩa trước. Kết quả là một báo cáo so sánh trực quan, cho thấy rõ ràng kỹ năng đó có tạo ra sự khác biệt đo lường được hay không.

Các tính năng nổi bật

Công cụ này được thiết kế để tích hợp sâu vào quy trình phát triển phần mềm hiện đại với các tính năng chính:

- Báo cáo HTML tĩnh: Tạo ra các báo cáo trực quan có thể xuất bản bất cứ đâu mà không cần hạ tầng phức tạp.

- Tương thích rộng rãi: Hoạt động với bất kỳ mô hình trò chuyện nào sử dụng API tương thích OpenAI (bao gồm OpenAI, Anthropic, Groq, Together, hoặc các máy chủ Llama cục bộ).

- SDK TypeScript và CLI: Hỗ trợ cả dòng lệnh nhanh cho CI/CD và SDK đầy đủ cho các pipeline tùy chỉnh.

- Kiểm tra gọi công cụ (Tool-call assertions): Hỗ trợ kiểm tra xác định cho các tác nhân sử dụng công cụ, không chỉ tạo văn bản.

Cách sử dụng nhanh

Để bắt đầu, người dùng có thể cài đặt qua npm:

NPM Version

npm install agent-skills-eval

Hoặc chạy trực tiếp bằng lệnh sau để kiểm tra một thư mục kỹ năng:

npx agent-skills-eval ./skills \

--target gpt-4o-mini \

--judge gpt-4o-mini \

--baseline \

--strict

Công cụ sẽ tạo ra một không gian làm việc chứa các dữ liệu chi tiết và báo cáo HTML, giúp nhà phát triển có câu trả lời bằng chứng xác thực cho câu hỏi: "Kỹ năng của tôi có hoạt động không?".

Agent-skills-eval hiện là mã nguồn mở theo giấy phép MIT, sẵn sàng cho cộng đồng AI và các nhà phát triển phần mềm khám phá và đóng góp.

Bài viết liên quan

Phần mềm

Lo ngại về Bun: Liệu sự suy giảm của Claude Code có phải là điềm báo cho tương lai của runtime này?

04 tháng 5, 2026

Công nghệ

Nhà xuất bản cáo buộc Mark Zuckerberg cá nhân chỉ đạo vi phạm bản quyền để đào tạo AI Llama

05 tháng 5, 2026

Phần mềm

Bun công bố hướng dẫn chuyển đổi sang Rust, nhưng gọi dự án viết lại là "chưa chín muồi"

05 tháng 5, 2026