Cloudflare giới thiệu nền tảng AI mới: Lớp truy luận thống nhất dành cho các tác nhân AI

Cloudflare đã biến nền tảng của mình thành một lớp truy luận (inference layer) thống nhất, cho phép các nhà phát triển truy cập hơn 70 mô hình từ hơn 12 nhà cung cấp thông qua một API duy nhất. Tính năng này giúp giảm độ trễ, quản lý chi phí tập trung và tăng độ tin cậy với khả năng chuyển đổi tự động, đặc biệt hữu ích cho việc xây dựng các ứng dụng AI phức tạp.

Các mô hình AI đang thay đổi chóng mặt. Mô hình tốt nhất để lập trình tác nhân (agentic coding) hôm nay có thể ba tháng tới lại là một mô hình hoàn toàn khác từ một nhà cung cấp khác. Hơn nữa, các trường hợp sử dụng thực tế thường yêu cầu gọi nhiều mô hình cùng lúc. Một tác nhân hỗ trợ khách hàng có thể dùng mô hình nhanh, rẻ để phân loại tin nhắn; một mô hình lớn để lập kế hoạch hành động; và một mô hình nhẹ để thực thi các nhiệm vụ cụ thể.

Điều này đồng nghĩa với việc bạn cần quyền truy cập vào tất cả các mô hình mà không bị ràng buộc về tài chính hay vận hành vào một nhà cung cấp duy nhất. Bạn cũng cần hệ thống phù hợp để giám sát chi phí, đảm bảo độ tin cậy khi một nhà cung cấp gặp sự cố và quản lý độ trễ bất kể người dùng của bạn ở đâu.

Những thách thức này luôn hiện hữu khi xây dựng ứng dụng AI, nhưng trở nên cấp bách hơn khi bạn xây dựng các tác nhân AI (agents). Một chatbot đơn giản có thể chỉ cần một lệnh gọi truy vấn cho mỗi lời nhắc của người dùng. Nhưng một tác nhân có thể phải xâu chuỗi mười lệnh gọi để hoàn thành một nhiệm vụ. Đột nhiên, một nhà cung cấp chậm chạp không chỉ làm chậm thêm 50ms mà là 500ms. Một yêu cầu thất bại không chỉ là việc phải thử lại, mà có thể gây ra hiệu ứng dây chuyền thất bại.

Kiến trúc nền tảng AI của Cloudflare

Kiến trúc nền tảng AI của Cloudflare

Một danh mục, một điểm cuối thống nhất

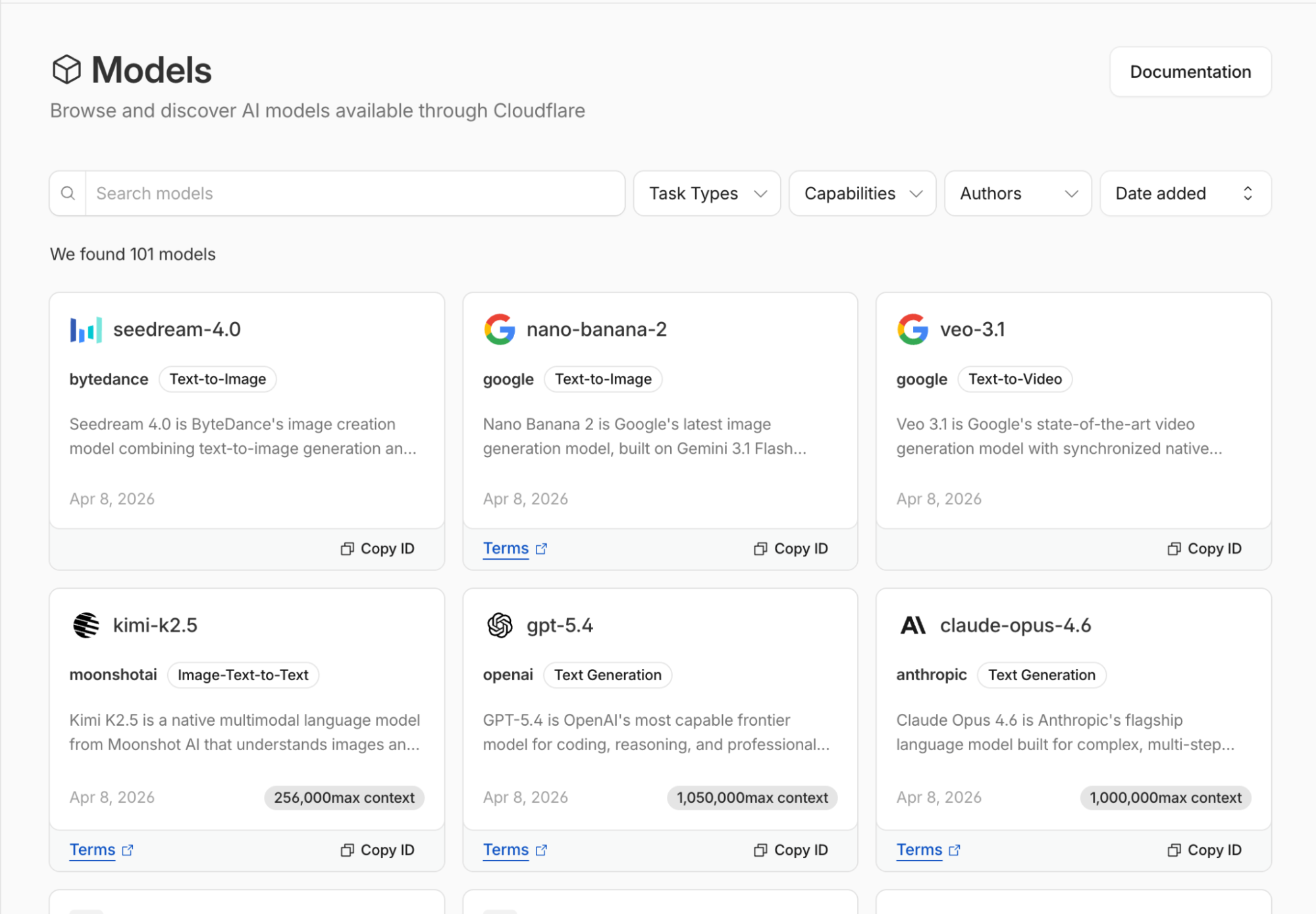

Kể từ hôm nay, bạn có thể gọi các mô hình bên thứ ba bằng cách sử dụng cùng một liên kết AI.run() mà bạn đã dùng cho Workers AI. Nếu bạn đang sử dụng Workers, việc chuyển đổi từ mô hình được lưu trữ bởi Cloudflare sang mô hình từ OpenAI, Anthropic hoặc bất kỳ nhà cung cấp nào khác chỉ là thay đổi một dòng code.

Đối với những người không sử dụng Workers, chúng tôi sẽ sớm hỗ trợ REST API, giúp bạn có thể truy cập toàn bộ danh mục mô hình từ bất kỳ môi trường nào.

Cloudflare hiện cung cấp quyền truy cập vào hơn 70 mô hình từ hơn 12 nhà cung cấp — tất cả thông qua một API, một dòng code để chuyển đổi giữa chúng và một gói tín dụng để thanh toán. Danh sách các nhà cung cấp bao gồm Alibaba Cloud, AssemblyAI, Bytedance, Google, InWorld, MiniMax, OpenAI, Pixverse, Recraft, Runway và Vidu. Đáng chú ý, chúng tôi đang mở rộng các mô hình để bao gồm cả hình ảnh, video và giọng nói, giúp bạn xây dựng các ứng dụng đa phương tiện (multimodal).

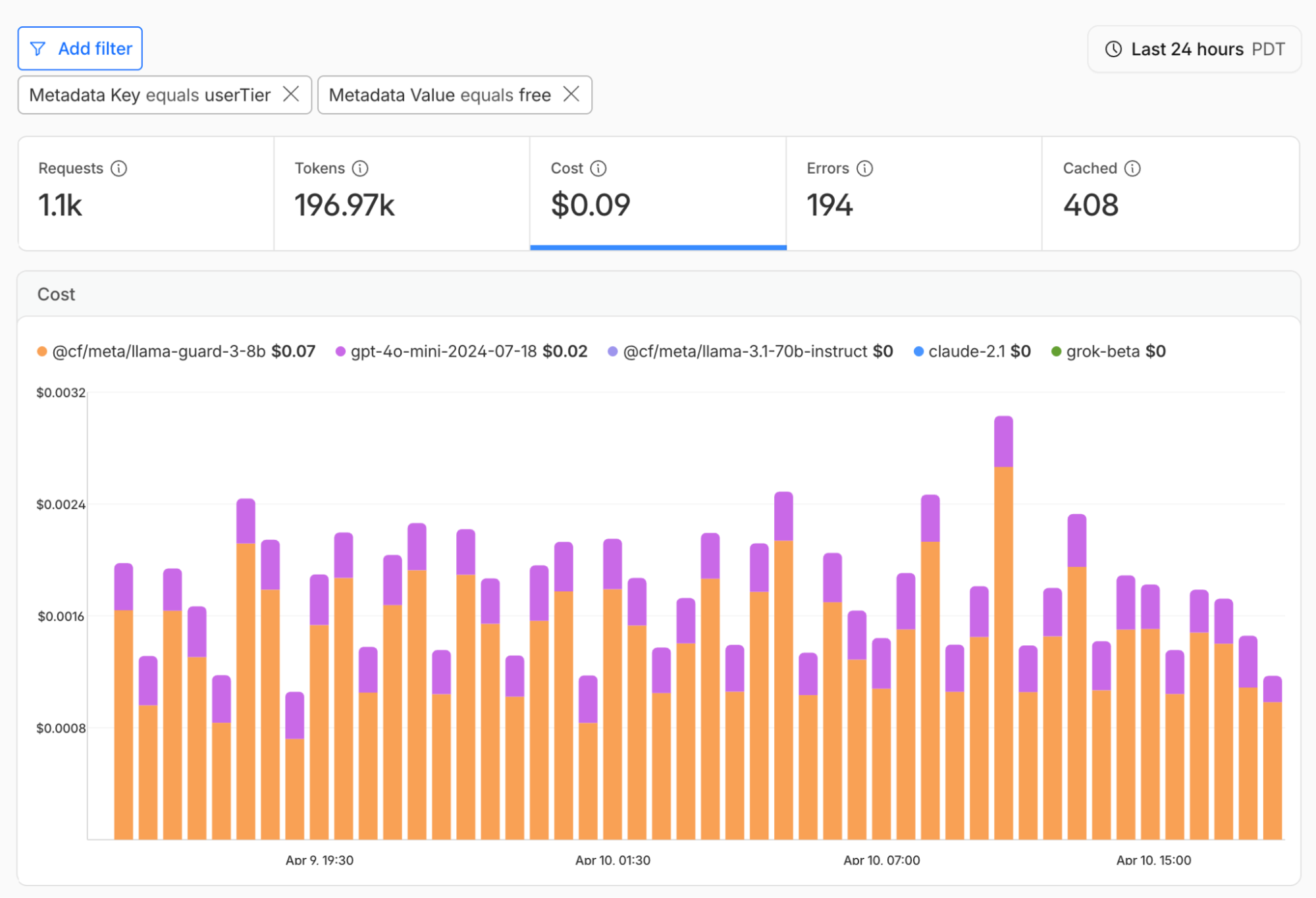

Truy cập tất cả các mô hình thông qua một API cũng có nghĩa là bạn có thể quản lý tất cả chi phí AI ở một nơi. Với AI Gateway, bạn sẽ có một nơi tập trung để giám sát và quản lý chi tiêu AI. Bằng cách bao gồm siêu dữ liệu tùy chỉnh với các yêu cầu của mình, bạn có thể phân tích chi phí theo các thuộc tính quan trọng nhất, như chi phí theo người dùng miễn phí so với người dùng trả phí, theo từng khách hàng cụ thể hoặc theo quy trình làm việc trong ứng dụng.

Tự mang mô hình của bạn (Bring Your Own Model)

AI Gateway cho phép bạn truy cập các mô hình từ tất cả các nhà cung cấp thông qua một API. Tuy nhiên, đôi khi bạn cần chạy một mô hình đã được tinh chỉnh (fine-tune) trên dữ liệu riêng của mình hoặc được tối ưu hóa cho trường hợp sử dụng cụ thể của bạn. Vì vậy, chúng tôi đang phát triển tính năng cho phép người dùng mang mô hình của riêng họ đến Workers AI.

Để làm điều này, chúng tôi tận dụng công nghệ Cog của Replicate để giúp bạn đóng gói (containerize) các mô hình học máy. Cog được thiết kế rất đơn giản: tất cả những gì bạn cần làm là ghi lại các phần phụ thuộc trong tệp cog.yaml và mã truy vấn của bạn trong tệp Python. Cog trừu tượng hóa tất cả các khó khăn trong việc đóng gói mô hình ML, chẳng hạn như các phần phụ thuộc CUDA, phiên bản Python, tải trọng (weights), v.v.

Quy trình đóng gói mô hình với Cog

Quy trình đóng gói mô hình với Cog

Sau đó, bạn có thể chạy cog build để xây dựng hình ảnh container của mình và đẩy container Cog đó đến Workers AI. Chúng tôi sẽ triển khai và phục vụ mô hình đó cho bạn, sau đó bạn truy cập thông qua các API Workers AI thông thường.

Tối ưu hóa tốc độ và độ tin cậy

Việc sử dụng các mô hình Workers AI với AI Gateway đặc biệt mạnh mẽ nếu bạn đang xây dựng các tác nhân trực tiếp (live agents) — nơi nhận thức của người dùng về tốc độ phụ thuộc vào thời gian nhận token đầu tiên (time to first token). Ngay cả khi tổng thời gian truy vấn là 3 giây, việc nhận được token đầu tiên nhanh hơn 50ms sẽ tạo ra sự khác biệt lớn giữa một tác nhân nhanh nhẹn và một tác nhân chậm chạp.

Mạng lưới trung tâm dữ liệu của Cloudflare tại 330 thành phố trên toàn thế giới có nghĩa là AI Gateway được định vị gần cả người dùng và các điểm cuối truy vấn, giúp giảm thiểu thời gian mạng trước khi truyền phát bắt đầu.

Mạng lưới toàn cầu của Cloudflare giúp giảm độ trễ

Mạng lưới toàn cầu của Cloudflare giúp giảm độ trễ

Độ tin cậy cũng quan trọng không kém tốc độ. Mọi bước trong quy trình làm việc của tác nhân đều phụ thuộc vào các bước trước đó. Thông qua AI Gateway, nếu bạn gọi một mô hình có sẵn trên nhiều nhà cung cấp và một nhà cung cấp bị sự cố, chúng tôi sẽ tự động định tuyến sang nhà cung cấp khả dụng khác mà bạn không cần viết bất kỳ logic xử lý sự cố nào.

Nếu bạn đang xây dựng các tác nhân chạy lâu với Agents SDK, các lệnh gọi truy vấn truyền phát của bạn cũng có khả năng phục hồi khi bị ngắt kết nối. AI Gateway sẽ lưu bộ nhớ đệm các phản hồi truyền phát khi chúng được tạo ra, độc lập với vòng đời của tác nhân của bạn. Nếu tác nhân của bạn bị gián đoạn giữa chừng, nó có thể kết nối lại với AI Gateway và truy xuất phản hồi mà không cần thực hiện lệnh gọi truy vấn mới hay trả tiền hai lần cho cùng một token đầu ra.

Sự hợp tác với Replicate

Đội ngũ Replicate đã chính thức gia nhập nhóm Nền tảng AI của Cloudflare. Chúng tôi đã nỗ lực tích hợp giữa Replicate và Cloudflare, bao gồm việc đưa tất cả các mô hình Replicate lên AI Gateway và chuyển đổi các mô hình được lưu trữ sang cơ sở hạ tầng của Cloudflare. Trong tương lai gần, bạn sẽ có thể truy cập các mô hình bạn yêu thích trên Replicate thông qua AI Gateway và lưu trữ các mô hình bạn đã triển khai trên Replicate trên Workers AI.

Để bắt đầu, hãy xem tài liệu về AI Gateway hoặc Workers AI để tìm hiểu thêm về cách xây dựng các tác nhân trên Cloudflare thông qua Agents SDK.

Bài viết liên quan

Công nghệ

George Orwell đã tiên đoán sự trỗi dậy của "rác thải AI" trong tác phẩm 1984

16 tháng 4, 2026

Phần mềm

Anthropic ra mắt Claude Opus 4.7: Nâng cấp mạnh mẽ cho lập trình nhưng vẫn thua Mythos Preview

16 tháng 4, 2026

Công nghệ

Qwen3.6-35B-A3B: Quyền năng Lập trình Agentic, Nay Đã Mở Cửa Cho Tất Cả

16 tháng 4, 2026