Google giới thiệu Agentic Data Cloud: Tái định hình kiến trúc dữ liệu cho kỷ nguyên AI tác nhân

Các ngăn xếp dữ liệu doanh nghiệp truyền thống đang gặp khó khăn trước sự bùng nổ của các tác nhân AI hoạt động tự động. Google đã công bố giải pháp Agentic Data Cloud tại sự kiện Cloud Next, bao gồm ba trụ cột chính là Knowledge Catalog, Cross-cloud lakehouse và Data Agent Kit để chuyển đổi từ quy mô con người sang quy mô tác nhân.

Google giới thiệu Agentic Data Cloud: Tái định hình kiến trúc dữ liệu cho kỷ nguyên AI tác nhân

Các ngăn xếp dữ liệu doanh nghiệp trước đây được xây dựng dành cho con người thực hiện các truy vấn theo lịch trình. Tuy nhiên, khi các tác nhân AI ngày càng hoạt động tự chủ thay mặt doanh nghiệp liên tục 24/7, kiến trúc này đang bắt đầu bị phá vỡ. Các nhà cung cấp đang chạy đua để tái thiết kế nó, và câu trả lời của Google được công bố tại sự kiện Cloud Next vào thứ Tư vừa qua là Agentic Data Cloud.

Kiến trúc mới này bao gồm ba trụ cột chính:

- Knowledge Catalog: Tự động hóa việc quản lý siêu dữ liệu ngữ nghĩa, suy luận logic kinh doanh từ nhật ký truy vấn mà không cần sự can thiệp thủ công của người quản lý dữ liệu.

- Cross-cloud lakehouse: Cho phép BigQuery truy vấn các bảng Iceberg trên AWS S3 thông qua mạng riêng tư mà không mất phí thoát dữ liệu (egress fees).

- Data Agent Kit: Tích hợp các công cụ MCP vào VS Code, Claude Code và Gemini CLI để các kỹ sư dữ liệu có thể mô tả kết quả mong muốn thay vì viết các pipeline phức tạp.

"Kiến trúc dữ liệu cần phải thay đổi ngay bây giờ," Andi Gutmans, Phó Chủ tịch và Tổng Giám đốc của Data Cloud tại Google Cloud, chia sẻ với VentureBeat. "Chúng ta đang chuyển đổi từ quy mô con người sang quy mô tác nhân."

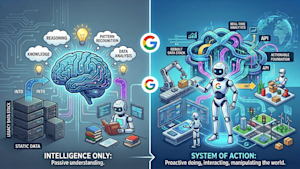

Từ hệ thống thông minh đến hệ thống hành động

Tiền đề cốt lõi đằng sau Agentic Data Cloud là các doanh nghiệp đang chuyển dịch từ hoạt động ở quy mô con người sang quy mô tác nhân.

Về mặt lịch sử, các nền tảng dữ liệu được tối ưu hóa cho báo cáo, bảng điều khiển (dashboard) và một số dự báo — những gì Google gọi là "trí tuệ phản ứng". Trong mô hình đó, con người sẽ diễn giải dữ liệu và quyết định hành động tiếp theo.

Bây giờ, khi các tác nhân AI ngày càng được kỳ vọng sẽ thực hiện hành động trực tiếp thay mặt cho doanh nghiệp, ông Gutmans lập luận rằng các nền tảng dữ liệu phải tiến hóa thành các hệ thống hành động.

"Chúng ta cần đảm bảo rằng tất cả dữ liệu doanh nghiệp có thể được kích hoạt bởi AI, bao gồm cả dữ liệu có cấu trúc và phi cấu trúc," ông Gutmans nói. "Chúng ta cần đảm bảo có mức độ tin cậy phù hợp, điều này có nghĩa là không chỉ là truy cập dữ liệu, mà thực sự phải hiểu về dữ liệu."

Knowledge Catalog là câu trả lời của Google cho vấn đề này. Đây là sự tiến hóa của Dataplex — sản phẩm quản trị dữ liệu hiện có của Google — với một kiến trúc nền tảng hoàn toàn khác biệt. Trong khi các danh mục dữ liệu truyền thống yêu cầu người quản lý dữ liệu phải gán nhãn thủ công các bảng, định nghĩa các thuật ngữ kinh doanh và xây dựng bảng chú giải, thì Knowledge Catalog tự động hóa quy trình này bằng cách sử dụng các tác nhân.

Tác động thực tế đối với các nhóm kỹ sư dữ liệu là Knowledge Catalog có thể mở rộng quy mô cho toàn bộ tài sản dữ liệu, không chỉ là tập hợp con được quản lý thủ công mà một nhóm nhỏ có thể duy trì. Danh mục này hỗ trợ nguyên bản BigQuery, Spanner, AlloyDB và Cloud SQL, đồng thời liên kết với các danh mục bên thứ ba như Collibra, Atlan và Datahub. Liên kết sao chép zero (zero-copy federation) mở rộng ngữ nghĩa ngữ cảnh từ các ứng dụng SaaS bao gồm SAP, Salesforce Data360, ServiceNow và Workday mà không yêu cầu di chuyển dữ liệu.

Lakehouse của Google mở rộng sang đa đám mây

Google đã có một lakehouse dữ liệu gọi là BigLake từ năm 2022. Ban đầu, nó bị giới hạn chỉ ở dữ liệu của Google, nhưng trong những năm gần đây đã có một số khả năng liên kết hạn chế cho phép doanh nghiệp truy vấn dữ liệu ở các vị trí khác.

Ông Gutmans giải thích rằng phương thức liên kết trước đây hoạt động thông qua các API truy vấn, điều này làm hạn chế các tính năng và tối ưu hóa mà BigQuery có thể áp dụng cho dữ liệu bên ngoài. Cách tiếp cận mới là chia sẻ dựa trên lưu trữ thông qua định dạng mở Apache Iceberg. Điều này có nghĩa là dù dữ liệu nằm trên Amazon S3 hay Google Cloud, về cơ bản không tạo ra sự khác biệt.

"Điều này thực sự có nghĩa là chúng ta có thể mang lại tất cả những tính năng tuyệt vời và khả năng AI cho các tập dữ liệu bên thứ ba đó," ông nói.

Kết quả thực tế là BigQuery có thể truy vấn các bảng Iceberg nằm trên Amazon S3 thông qua Cross-Cloud Interconnect của Google — một lớp mạng riêng chuyên dụng — mà không mất phí thoát dữ liệu và hiệu suất giá cả mà Google khẳng định là tương đương với các kho dữ liệu gốc của AWS. Tất cả các hàm AI của BigQuery đều chạy trên dữ liệu đa đám mây này mà không cần sửa đổi. Liên kết hai chiều trong bản xem trước mở rộng sang Databricks Unity Catalog trên S3, Snowflake Polaris và AWS Glue Data Catalog bằng cách sử dụng tiêu chuẩn mở Iceberg REST Catalog.

Từ viết pipeline đến mô tả kết quả

Knowledge Catalog và lakehouse đa đám mây giải quyết các vấn đề về quyền truy cập và ngữ cảnh dữ liệu. Trụ cột thứ ba giải quyết vấn đề xảy ra khi một kỹ sư dữ liệu thực sự ngồi xuống để xây dựng một cái gì đó với tất cả những thứ đó.

Data Agent Kit được cung cấp như một bộ kỹ năng di động, các công cụ MCP và tiện ích mở rộng IDE tích hợp vào VS Code, Claude Code, Gemini CLI và Codex. Nó không giới thiệu một giao diện mới.

Sự thay đổi kiến trúc mà nó cho phép là chuyển từ những gì ông Gutmans gọi là "trải nghiệm copilot mang tính quy định" sang kỹ thuật dựa trên ý định. Thay vì viết một pipeline Spark để di chuyển dữ liệu từ nguồn A đến đích B, kỹ sư dữ liệu sẽ mô tả kết quả mong muốn — một tập dữ liệu đã được làm sạch sẵn để huấn luyện mô hình, một phép biến đổi thực thi quy tắc quản trị — và tác nhân sẽ chọn xem có nên sử dụng BigQuery, Lightning Engine cho Apache Spark hay Spanner để thực thi, sau đó tạo ra mã sản xuất sẵn sàng.

"Khách hàng đang khá mệt mỏi với việc tự xây dựng các pipeline của họ," ông Gutmans nói. "Họ thực sự đang ở chế độ xem xét nhiều hơn là ở chế độ viết mã."

Sự khác biệt giữa Google và các đối thủ

Tiền đề cho rằng các tác nhân cần ngữ nghĩa ngữ cảnh, không chỉ là quyền truy cập dữ liệu, là điểm chung trên toàn thị trường. Databricks có Unity Catalog, cung cấp quản trị và lớp ngữ nghĩa trên lakehouse của họ. Snowflake có Cortex, sản phẩm AI và lớp ngữ nghĩa của họ. Microsoft Fabric bao gồm một lớp mô hình ngữ nghĩa được xây dựng cho thông tin kinh doanh và ngày càng nhiều hơn là nền tảng cho các tác nhân.

Tranh chấp không phải là liệu ngữ nghĩa có quan trọng hay không — mọi người đều đồng ý là có. Tranh chấp là về ai xây dựng và duy trì chúng.

"Mục tiêu của chúng tôi chỉ là lấy được tất cả ngữ nghĩa mà bạn có thể," ông giải thích, lưu ý rằng Google sẽ liên kết với các mô hình ngữ nghĩa bên thứ ba thay vì yêu cầu khách hàng bắt đầu lại từ đầu.

Google cũng định vị sự cởi mở là điểm khác biệt, với liên kết hai chiều vào Databricks Unity Catalog và Snowflake Polaris thông qua tiêu chuẩn mở Iceberg REST Catalog.

Điều này có nghĩa là gì đối với các doanh nghiệp

Lập luận của Google — và được phản ánh trên toàn thị trường cơ sở hạ tầng dữ liệu — là các doanh nghiệp đang tụt hậu trên ba mặt trận:

Ngữ nghĩa ngữ cảnh đang trở thành cơ sở hạ tầng. Nếu danh mục dữ liệu của bạn vẫn được quản lý thủ công, nó sẽ không mở rộng quy mô khối lượng công việc của tác nhân — và ông Gutmans lập luận rằng khoảng cách này sẽ chỉ rộng hơn khi khối lượng truy vấn của tác nhân tăng lên.

Chi phí thoát dữ liệu đa đám mây là một loại thuế ẩn đối với AI tác nhân. Liên kết dựa trên lưu trữ thông qua các tiêu chuẩn mở Iceberg đang nổi lên như câu trả lời kiến trúc trên Google, Databricks và Snowflake. Các doanh nghiệp bị mắc kẹt trong các phương thức liên kết độc quyền nên kiểm tra áp lực chi phí đó ở khối lượng truy vấn cấp độ tác nhân.

Ông Gutmans lập luận rằng kỷ nguyên viết pipeline đang kết thúc. Các kỹ sư dữ liệu chuyển sang điều phối dựa trên kết quả ngay bây giờ sẽ có lợi thế khởi đầu đáng kể.

Bài viết liên quan

Công nghệ

CEO Palantir: 10% thế giới "ghét chúng tôi một cách chuyên nghiệp"

05 tháng 5, 2026

Phần cứng

Nghiên cứu vạch trần Pearl Blockchain: 320.000 GPU "đào AI" nhưng không tạo ra bất kỳ tính toán hữu ích nào

05 tháng 6, 2026

Phần cứng

Lỗ hổng kernel macOS đầu tiên bị khai thác thành công trên chip Apple M5

14 tháng 5, 2026