Google muốn nhiều chip Intel hơn trong trung tâm dữ liệu, mở rộng hợp tác về SmartNIC

Google sẽ tiếp tục mua các thiết bị SmartNIC từ Intel cho đám mây công cộng thay vì tự phát triển như AWS. Doanh nghiệp ASIC tùy chỉnh của Intel hiện đang đạt tốc độ doanh thu ấn tượng 1 tỷ USD mỗi năm.

Google sẽ tiếp tục hợp tác với Intel, mua các thiết bị SmartNIC cho đám mây công cộng của mình thay vì tự mở đường như AWS đã làm với các dòng NIC Nitro.

Giống như hầu hết các siêu nhà cung cấp dịch vụ đám mây (hyperscalers) hiện nay, Google sử dụng SmartNIC, hay theo cách gọi của Intel là Đơn vị xử lý cơ sở hạ tầng (IPU). Các thiết bị này về cơ bản là một máy tính trên một thẻ mạng, được thiết kế để giảm tải các hoạt động mạng, bảo mật và lưu trữ, giúp giải phóng tài nguyên CPU cho khối lượng công việc của khách hàng.

Trong khi Amazon sử dụng các chip ASIC tùy chỉnh từ đội ngũ Annapurna Labs và Microsoft sử dụng logic tùy chỉnh chạy trên FPGA, Google đã chọn Intel để phát triển một IPU dựa trên ASIC có tên Mount Evans, ra mắt cùng với các phiên bản máy chủ C3 vào năm 2022.

Mở rộng hợp tác phát triển IPU

Vào thứ Năm, Intel đã thông báo rằng Google đã mở rộng sự hợp tác này để phát triển các IPU thế hệ tiếp theo. Trong cuộc gọi thu nhập quý IV của mình vào tháng 1, CFO David Zinsner của Intel đã ám chỉ về nhu cầu tăng đối với các dịch vụ này, khoe rằng doanh nghiệp ASIC tùy chỉnh của công ty đã tăng trưởng hơn 50% vào năm 2025 và kết thúc quý IV với tốc độ doanh thu hàng năm trên 1 tỷ USD.

Intel không nêu chi tiết về hình dạng của các IPU thế hệ tiếp theo của Google, nhưng xét đến nhu cầu về mạng tốc độ cao cho các cụm máy tính AI, có khả năng nó sẽ nhanh hơn đáng kể so với IPU Mount Evans 200 Gbps hiện tại.

Cùng với sự hợp tác mở rộng về IPU, Intel cũng rất muốn nhấn mạnh rằng Google không từ bỏ các bộ xử lý Xeon, sẽ tiếp tục cung cấp năng lượng cho nhiều khối lượng công việc chung và AI. Nói cách khác, mọi việc vẫn diễn ra như bình thường.

Vai trò của Xeon trong kỷ nguyên AI

Giống như nhiều siêu nhà cung cấp dịch vụ đám mây, Google hiện có CPU dựa trên Arm của riêng mình, mã danh Axion, chạy cả các khối lượng công việc nội bộ và hướng tới khách hàng.

Tuy nhiên, giống như Graviton và Cobalt đã thay thế bộ xử lý Xeon hoặc Epyc trong đám mây của Amazon hoặc Microsoft, cả Intel hay AMD đều không có nguy cơ bị Axion loại bỏ bất cứ lúc nào.

Trên thực tế, vì nhiều khách hàng thích chạy khối lượng công việc của họ trên nhân x86, vì lý do hiệu suất hoặc khả năng tương thích, Intel vẫn hữu ích trong việc tạo áp lực giá lên AMD và ngược lại.

Trong mọi trường hợp, Intel cảm thấy cần phải trấn an mọi người rằng Xeon vẫn là một phần quan trọng của Google Cloud, đặc biệt là khi nói đến AI. Xeon đã là CPU lựa chọn cho các thiết kế tham chiếu DGX 8-GPU của Nvidia kể từ H100 vào năm 2022. Nói cách khác, nhiều phiên bản GPU của Google đã có Intel bên trong.

Và trong khi khối lượng công việc AI cũng cần CPU để điều phối các tác nhân và thực thi mã được tạo ra bởi GPU và TPU của Google, không có gì khiến Xeon vốn dĩ tốt hơn cho công việc này so với Epyc hay Axion. Trên thực tế, ở quy mô đám mây, CPU tốt nhất cho AI tác nhân có lẽ là bất kỳ CPU nào đang rảnh rỗi tại thời điểm đó.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

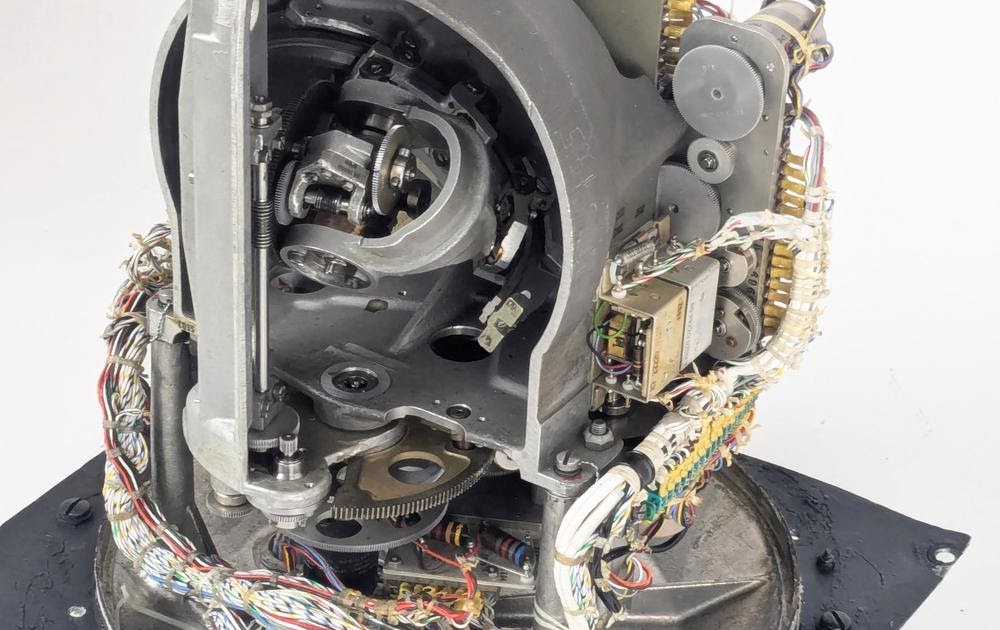

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026