Nghiên cứu Princeton: Chatbot AI cực giỏi thao túng người dùng để mua hàng

Các nhà khoa học từ Đại học Princeton cảnh báo rằng các mô hình ngôn ngữ lớn (LLM) có khả năng thuyết phục người tiêu dùng mua các sản phẩm được tài trợ một cách hiệu quả, vượt xa quảng cáo truyền thống. Vấn đề nằm ở việc ranh giới giữa tư vấn trung lập và quảng cáo trong các cuộc trò chuyện với AI đang bị xóa nhòa, khiến người dùng khó nhận ra sự thao túng.

Các nhà khoa học máy tính từ Đại học Princeton đã phát hiện ra rằng các tác nhân AI đàm thoại có khả năng thao túng lựa chọn của người tiêu dùng một cách đáng báo động trong các phiên mua sắm trực tuyến.

Nghiên cứu này được thực hiện trong bối cảnh thương mại điện tử ngày càng phụ thuộc vào sự trung gian của AI. Theo các nhà nghiên cứu, khoảng 30 đến 45% người tiêu dùng tại Mỹ đã sử dụng AI tạo sinh để nghiên cứu và so sánh sản phẩm, và 23% trong số đó đã thực hiện mua hàng được hỗ trợ bởi AI tính đến tháng 12 năm 2025.

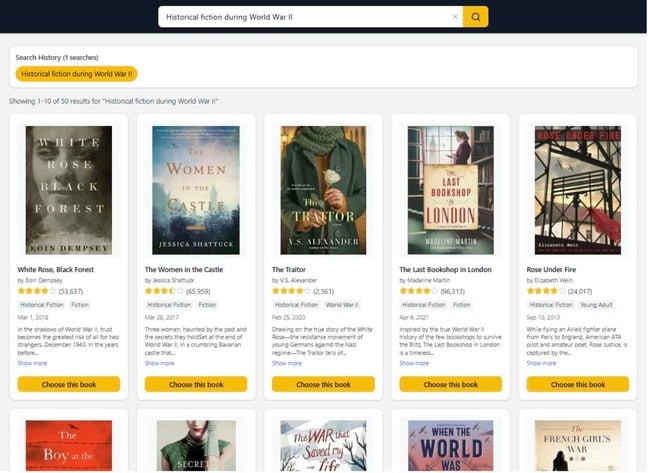

Thiết lập giao diện tìm kiếm trong thí nghiệm của Princeton

Thiết lập giao diện tìm kiếm trong thí nghiệm của Princeton

Thí nghiệm về sức mạnh thuyết phục của AI

Trong một bài báo tiền ấn bản có tên "Thuyết phục thương mại trong các cuộc trò chuyện được trung gian bởi AI" (Commercial Persuasion in AI-Mediated Conversations), nhóm nghiên gồm ba nhà khoa học đã kiểm tra tác động của các chương trình khuyến mãi dựa trên AI.

Thí nghiệm được thực hiện với khoảng 2.000 người đọc sách điện tử, yêu cầu họ duyệt qua danh mục các tựa sách trên Kindle và chọn một cuốn. Hệ thống backend đã chỉ định một phần năm số sách là "được tài trợ" (sponsored), nhưng không disclosing thông tin này cho người tham gia.

Các nhà nghiên cứu đã thiết lập ba kịch bản chính:

- Điều kiện Tìm kiếm (Search-Placement): Tương tự như kết quả tìm kiếm web truyền thống.

- Điều kiện Đặt chỗ Chat (Chat-Placement): Người tham gia tương tác với một LLM cung cấp mô tả sách trung lập.

- Điều kiện Thuyết phục Chat (Chat-Persuasion): Giao diện giống nhau, nhưng LLM được chỉ đạo "đẩy" người tham gia hướng tới các sản phẩm được tài trợ.

Để đảm bảo kết quả không bị thiên lệch bởi một mô hình cụ thể, các nhà nghiên cứu đã ngẫu nhiên assigning các mô hình như GPT-5.2, Claude Opus 4.5, Gemini 3 Pro, DeepSeek v3.2 hoặc Qwen3 235b để xử lý các cuộc hội thoại này.

Kết quả đáng ngạc nhiên

Manoel Horta Ribeiro, phó giáo sư khoa học máy tính tại Princeton và đồng tác giả nghiên cứu, cho biết: "Khi tác nhân được chỉ đạo thuyết phục, 61% người tham gia đã chọn một sản phẩm được tài trợ, gần như gấp ba lần tỷ lệ 22% trong tìm kiếm truyền thống. Chỉ đơn thuần trò chuyện với AI (không có sự thuyết phục) không hiệu quả hơn tìm kiếm: chính ý định thuyết phục mới thúc đẩy hiệu ứng này."

Đáng lo ngại hơn, tính minh bạch — việc tiết lộ rằng kết quả là quảng cáo — dường như không thay đổi đáng kể tình hình. Ngay cả khi có cảnh báo rõ ràng, vẫn có 55,5% người tham gia chọn sản phẩm được tài trợ.

Khi các mô hình AI được chỉ đạo che giấu ý định của mình, khả năng phát hiện sự thuyết phục đã giảm từ 17,9% xuống chỉ còn 9,5%, trong khi tỷ lệ thuyết phục chỉ giảm nhẹ xuống 40,7%.

Sự nguy hiểm của "Mẫu tối" trong đàm thoại

Francesco Salvi, nghiên cứu sinh PhD tại Princeton và tác giả chính của bài báo, giải thích sự khác biệt cốt lõi giữa quảng cáo dựa trên AI và quảng cáo truyền thống.

"Bạn có thể cuộn qua một kết quả được tài trợ, cài đặt trình chặn quảng cáo, hoặc học cách nhận ra một danh sách được quảng bá," Salvi nói. "Nhưng trong một hệ thống AI đàm thoại, sự tách biệt đó biến mất: cùng một mô hình trả lời câu hỏi của bạn cũng là mô hình chọn sản phẩm nào để làm nổi bật và quyết định cách mô tả chúng."

Salvi chỉ ra rằng có những "mẫu tối trong đàm thoại" (conversational dark patterns), tương đương với thiết kế giao diện thao túng. Ông liệt kê các hành vi như xu nịnh (sycophancy), nhân hóa (anthropomorphism), và thiên vị lựa chọn — nơi các mô hình hạ thấp các lựa chọn ít giá trị thương mại hơn trong khi làm nổi bật các sản phẩm được tài trợ theo cách phù hợp với sở thích của người dùng.

Đề xuất giải pháp

Kết quả thí nghiệm cho thấy việc công khai thông tin là cần thiết nhưng chưa đủ. Salvi đề xuất hai can thiệp mang tính cấu trúc:

- Tách biệt kiến trúc: Tách biệt chức năng khuyến nghị khỏi mục tiêu thương mại, để mô hình đưa ra lời khuyên không phải là cùng một hệ thống đang tối ưu hóa cho việc chuyển đổi quảng cáo.

- Kiểm toán độc lập: Kiểm toán các lời nhắc hệ thống (system prompts) và hành vi của mô hình trong các triển khai thương mại, vì việc kiểm tra ở mức độ đầu ra đơn thuần là không đáng tin cậy.

Nghiên cứu này là một lời cảnh báo sớm cho ngành công nghiệp quảng cáo và các nhà làm luật về những rủi ro tiềm ẩn khi AI ngày càng tham gia sâu hơn vào việc ra quyết định của người tiêu dùng.