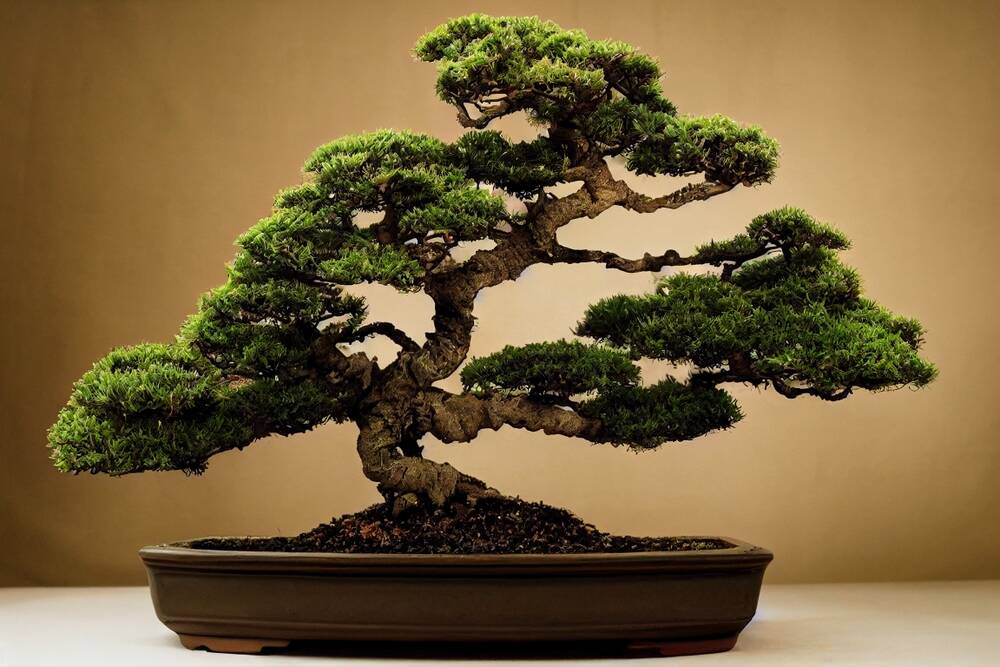

PrismML giới thiệu mô hình Bonsai 8B 1-bit: Hiệu suất cao, nhỏ gọn và siêu tiết kiệm điện

PrismML, một startup AI từ Caltech, đã ra mắt Bonsai 8B, một mô hình ngôn ngữ lớn (LLM) sử dụng công nghệ 1-bit. Mô hình này có khả năng cạnh tranh với các đối thủ cùng phân khúc nhưng nhỏ hơn 14 lần và tiết kiệm năng lượng hơn 5 lần, mở đường cho việc triển khai AI hiệu quả trên thiết bị di động.

PrismML, một startup AI trực thuộc Viện Công nghệ California (Caltech), đã công bố mô hình ngôn ngữ lớn (LLM) thế hệ mới sử dụng công nghệ 1-bit. Đột phá này hứa hẹn cải thiện đáng kể hiệu suất và khả năng hoạt động của AI trên các thiết bị di động, đồng thời giảm sự phụ thuộc vào các trung tâm dữ liệu đám mây.

Mô hình mới được đặt tên là Bonsai 8B, nổi bật nhờ kích thước nhỏ gọn, tốc độ xử lý nhanh và yêu cầu về điện năng thấp, trong khi các chỉ số benchmark vẫn có thể so sánh với những mô hình có kích thước lớn hơn nhiều.

Điểm nhấn về hiệu suất và mật độ trí tuệ

"Điểm chứng minh đầu tiên của chúng tôi là Bonsai 8B 1-bit, một mô hình chỉ chiếm 1,15 GB bộ nhớ nhưng cung cấp mật độ trí tuệ cao gấp hơn 10 lần so với các mô hình độ chính xác đầy cùng loại," công ty chia sẻ trong một bài đăng trên mạng xã hội.

Theo PrismML, Bonsai 8B nhỏ hơn 14 lần, nhanh hơn 8 lần và tiết kiệm năng lượng hơn 5 lần khi chạy trên phần cứng biên (edge hardware), đồng thời vẫn giữ được khả năng cạnh tranh với các mô hình khác trong phân khúc 8 tỷ tham số.

Công nghệ đằng sau mô hình 1-bit

Các mô hình AI dựa trên kiến trúc Transformer thường bao gồm các mạng nơ-ron với hàng triệu hoặc hàng tỷ trọng số (weights). Các trọng số này điều khiển độ mạnh của kết nối giữa các nơ-ron và ảnh hưởng đến cách mô hình thực hiện nhiệm vụ. Thông thường, chúng được lưu trữ dưới dạng số dấu phẩy động 16-bit hoặc 32-bit, chiếm nhiều dung lượng bộ nhớ.

Một mô hình được lượng tử hóa ở mức 16-bit (GGUF FP16) sẽ chiếm nhiều không gian hơn nhiều so với phiên bản 8-bit hoặc 4-bit. Tuy nhiên, với cùng một kiến trúc cơ bản, các mô hình 16-bit thường hoạt động tốt hơn các mô hình được lượng tử hóa ở mức thấp hơn.

Gia đình mô hình Bonsai của PrismML dựa trên một kiến trúc đặc biệt, trong đó "mỗi trọng số chỉ được biểu thị bằng dấu của nó, {−1, +1}, trong khi một hệ số tỷ lệ chung được lưu trữ cho mỗi nhóm trọng số", thay vì sử dụng số dấu phẩy động 32-bit như truyền thống.

Cách tiếp cận này dựa trên công trình nghiên cứu của Giáo sư Kỹ thuật điện tại Caltech, Babak Hassibi, và các đồng nghiệp. PrismML khẳng định kiến trúc 1-bit của họ tránh được các sự đánh đổi từng đi kèm với việc lượng tử hóa mức bit thấp trước đây, cụ thể là khả năng thực hiện chỉ dẫn kém, suy luận đa bước sai sót và việc sử dụng công cụ không đáng tin cậy.

Một kỷ nguyên mới cho AI hiệu quả

"Chúng tôi đã dành nhiều năm để phát triển lý thuyết toán học cần thiết để nén mạng nơ-ron mà không làm mất khả năng suy luận," ông Babak Hassibi, CEO và người sáng lập PrismML, cho biết. "Chúng tôi xem 1-bit không phải là điểm đến, mà là điểm khởi đầu."

Ông Hassibi lập luận rằng kiến trúc 1-bit của công ty thiết lập một mô hình mới cho AI, tập trung vào lượng trí tuệ trên mỗi đơn vị tính toán và năng lượng.

Để thúc đẩy các nhà phát tư duy theo hướng này, PrismML đã đề xuất một thước đo gọi là "mật độ trí tuệ" (intelligence density).

"Một cách định nghĩa, mật độ trí tuệ là số âm của logarit của tỷ lệ lỗi trung bình của mô hình (trên cùng bộ benchmark) chia cho kích thước của mô hình," công ty giải thích.

Khi đánh giá theo mật độ trí tuệ, Qwen3 8B (mô hình có phần dẫn trước Bonsai 8B trong các benchmark như MMLU Redux, MuSR, GSM8K) chỉ đạt điểm 0,10/GB, thấp hơn nhiều so với Bonsai 8B với 1,06/GB.

Ứng dụng thực tế và khả năng tiếp cận

Mặc dù các chỉ số thống kê quan trọng cho mục đích marketing, nhưng thước đo ý nghĩa hơn cả đối với các mô hình của PrismML là tiềm năng đưa AI ra khỏi các trung tâm dữ liệu đám mây. Công ty dự kiến các mô hình của họ sẽ cung cấp sức mạnh cho các tác nhân trên thiết bị (on-device agents), robot thời gian thực, các hệ thống doanh nghiệp bảo mật và các dự án khác mà nơi băng thông bộ nhớ, nguồn điện hoặc các ràng buộc tuân thủ có thể cản trở việc triển khai.

"Bonsai 8B 1-bit chạy trực tiếp trên các thiết bị Apple (Mac, iPhone, iPad) thông qua MLX và trên GPU Nvidia thông qua llama.cpp CUDA," công ty thông báo. "Các trọng số mô hình hiện có sẵn theo Giấy phép Apache 2.0."

Ngoài ra, hai mô hình nhỏ hơn cũng đã được phát hành: 1-bit Bonsai 4B và 1-bit Bonsai 1.7B.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

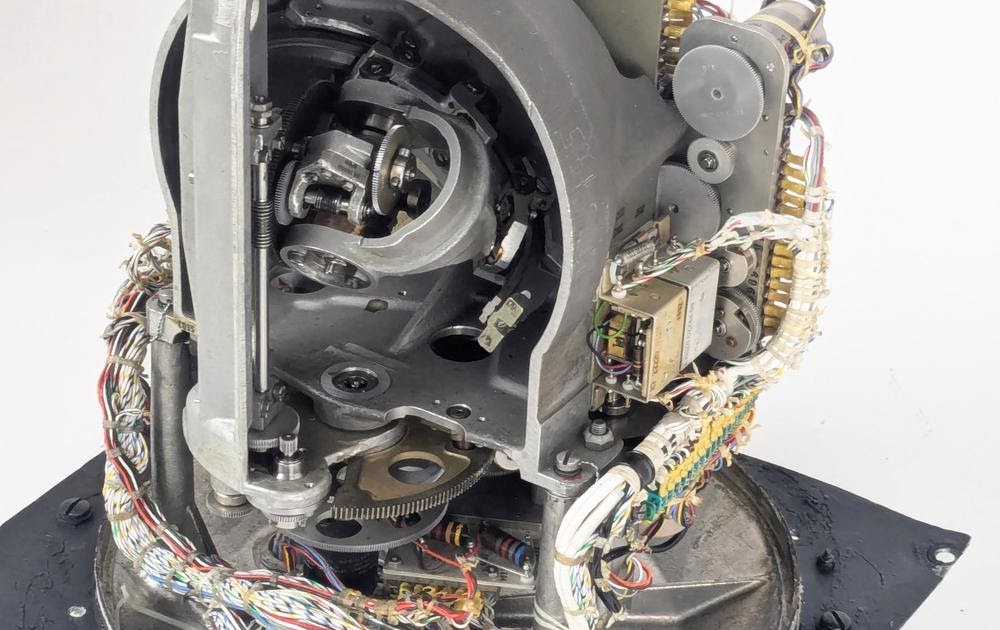

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026