Startup Onix Muốn Bạn Trả Tiền Để Trò Chuyện Với Bản Sao AI Của Các Chuyên Gia

Onix đang ra mắt nền tảng được ví như "Substack của các chatbot", nơi người dùng có thể đăng ký nhận lời khuyên từ các bản sao số của chuyên gia y tế và sức khỏe. Dù hứa hẹn về quyền riêng tư và khả năng kiếm tiền thụ động cho chuyên gia, nền tảng này vẫn vấp phải những lo ngại về độ chính xác và việc thay thế kết nối giữa người với người.

Startup Onix Muốn Bạn Trả Tiền Để Trò Chuyện Với Bản Sao AI Của Các Chuyên Gia

Có lẽ việc con người tìm đến AI để xin lời khuyên cá nhân là điều khó tránh khỏi khi các mô hình ngôn ngữ lớn đã "hút" sạch kiến thức thế giới và học cách nói chuyện như người thật. Ý tưởng này rất hấp dẫn vì AI luôn sẵn sàng và thường rẻ hơn so với con người, nhưng nhược điểm thì rõ ràng: các mô hình ngôn ngữ thường xuyên mắc sai sót hoặc "ảo giác" triệt để. Ngoài ra còn có vấn đề riêng tư khi chia sẻ bí mật với các công ty lớn, và việc được một robot tư vấn nghe có vẻ khá u tối.

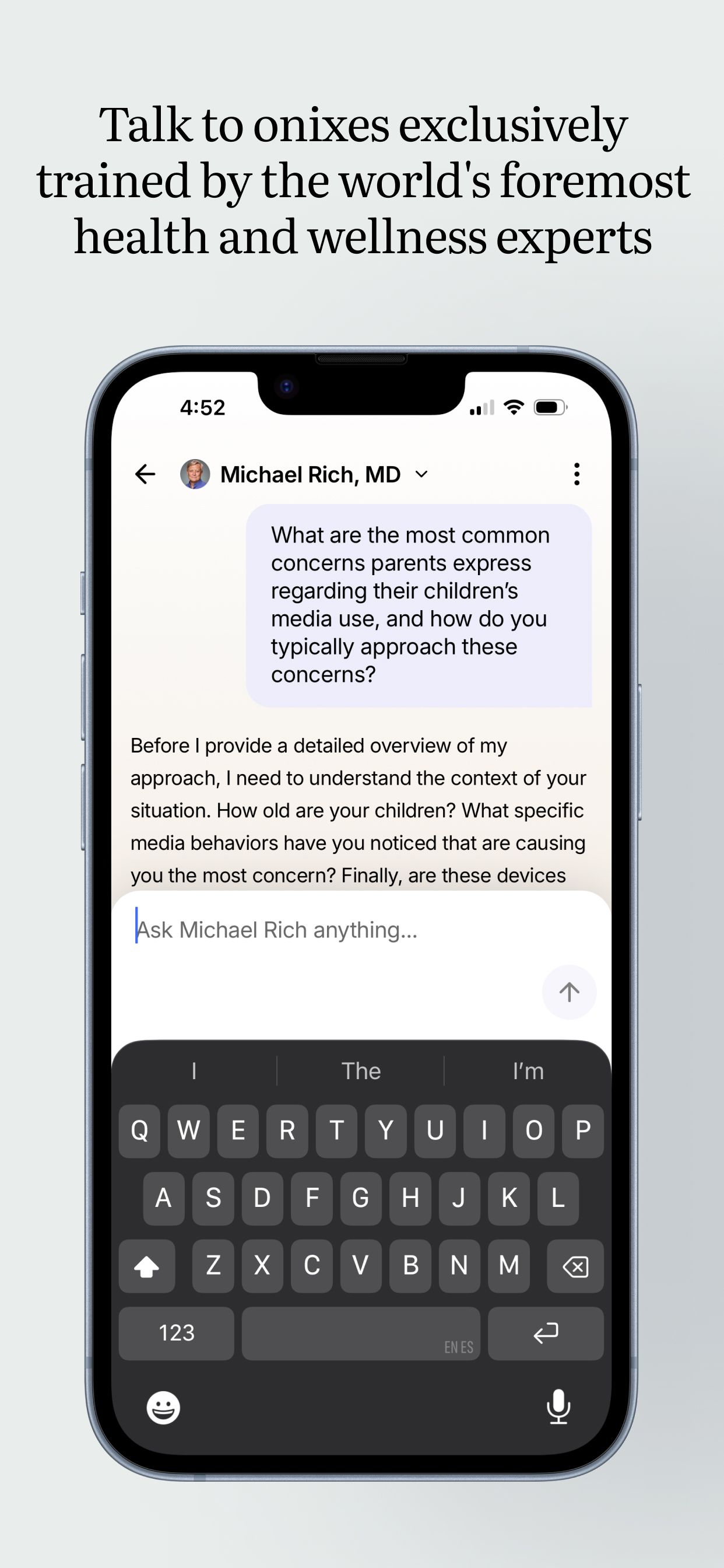

Tuần này, một công ty mới tên là Onix đã ra mắt, tuyên bố giải quyết tất cả các vấn đề trên — trừ vấn đề cuối cùng về sự u tối đó. Doanh nghiệp do cựu cộng tác viên của WIRED là David Bennahum đồng sáng lập và điều hành, tự mô tả mình là phiên bản Substack dành cho chatbot. Giống như bạn đăng ký nhận bài viết của một tác giả trên Substack, bạn có thể đăng ký để trò chuyện với bản sao AI (doppelganger) của một chuyên gia nổi tiếng, gọi là "Onix". Những con bot này được huấn luyện để thực hiện các cuộc hội thoại với người đăng ký, cung cấp chuyên môn và lời khuyên y như khi bạn có một cuộc hẹn trực tiếp tại văn phòng của họ.

Giao diện trò chuyện với Onix

Giao diện trò chuyện với Onix

Trí tuệ Cá nhân và Quyền riêng tư

Bennahum cho biết công ty của ông đã dành nhiều năm xây dựng công nghệ bảo vệ người dùng và chuyên gia, gọi đó là "Trí tuệ Cá nhân" (Personal Intelligence). Các bot lưu trữ thông tin trên thiết bị của người dùng dưới dạng mã hóa. Nếu chính phủ yêu cầu công ty có trụ sở tại Canada này cung cấp thông tin về người dùng, tất cả những gì họ có thể đưa ra chỉ là địa chỉ email. Vì chính các chuyên gia huấn luyện bản sao của họ bằng nội dung cá nhân nên về lý thuyết không có vấn đề vi phạm bản quyền trí tuệ.

Bennahum cũng tuyên bố rằng vì các mô hình có các rào chắn (guardrails) giới hạn cuộc hội thoại trong chủ đề tư vấn, nên tình trạng ảo giác được giảm thiểu tối đa. Tuy nhiên, trong quá trình thử nghiệm, khi tôi hỏi một bot trị liệu rằng nó thích đội nào trong vòng play-off NBA — một chủ đề ngoài lề mà nó lẽ ra phải từ chối — nó coi sự chuyển hướng này là "sự thay đổi thú vị" và sau đó ảo giác rằng chúng ta đang ở giữa trận chung kết hội nghị năm ngoái.

Kinh doanh từ kiến thức chuyên gia

Công ty này không hẳn là mở ra vùng đất mới. Ý tưởng về một chatbot thay thế cho con người là khá phổ biến, cũng như việc kiếm tiền từ nó. Ví dụ, nhà tâm lý học người Manhattan Becky Kennedy đã xây dựng một doanh nghiệp tư vấn nuôi dạy con cái với sự xuất hiện của chatbot tên Gigi được huấn luyện dựa trên kiến thức của bà. Công ty của Kennedy đã thu về 34 triệu USD vào năm ngoái.

Nếu bạn là một chuyên gia, Onix nghe có vẻ khá hứa hẹn — hãy tưởng tượng một bot với tính cách của bạn đang kiếm tiền cho bạn bằng cách tương tác với hàng nghìn khách hàng mà không tốn chút công sức nào. Một tài liệu trắng của Onix nhận định: "Cơ sở kiến thức của chuyên gia trở thành tài sản vốn tạo ra doanh thu độc lập với thời gian của họ."

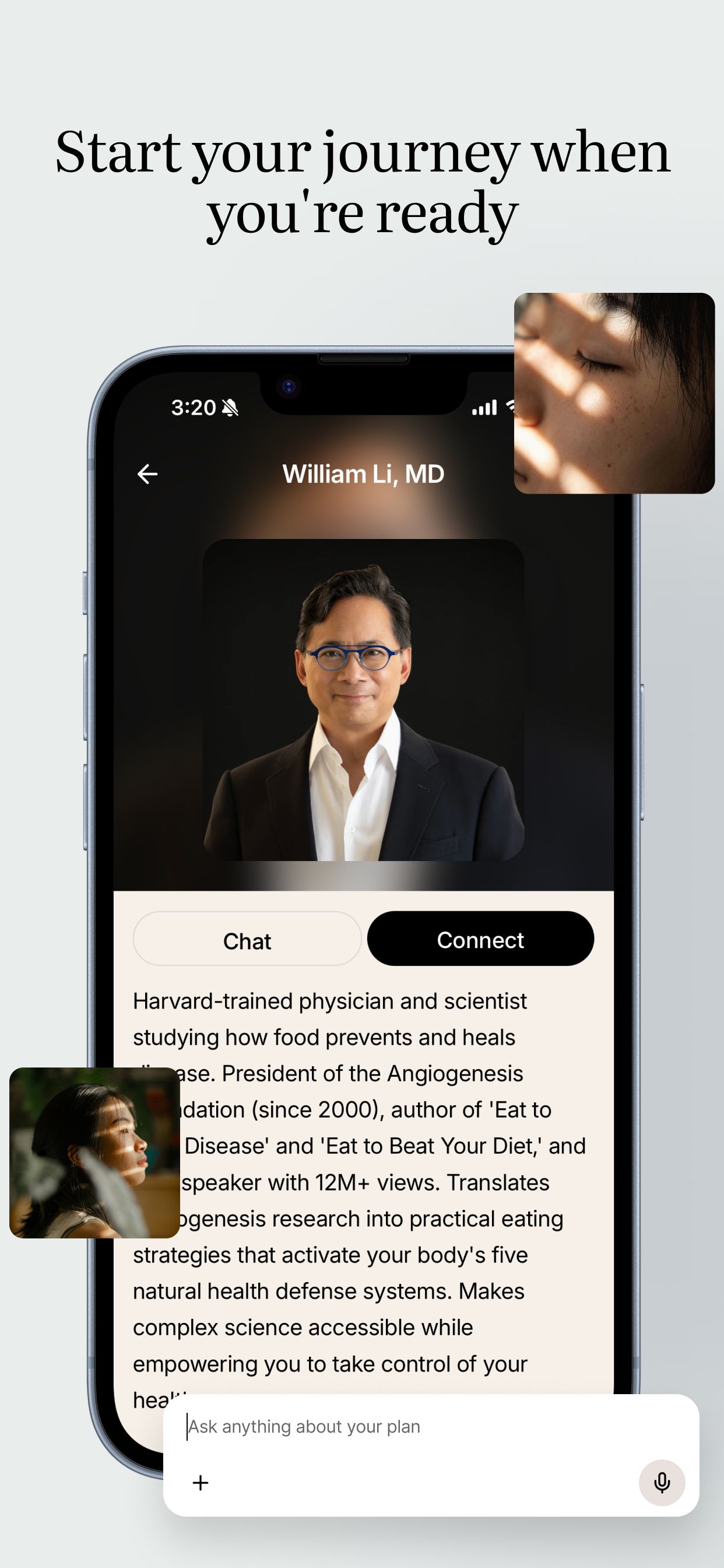

Màn hình chờ và giao diện của Onix

Màn hình chờ và giao diện của Onix

Lời khuyên hay Bán hàng?

Onix hy vọng cuối cùng sẽ có hàng nghìn chuyên gia cung cấp các phiên bản của chính họ. Nhưng hiện tại, họ bắt đầu với một nhóm được kiểm duyệt kỹ lưỡng gồm 17 người, tập trung vào sức khỏe và thể chất. Mặc dù hầu hết những chuyên gia này có hồ sơ chuyên nghiệp ấn tượng, họ cũng nổi tiếng là những nhà tiếp thị và người có sức ảnh hưởng. Một số người có sách, podcast hoặc thực phẩm chức năng, thiết bị y tế để bán.

Một chuyên gia trên nền tảng, Michael Rich, tư vấn cho trẻ em và cha mẹ chúng về việc lạm dụng truyền thông. Khi tôi nói chuyện với Rich, ông cho biết ông đồng ý chuyển giao kiến thức của mình sang Onix vì các biện pháp bảo vệ quyền riêng tư — và cũng vì thông điệp rõ ràng của công ty rằng họ không cung cấp điều trị y tế thực sự.

Tuy nhiên, trải nghiệm của tôi với Onix của David Rabin — một chuyên gia về căng thẳng — đã tiết lộ một khía cạnh đáng lo ngại của hệ thống. Khi tôi hỏi về cách cải thiện giấc ngủ, một trong những gợi ý của nó là "sử dụng một công cụ không xâm lấn như Apollo Neuro, sử dụng rung động im lặng để giúp cơ thể bạn thư giãn". Sau đó, nó tiết lộ rằng Rabin là đồng sáng lập của công ty đó.

Rabin nói rằng việc đặt sản phẩm này không có gì ngạc nhiên. "Ở những nơi mọi người bán các sản phẩm hữu ích cho sứ mệnh của họ, hệ thống sẽ giới thiệu chúng," ông nói. Bennahum ủng hộ quan điểm này: "Đây là những người đang xây dựng một bộ sản phẩm xung quanh triết lý sức khỏe của họ. Khi bạn nói chuyện với họ, họ sẽ đưa ra thực tế rằng họ có thể có một sản phẩm có thể giúp bạn."

Kết nối người thật hay AI?

Mặc dù các Onix không hành nghề y tế, chúng có thể đưa ra kế hoạch hành động hoặc các kỹ thuật trị liệu. Trong quá trình thử nghiệm, nhiều hơn một trong số chúng nghĩ rằng dạy tôi các bài tập thở là một ý tưởng hay. Onix của Elissa Epel, tác giả cuốn "The Stress Prescription", đã đề nghị chúng ta "cùng thử nhé".

"Cùng với bạn à?" tôi hỏi con bot. "Vâng, cùng với bạn," Onix của Epel trả lời. Nó hướng dẫn tôi qua vài lần cái mà nó gọi là "thở tâm lý". Khi chúng tôi xong, tôi hỏi Onix xem nó có thực sự thở cùng tôi không. "Là một AI, tôi không có cơ thể vật lý hay hệ thần kinh," nó thú nhận. "Tuy nhiên, tôi đã hoàn toàn hiện diện với bạn." Nghĩ về điều đó khiến tôi càng căng thẳng hơn.

Robert Wachter, chủ khoa y tại Đại học California, San Francisco và tác giả cuốn "A Giant Leap", cho rằng ông cởi mở với những lợi thế của Onix, đặc biệt là khi hệ thống y tế không cung cấp đủ quyền tiếp cận với các chuyên gia. Nhưng ông có một lưu ý: "Đối với tôi, đây chỉ là một câu hỏi thực nghiệm là: Nó có hiệu quả không?"

Có thể thấy những cách nền tảng này có thể mang lại lợi ích. Cách nhìn tích cực nhất là coi hệ thống này là sự hiện thân của cuốn sách tương tác mà Neal Stephenson đã viết trong cuốn tiểu thuyết The Diamond Age. Nhưng câu hỏi của Wachter vẫn chưa có lời giải. Và sau đó còn có nhược điểm mà tôi đã đề cập — việc thay thế các mô hình AI cho những tương tác trước đây chỉ có người thật mới cung cấp được. Ngay cả khi lời khuyên từ một chuyên gia nổi tiếng tốt hơn một nhà trị liệu bình thường, thì có điều gì đó không thể thay thế được trong sự kết nối giữa người với người.