TurboQuant của Google: Công nghệ nén AI tiết kiệm bộ nhớ nhưng không cứu được bão giá DRAM

Công nghệ TurboQuant mới của Google hứa hẹn cắt giảm tới 6 lần lượng bộ nhớ cần thiết để vận hành các mô hình AI bằng cách nén bộ nhớ đệm KV. Tuy nhiên, thay vì làm giảm giá thành linh kiện DRAM, hiệu quả này nhiều khả năng sẽ kích thích nhu cầu dành cho các ứng dụng có ngữ cảnh rộng lớn hơn.

TurboQuant của Google: Công nghệ nén AI tiết kiệm bộ nhớ nhưng không cứu được bão giá DRAM

Khi Google giới thiệu TurboQuant, một công nghệ nén dữ liệu AI hứa hẹn cắt giảm lượng bộ nhớ cần thiết để vận hành các mô hình, nhiều người hy vọng nó sẽ giải quyết tình trạng khan hiếm bộ nhớ khiến giá cả tăng gấp ba trong năm qua. Nhưng thực tế có lẽ không như kỳ vọng.

TurboQuant không phải là "cứu tinh" mà nhiều người mong đợi. Tuy nhiên, công nghệ cốt lõi của nó vẫn đáng được xem xét kỹ lưỡng vì có những tác động lớn đối với các nhà phát triển mô hình và nhà cung cấp dịch vụ suy luận (inference).

TurboQuant thực chất là gì?

Được các nhà nghiên cứu của Google mô tả chi tiết trong một bài đăng blog gần đây, TurboQuant về cơ bản là một phương pháp nén dữ liệu được sử dụng trong AI tạo sinh từ độ chính xác cao xuống thấp hơn, một cách tiếp cận thường được gọi là lượng tử hóa (quantization).

Theo các nhà nghiên cứu, TurboQuant có khả năng giảm mức tiêu thụ bộ nhớ trong quá trình suy luận ít nhất 6 lần, một tuyên bố táo bạo trong bối cảnh giá DRAM và NAND đang ở mức kỷ lục.

Tuy nhiên, không giống như hầu hết các phương pháp lượng tử hóa, TurboQuant không làm nhỏ đi mô hình. Thay vào đó, nó nhằm mục đích giảm lượng bộ nhớ cần thiết để lưu trữ các bộ nhớ đệm Key-Value (KV) được sử dụng để duy trì ngữ cảnh trong quá trình suy luận của LLM (Mô hình ngôn ngữ lớn).

Nói một cách đơn giản, bộ nhớ đệm KV giống như bộ nhớ ngắn hạn của mô hình. Trong một phiên trò chuyện, bộ nhớ đệm KV là cách mà mô hình theo dõi cuộc hội thoại của bạn.

Vấn đề phức tạp nằm ở chỗ các bộ nhớ đệm KV này có thể tích tụ rất nhanh, thường tiêu tốn nhiều bộ nhớ hơn cả chính mô hình. Thông thường, các bộ nhớ đệm KV này được lưu trữ ở độ chính xác 16-bit. Vì vậy, nếu bạn có thể giảm số bit dùng để lưu trữ chúng xuống tám hoặc thậm chí bốn bit, bạn có thể giảm lượng bộ nhớ cần thiết từ 2 đến 4 lần.

Đột phá về công nghệ

Mặc dù TurboQuant đã thu hút sự chú ý vào việc lượng tử hóa bộ nhớ đệm KV, nhưng ý tưởng tổng quát này không hề mới. Trên thực tế, khá phổ biến đối với các cơ chế suy luận lưu trữ bộ nhớ đệm KV ở định dạng FP8 vì những lý do này.

Tuy nhiên, loại lượng tử hóa này không miễn phí. Độ chính xác thấp hơn có nghĩa là ít bit hơn để lưu trữ các giá trị chính xác và do đó ít bộ nhớ hơn. Các phương pháp lượng tử hóa này cũng có xu hướng tạo ra các gánh nặng hiệu suất riêng. Đây chính là nơi sự đổi mới của TurboQuant nằm.

Google khẳng định họ có thể đạt được chất lượng tương đương BF16 chỉ với 3.5 bit, đồng thời giảm thiểu những gánh nặng phiền toái đó. Ở mức 4 bit, họ tuyên bố có thể tăng tốc độ lên tới 8 lần trên chip H100 khi tính toán các logits chú ý (attention logits) dùng để quyết định điều gì trong ngữ cảnh là quan trọng hoặc không quan trọng đối với yêu cầu.

Các nhà nghiên cứu không dừng lại ở đó. Trong quá trình kiểm thử, họ phát hiện ra rằng có thể nén các bộ nhớ đệm KV xuống còn 2.5 bit với sự suy giảm chất lượng tối thiểu, chính là nơi mà con số giảm 6 lần bộ nhớ được đưa ra.

Cách thức hoạt động của TurboQuant

TurboQuant có thể đạt được thành tựu này bằng cách kết hợp hai phương pháp toán học: Quantized Johnson-Lindenstrauss (QJL) và PolarQuant.

PolarQuant hoạt động bằng cách ánh xạ các vector bộ nhớ đệm KV (về cơ bản là các biểu thức toán học đa chiều của độ lớn và hướng) lên một lưới tròn sử dụng tọa độ cực thay vì tọa độ Descartes.

"Điều này có thể so sánh với việc thay thế chỉ đường 'đi 3 khối nhà về phía Đông, 4 khối nhà về phía Bắc' bằng 'đi tổng cộng 5 khối nhà theo góc 37 độ'", bài đăng blog của Google giải thích.

Sử dụng cách tiếp cận này, độ lớn và hướng của vector hiện nay được đại diện bởi bán kính và góc của nó. Gã khổng lồ tìm kiếm giải thích rằng điều này loại bỏ các chi phí bộ nhớ liên quan đến việc chuẩn hóa dữ liệu vì mỗi vector giờ đây chia sẻ một điểm tham chiếu chung.

Ngoài PolarQuant, Google còn sử dụng QJL để sửa bất kỳ lỗi nào được đưa ra trong giai đoạn đầu và bảo toàn độ chính xác của điểm số chú ý mà mô hình sử dụng để xác định thông tin nào quan trọng đối với việc phục vụ yêu cầu.

Kết quả là các vector này có thể được lưu trữ bằng chỉ một phần nhỏ bộ nhớ. Và công nghệ này không bị giới hạn ở bộ nhớ đệm KV. Theo Google, công nghệ này cũng có các ứng dụng đối với cơ sở dữ liệu vector được sử dụng bởi các công cụ tìm kiếm.

Tại sao TurboQuant không cứu được sự hỗn loạn về bộ nhớ

Với tỷ lệ nén được công bố là 6:1, không có gì ngạc nhiên khi nhiều người trên Phố Wall đã gán sự sụt giảm của các nhà sản xuất bộ nhớ với sự ra mắt của TurboQuant.

Nhưng dù công nghệ này có khả năng làm cho các cụm suy luận AI hiệu quả hơn và do đó rẻ hơn khi vận hành, thì khả năng cao là nó sẽ không kìm hãm được nhu cầu đối với bộ nhớ flash NAND và DRAM dùng để lưu trữ các bộ nhớ đệm KV đó.

Một năm trước, các mô hình có trọng số mở (open weights) như DeepSeek R1 cung cấp các cửa sổ ngữ cảnh (context windows) từ 64.000 đến 256.000 token. Ngày nay, không hiếm khi tìm thấy các mô hình mở có cửa sổ ngữ cảnh vượt quá một triệu token.

TurboQuant có thể cho phép một nhà cung cấp dịch vụ suy luận sử dụng ít bộ nhớ hơn, hoặc cho phép họ phục vụ các mô hình có cửa sổ ngữ cảnh lớn hơn. Với các trợ lý lập trình và khung tác tử (agentic frameworks) như OpenClaw thúc đẩy nhu cầu về các cửa sổ ngữ cảnh lớn hơn, khả năng cao là điều thứ hai sẽ xảy ra.

Có vẻ như các chuyên gia theo dõi ngành công nghệ tại TrendForce cũng đồng ý. Trong một báo cáo được công bố đầu tuần này, họ dự đoán rằng TurboQuant sẽ khơi dậy nhu cầu đối với các ứng dụng ngữ cảnh dài, từ đó thúc đẩy nhu cầu về nhiều bộ nhớ hơn thay vì kìm hãm nó.

Bài viết liên quan

Công nghệ

Meta đổ lỗi cho thiếu hụt RAM khi tăng giá 100 USD cho tai nghe Quest 3

16 tháng 4, 2026

Công nghệ

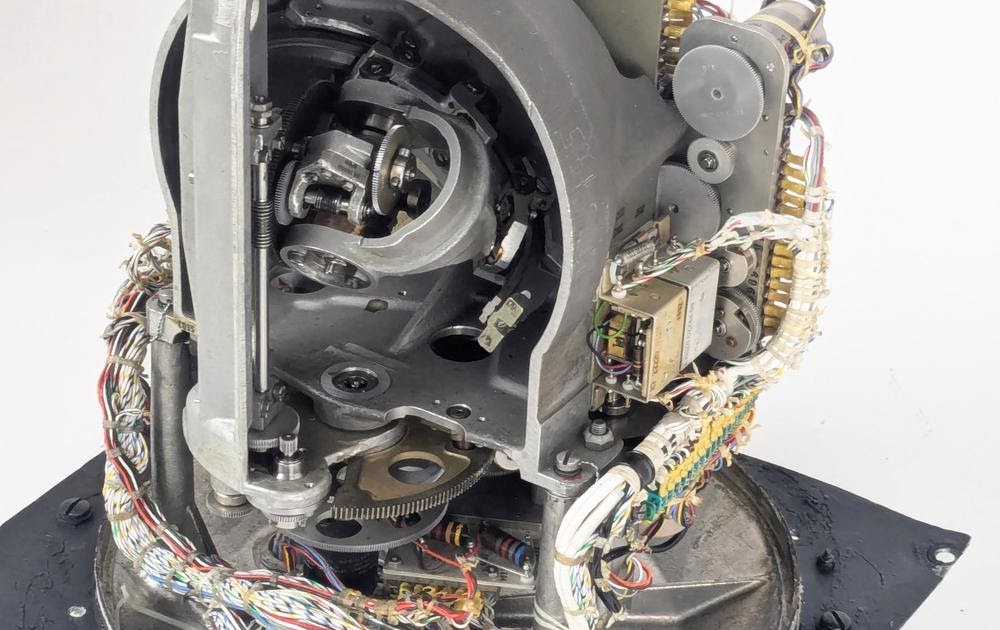

Máy tính góc cơ điện tử bên trong hệ thống theo dõi sao của máy bay ném bom B-52

18 tháng 4, 2026

Công nghệ

Fuzix OS 0.4 chính thức phát hành: Cải tiến mạng, định dạng tệp và hỗ trợ phần cứng phong phú

18 tháng 4, 2026