Tỷ lệ sử dụng GPU chỉ 5%: Cơn ác mộng 401 tỷ USD trong hạ tầng AI doanh nghiệp

Doanh nghiệp đã chi tiêu khổng lồ cho GPU nhưng tỷ lệ sử dụng thực tế chỉ đạt 5%, dẫn đến lãng phí nghiêm trọng. Bài viết phân tích sự chuyển dịch từ việc tích trữ phần cứng sang tối ưu hóa hiệu quả kinh tế và các giải pháp kỹ thuật như đám mây chuyên dụng và bộ nhớ đệm chia sẻ.

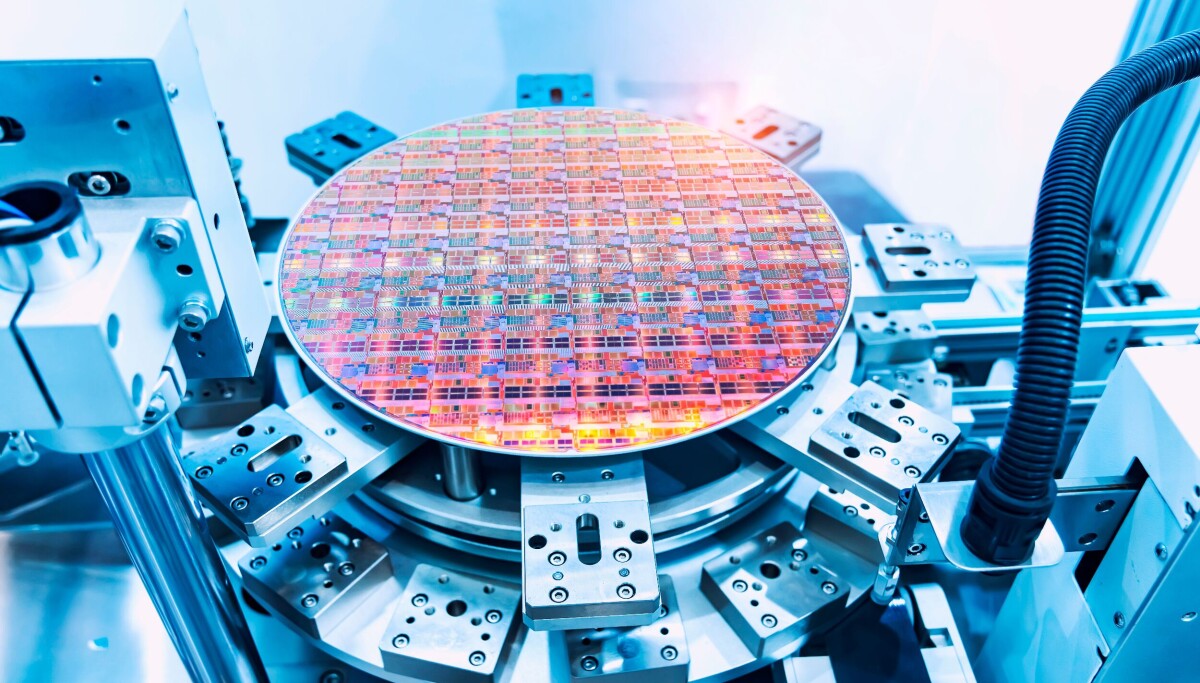

Trong 24 tháng qua, một câu chuyện duy nhất đã biện minh cho mọi trung tâm dữ liệu được cung cấp quá mức và ngân sách IT phình to: cuộc chạy đua giành GPU. Silicon được coi là "dầu mỏ mới", và các chip H100 được giao dịch như hàng cấm. Hãy dự trữ dung lượng ngay bây giờ hoặc doanh nghiệp của bạn sẽ bị bỏ lại phía sau.

Giờ đây, hóa đơn đã đến hạn và các giám đốc tài chính (CFO) đang bắt đầu chú ý. Gartner ước tính rằng hạ tầng AI đang thêm 401 tỷ USD chi tiêu mới trong năm nay. Tuy nhiên, các cuộc kiểm toán thực tế lại kể một câu chuyện ảm đạm hơn: tỷ lệ sử dụng GPU trung bình trong doanh nghiệp đang mắc kẹt ở mức 5%.

Mức sử dụng thấp này được thúc đẩy bởi một vòng tuần tự mua sắm tự củng cố, khiến cho các GPU rảnh rỗi gần như không thể được giải phóng. Điều khiến sự thay đổi này trở nên cấp bách hơn là thực tế về Chi phí vốn (CapEx) đang ảnh hưởng đến bảng cân đối kế toán của doanh nghiệp. Nhiều tổ chức đã khóa dung lượng GPU theo chu kỳ khấu hao truyền thống từ 3 đến 5 năm. Điều đó có nghĩa là hạ tầng được mua vào thời kỳ đỉnh cao của "cuộc chạy đua GPU" giờ đây trở thành một chi phí cố định, bất kể nó được sử dụng bao nhiêu.

Khi những tài sản này già đi, câu hỏi không còn là liệu khoản đầu tư đó có được biện minh hay không. Vấn đề là liệu nó có thể được đưa vào sản xuất hiệu quả hay không. GPU bị sử dụng kém không chỉ là tài nguyên nhàn rỗi, chúng là tài sản đang khấu hao và phải tạo ra lợi nhuận đo lường được. Điều này buộc phải thay đổi tư duy: từ việc tích lũy dung lượng sang tối đa hóa sản lượng kinh tế từ những gì đã được triển khai.

Cuộc chạy đua chỉ là màn kịch phụ

Đối với các "doanh nghiệp hạng đầu" như Intuit, Mastercard hay Pfizer, việc tiếp cận hiếm khi là nút thắt thực sự. Sử dụng các mối quan hệ tài chính sâu rộng với AWS, Azure và GCP, các tổ chức này đã bảo đảm đặt chỗ dung lượng nằm yên trong khi các nhóm nội bộ đang vật lộn với trọng lực dữ liệu, quản trị và sự non nớt về kiến trúc.

Câu chuyện về "sự khan hiếm" của ngành công nghiệp đã đóng vai trò như một lớp khói che phủ thuận tiện cho sự kém hiệu quả này. Trong khi các tiêu đề tập trung vào sự chậm trễ trong chuỗi cung ứng, thực tế nội bộ là một khoảng cách năng suất khổng lồ. Các tổ chức giàu hoạt động (mua chip) nhưng nghèo nàn về đầu ra (tạo ra gần như không có token hữu ích).

Với tỷ lệ sử dụng 5%, phép toán đơn giản là không hợp lý. Với mỗi đô la chi cho silicon, 95 cent về cơ bản là một khoản quyên góp cho lợi nhuận của nhà cung cấp đám mây. Trong bất kỳ bộ phận nào khác, chỉ số lãng phí 95% sẽ là lý do để sa thải; trong hạ tầng AI, nó được gọi là "sự chuẩn bị".

Theo dõi Q1: Một thị trường đang chuyển hướng

Báo cáo Theo dõi Thị trường Hạ tầng & Tính toán AI Quý 1/2026 của VentureBeat xác nhận rằng giai đoạn hoảng loạn đã chính thức kết thúc. Khi chúng tôi hỏi các người ra quyết định CNTT về điều gì thực sự thúc đẩy lựa chọn nhà cung cấp của họ ngày nay, kết quả cho thấy một thị trường đang chuyển hướng nhanh chóng:

- Sự sụp đổ của quyền truy cập: Yếu tố "Quyền truy cập GPU/Tính sẵn có" đã giảm từ 20,8% xuống 15,4% chỉ trong một quý — từ mối quan tâm chính xuống mức thứ yếu trong 90 ngày.

- Sự chuyển hướng thực tế: "Tích hợp với các đám mây và ngăn xếp dữ liệu hiện có" vẫn giữ vững là ưu tiên hàng đầu ở mức khoảng 43%, trong khi các yêu cầu về bảo mật và tuân thủ đã tăng vọt từ 41,5% lên 48,7%.

- Mệnh lệnh TCO: "Chi phí cho mỗi suy luận/TCO (tổng chi phí sở hữu)" như một ưu tiên hàng đầu đã nhảy vọt từ 34% lên 41% trong một quý, vượt qua hiệu suất để trở thành lăng kính mua sắm chủ đạo.

Kỷ nguyên của tấm séc trắng đã chết. Suy luận (inference) là nơi AI trở thành một khoản mục chi phí. Đối với hầu hết các doanh nghiệp, kinh tế đơn vị của mô hình này hiện không bền vững. Khi ngành chuyển sang định giá dựa trên mức sử dụng vào năm 2026, các kiến trúc cũ kỹ trở thành gánh nặng.

Từ hoạt động sang năng suất

Sự thay đổi được làm nổi bật trong dữ liệu Q1 của chúng tôi đại diện cho nhiều hơn là một sự điều chỉnh ngân sách; đó là một thay đổi cơ bản trong cách đo lường sự thành công của một nhà lãnh đạo AI.

Trong hai năm qua, thành công là về việc "bảo đảm" ngăn xếp. Trong kỷ nguyên hiệu quả, thành công là "bóp kiệt" ngăn xếp. Đây là lý do tại sao các nền tảng tối ưu hóa chi phí thấy sự gia tăng ngân sách kế hoạch lớn nhất trong khảo sát của chúng tôi. Người dùng IT ngày càng hỏi làm thế nào để ngừng trả tiền cho GPU họ không sử dụng. Họ đang chuyển từ đo lường hoạt động GPU (bao nhiêu chip được bật) sang năng suất GPU (bao nhiêu token hữu ích được tạo ra cho mỗi đô la chi tiêu).

Sở hữu "ngân đúc": Lựa chọn giữa người tiêu dùng và nhà sản xuất token

Khi các tổ chức chuyển từ khái niệm (proof-of-concept) sang sản xuất, trọng tâm chuyển từ GPU mới nhất sang kiến trúc tạo token. Mọi doanh nghiệp phải quyết định vai trò của mình trong nền kinh tế token: bạn sẽ là người tiêu dùng token, trả "thuế" vĩnh viễn cho nhà cung cấp mô hình, hay nhà sản xuất token, sở hữu hạ tầng và kinh tế đơn vị đi kèm với nó?

Lựa chọn này không chỉ là về chi phí; nó là về cách một tổ chức quyết định xử lý sự phức tạp. Sở hữu hạ tầng suy luận có nghĩa là vượt qua sự kiên trì của bộ nhớ đệm KV, hiểu kiến trúc lưu trữ, biết các đảm bảo về độ trễ có thể chấp nhận được và giải quyết các hạn chế về nguồn điện.

Chuyển hướng sang đám mây chuyên dụng

Báo cáo Q1 của VentureBeat cho thấy thị trường đang bỏ phiếu cho chiến lược này. Hướng đi chiến lược hàng đầu cho các doanh nghiệp hiện nay là chuyển nhiều khối lượng công việc hơn sang các đám mây AI chuyên dụng (như Coreweave, Lambda, Crusoe). Các nhà cung cấp này đang bán việc loại bỏ ma sát hạ tầng. Họ tối ưu hóa toàn bộ ngăn xếp — lưu trữ, mạng và lập lịch — xung quanh kinh tế suy luận thay vì hoạt động đám mây mục đích chung.

Sự trỗi dậy của suy luận được quản lý

Đối với các tổ chức nhận ra họ không thể xây dựng hay quản lý nhà máy suy luận của riêng mình hiệu quả, một xu hướng khác đang nổi lên. Các nhà cung cấp như Baseten, Anyscale, FireworksAI và Together AI cung cấp định giá có thể dự đoán và thỏa thuận mức dịch vụ mà không yêu cầu khách hàng trở thành chuyên gia về tinh chỉnh vLLM hoặc lập lịch GPU phân tán.

Đơn giản hóa ngăn xếp lai

Lựa chọn trở thành nhà sản xuất cũng được dễ dàng hơn nhờ một lớp mới của các nền tảng AI đám mây lai từ Red Hat, Nutanix và Broadcom. Thách thức là suy luận hiện đại phụ thuộc vào các thành phần mã nguồn mở phức tạp như vLLM, Triton và Kubernetes. Lời hứa của các nền tảng mới hơn này là tính di động: khả năng xây dựng ngăn xếp suy luận một lần và triển khai ở bất cứ đâu.

Kiến trúc của hiệu quả: Các đòn bẩy kỹ thuật của năng suất

Khắc phục bức tường sử dụng 5% đòi hỏi nhiều hơn là phần mềm tốt hơn; nó đòi hỏi một cuộc đại tu cấu trúc của ngăn xếp hiệu quả. Năng suất suy luận được xác định bởi bao nhiêu đầu ra hữu ích một cụm tạo ra cho mỗi đơn vị chi phí. Đạt được năng suất đó phụ thuộc vào ba đòn bẩy kỹ thuật: mạng, bộ nhớ và ngăn xếp lưu trữ.

Mạng: Chi phí của việc chờ đợi

Mạng là xương sống thường bị bỏ qua của kinh tế suy luận. Trong môi trường phân tán, tốc độ di chuyển dữ liệu giữa các nút tính toán và lưu trữ quyết định xem GPU có thực sự đang làm việc hay chỉ đang chờ đợi.

RDMA (Remote Direct Memory Access - Truy cập bộ nhớ từ xa trực tiếp) đã trở thành tiêu chuẩn không thể thương lượng. Bằng cách cho phép dữ liệu bỏ qua CPU và di chuyển trực tiếp giữa bộ nhớ và GPU, RDMA loại bỏ các đỉnh độ trễ mà các kiến trúc mạng truyền thống đưa ra. Nếu không có mức độ kết nối này, doanh nghiệp đang trả một khoản "thuế chờ đợi" trên mỗi chip.

Giải quyết "thuế bộ nhớ": Bộ nhớ đệm KV chia sẻ

Khi các mô hình trở nên lớn hơn và cửa sổ ngữ cảnh mở rộng hướng tới hàng triệu token, chi phí xây dựng lại trạng thái lệnh lặp đi lặp lại trở nên không bền vững. Các mô hình ngôn ngữ lớn dựa vào bộ nhớ đệm key-value (KV) để duy trì ngữ cảnh. Theo truyền thống, những thứ này được lưu trữ trong bộ nhớ GPU cục bộ, vừa đắt đỏ vừa hạn chế.

Để giải quyết vấn đề này, ngành đang chuyển hướng sang kiến trúc bộ nhớ đệm KV chia sẻ kiên trì. Bằng cách lưu trữ bộ nhớ đệm tập trung trên lưu trữ hiệu suất cao thay vì dư thừa trên nhiều nút GPU, các tổ chức có thể giảm chi phí tiền xử lý và cải thiện việc tái sử dụng ngữ cảnh.

Biên giới nén dữ liệu

Vượt ra ngoài phần cứng vật lý, các đóng góp thuật toán mới đang định nghĩa lại những gì có thể trong bộ nhớ suy luận. Bản trình bày gần đây của Google về TurboQuant tại ICLR 2026 chứng minh quy mô của sự thay đổi này. TurboQuant cung cấp mức nén lên đến 6 lần cho bộ nhớ đệm KV với độ chính xác bằng không.

Lưu trữ như một quyết định tài chính

Lưu trữ không còn chỉ là một quyết định phụ trợ; nó là một quyết định tài chính. Khi một lớp lưu trữ có thể giữ cho các khối lượng công việc tốn nhiều GPU liên tục được cung cấp dữ liệu, nó ngăn chặn các tài nguyên đắt tiền ngồi không. Trong kỷ nguyên hiệu quả, mục tiêu là thúc đẩy bức tường sử dụng 5% lên cao hơn bằng cách đảm bảo mọi chu kỳ đều dành cho tạo token, không phải cho việc di chuyển dữ liệu.

Chủ quyền và tương lai của AI tác nhân: Xây dựng nền tảng niềm tin

Rào cản cuối cùng để đạt được lợi nhuận trên AI không phải là nút thắt kỹ thuật, mà là nút thắt niềm tin. Khi AI doanh nghiệp chuyển từ các chatbot đơn giản sang các tác nhân tự chủ, hồ sơ rủi ro thay đổi. Các tác nhân yêu cầu quyền truy cập sâu vào các hệ thống nội bộ và sở hữu trí tuệ.

Nghiên cứu của VentureBeat về tình trạng quản trị AI cho thấy sự ngắt kết nối rõ rệt. Trong khi nhiều tổ chức tin rằng họ đã bảo mật môi trường AI của mình, 72% doanh nghiệp thừa nhận họ không có mức độ kiểm soát và bảo mật mà họ nghĩ mình có. Ảo ảnh về quản trị này đặc biệt nguy hiểm khi các hệ thống tác nhân đi vào sản xuất.

Chủ quyền như một nguyên tắc kiến trúc

Chủ quyền dữ liệu thường được coi là một ô kiểm hộp địa lý hoặc quy định. Đối với doanh nghiệp chiến lược, nó phải được coi là một nguyên tắc kiến trúc cốt lõi. Nó liên quan đến việc duy trì kiểm soát, nguồn gốc và khả năng giải thích đối với dữ liệu thúc đẩy quy trình công việc của tác nhân.

Đưa AI đến dữ liệu

Câu hỏi cơ bản cho tương lai của tác nhân là liệu nên đưa dữ liệu đến AI hay đưa AI đến dữ liệu. Đối với các khối lượng công việc nhạy cảm cao, việc di chuyển dữ liệu đến một điểm cuối mô hình tập trung thường là câu trả lời sai.

Việc chuyển hướng sang AI riêng tư — nơi suy luận diễn ra gần hơn với nơi dữ liệu đáng tin cậy nằm — đang được thúc đẩy. Đây là nơi lựa chọn trở thành nhà sản xuất token trở thành lợi thế bảo mật. Bằng cách sở hữu ngăn xếp suy luận, doanh nghiệp có thể thực thi quản trị và nguồn gốc ở lớp hạ tầng.

Cuộc chiến nền tảng tiếp theo

Cuộc chiến thống trị AI sẽ không được quyết định bởi ai sở hữu các cụm GPU lớn nhất. Nó sẽ được giành bởi các công ty có kinh tế suy luận tốt nhất và nền tảng dữ liệu đáng tin cậy nhất.

Các tổ chức chiến thắng trong kỷ nguyên hiệu quả sẽ là những người giao chi phí thấp nhất cho mỗi token hữu ích và con đường nhanh nhất để đưa ra sản phẩm. Họ sẽ là những người đã vượt qua cơn say sưa tích trữ để tập trung vào đầu ra sản phẩm. Đạt được lợi nhuận trên AI đòi hỏi sự thay đổi tư duy. Nó có nghĩa là chuyển từ văn hóa bảo đảm ngăn xếp sang văn hóa bóp kiệt ngăn xếp.

Đó là cách ROI trở nên thực tế. Đó là nơi thế hệ lợi thế doanh nghiệp tiếp theo sẽ được xây dựng.